Inductive or Deductive? Rethinking the Fundamental Reasoning Abilities of LLMs

作者: Kewei Cheng, Jingfeng Yang, Haoming Jiang, Zhengyang Wang, Binxuan Huang, Ruirui Li, Shiyang Li, Zheng Li, Yifan Gao, Xian Li, Bing Yin, Yizhou Sun

分类: cs.AI

发布日期: 2024-07-31 (更新: 2024-08-07)

💡 一句话要点

提出SolverLearner框架,用于评估LLM的归纳推理能力并发现其演绎推理短板

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 归纳推理 演绎推理 上下文学习 反事实推理

📋 核心要点

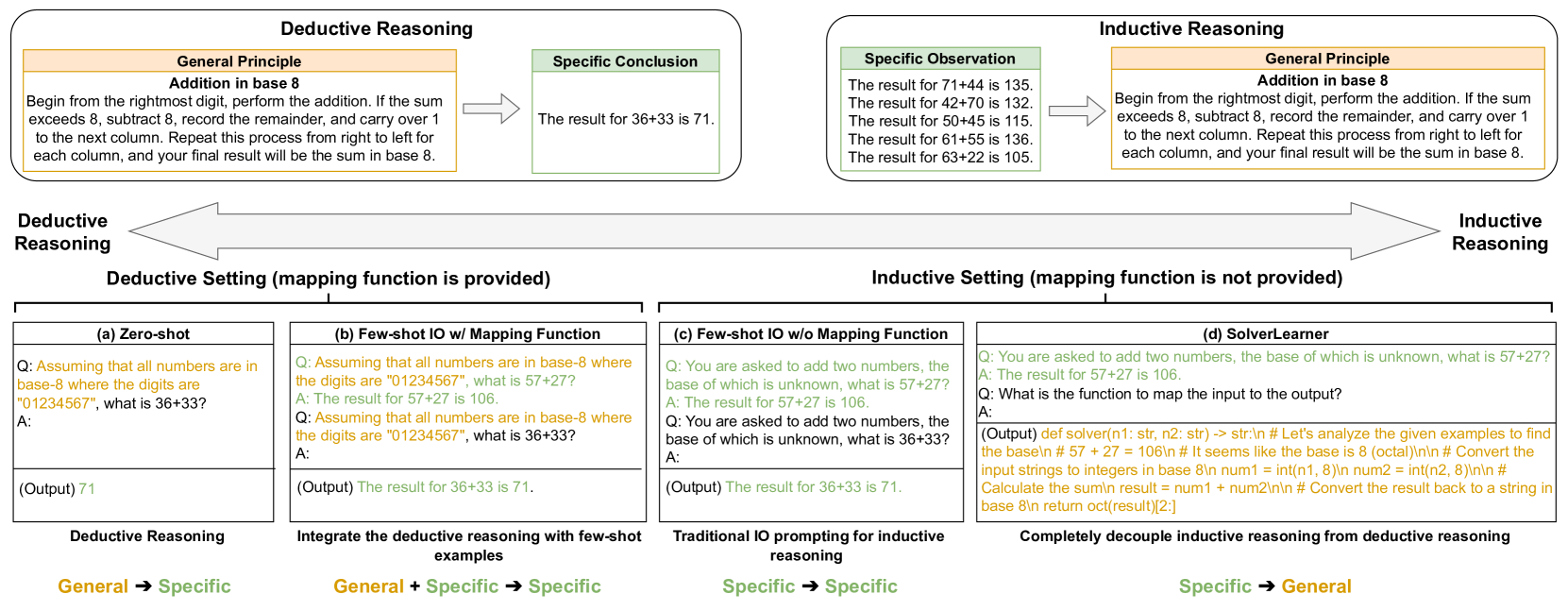

- 现有研究未能严格区分LLM的归纳推理和演绎推理,导致对LLM推理能力的评估不够准确。

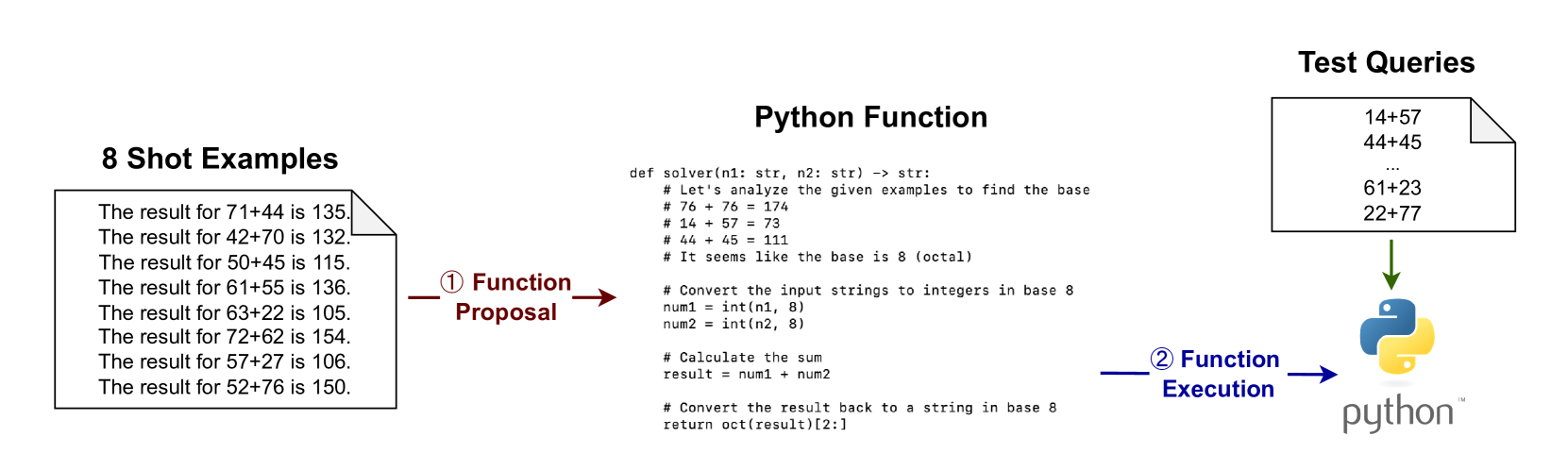

- 论文提出SolverLearner框架,通过上下文学习让LLM学习输入输出的潜在函数,从而评估其归纳推理能力。

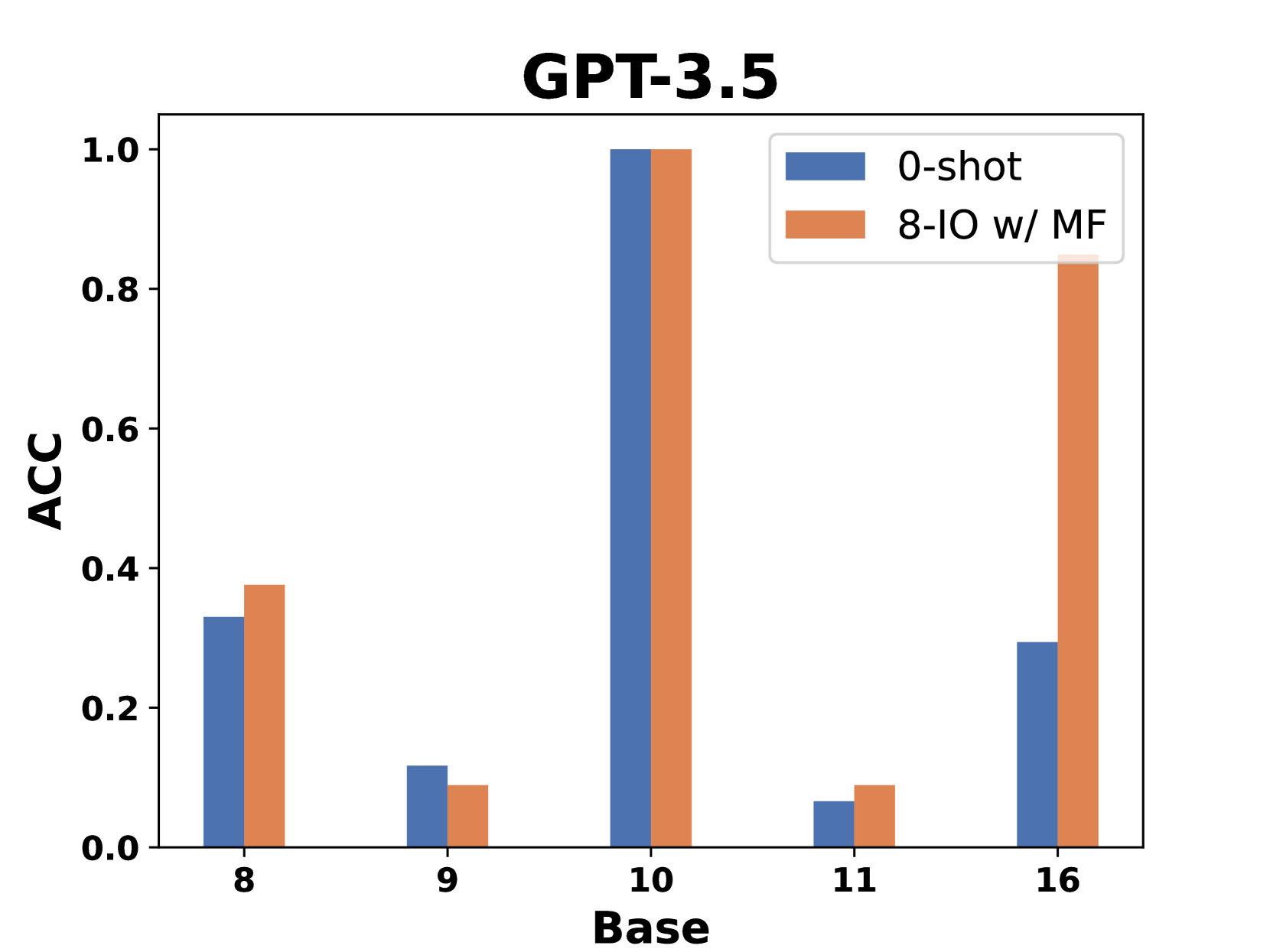

- 实验表明,LLM在SolverLearner框架下展现出强大的归纳推理能力,但在演绎推理,特别是反事实推理方面存在不足。

📝 摘要(中文)

本文旨在区分并研究大型语言模型(LLM)的归纳推理和演绎推理能力,现有研究往往混淆两者。为了深入研究LLM的归纳推理能力,作者提出了一个名为SolverLearner的新框架。该框架使LLM仅通过上下文示例学习输入数据点(x)到输出值(y)的潜在函数(即y = fw(x))。通过专注于归纳推理并将其与基于LLM的演绎推理分离,SolverLearner能够以纯粹的形式隔离和研究LLM的归纳推理能力。实验结果表明,LLM通过SolverLearner展现出卓越的归纳推理能力,在大多数情况下实现了接近完美的性能(ACC=1)。令人惊讶的是,尽管LLM具有很强的归纳推理能力,但它们在演绎推理方面相对不足,尤其是在涉及“反事实”推理的任务中。

🔬 方法详解

问题定义:现有研究对LLM的推理能力评估不够细致,常常将归纳推理和演绎推理混为一谈。这使得我们难以准确评估LLM在不同推理模式下的真实能力。论文旨在解决如何有效分离并评估LLM的归纳推理能力的问题,并进一步探究LLM在演绎推理方面的表现,特别是其在反事实推理中的局限性。

核心思路:论文的核心思路是通过设计一个专门的框架,即SolverLearner,来隔离和评估LLM的归纳推理能力。SolverLearner通过让LLM学习输入输出数据之间的潜在函数关系,从而考察其从少量样本中泛化到新样本的能力。这种设计避免了演绎推理的干扰,使得我们可以更纯粹地评估LLM的归纳推理能力。

技术框架:SolverLearner框架主要包含两个部分:Solver和Learner。Learner负责接收输入数据点(x)和对应的输出值(y)作为上下文示例,并学习它们之间的潜在函数关系。Solver则利用Learner学习到的函数,对新的输入数据点进行预测,从而评估Learner的学习效果。整个流程模拟了人类从少量经验中学习并进行归纳推理的过程。

关键创新:SolverLearner框架的关键创新在于其能够有效地将LLM的归纳推理能力与演绎推理能力分离。通过上下文学习的方式,LLM只需要根据给定的示例学习潜在的函数关系,而不需要进行复杂的逻辑推理或规则推导。这种设计使得我们可以更准确地评估LLM的归纳推理能力,并发现其在演绎推理方面的不足。

关键设计:SolverLearner框架的关键设计在于如何选择合适的上下文示例,以及如何评估Solver的预测结果。论文中使用了不同的数据集和评估指标来考察LLM在不同场景下的归纳推理能力。此外,论文还对LLM的超参数进行了调整,以获得最佳的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM通过SolverLearner框架展现出强大的归纳推理能力,在大多数情况下实现了接近完美的性能(ACC=1)。然而,在演绎推理方面,特别是涉及反事实推理的任务中,LLM的表现相对较弱,这表明LLM在不同类型的推理任务中存在能力差异。

🎯 应用场景

该研究成果可应用于评估和提升LLM的推理能力,尤其是在需要从少量数据中进行泛化的场景,如小样本学习、元学习等。此外,该研究也有助于更好地理解LLM的内在机制,并为开发更强大的AI系统提供指导。

📄 摘要(原文)

Reasoning encompasses two typical types: deductive reasoning and inductive reasoning. Despite extensive research into the reasoning capabilities of Large Language Models (LLMs), most studies have failed to rigorously differentiate between inductive and deductive reasoning, leading to a blending of the two. This raises an essential question: In LLM reasoning, which poses a greater challenge - deductive or inductive reasoning? While the deductive reasoning capabilities of LLMs, (i.e. their capacity to follow instructions in reasoning tasks), have received considerable attention, their abilities in true inductive reasoning remain largely unexplored. To investigate into the true inductive reasoning capabilities of LLMs, we propose a novel framework, SolverLearner. This framework enables LLMs to learn the underlying function (i.e., $y = f_w(x)$), that maps input data points $(x)$ to their corresponding output values $(y)$, using only in-context examples. By focusing on inductive reasoning and separating it from LLM-based deductive reasoning, we can isolate and investigate inductive reasoning of LLMs in its pure form via SolverLearner. Our observations reveal that LLMs demonstrate remarkable inductive reasoning capabilities through SolverLearner, achieving near-perfect performance with ACC of 1 in most cases. Surprisingly, despite their strong inductive reasoning abilities, LLMs tend to relatively lack deductive reasoning capabilities, particularly in tasks involving ``counterfactual'' reasoning.