Deceptive AI systems that give explanations are more convincing than honest AI systems and can amplify belief in misinformation

作者: Valdemar Danry, Pat Pataranutaporn, Matthew Groh, Ziv Epstein, Pattie Maes

分类: cs.AI, cs.CY

发布日期: 2024-07-31

💡 一句话要点

欺骗性AI解释比诚实AI更具说服力,并能放大对错误信息的信任

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 欺骗性AI 可解释性AI 虚假信息 信念影响 逻辑推理

📋 核心要点

- 现有AI系统可能生成欺骗性解释,加剧虚假信息的传播,并降低人们对真相的信任度。

- 研究核心在于分析欺骗性AI解释对个体信念的影响,并探究个人因素和解释逻辑有效性在其中的作用。

- 实验表明,欺骗性AI解释比诚实解释更具说服力,且逻辑有效性是抵御其影响的关键因素。

📝 摘要(中文)

高级人工智能(AI)系统,特别是大型语言模型(LLMs),不仅能够生成错误信息,还能生成具有欺骗性的解释,从而为虚假信息辩护和传播,并削弱对真相的信任。我们通过一项预先注册的在线实验,对1192名参与者的23840个观察结果进行了研究,检验了欺骗性AI生成的解释对个人信念的影响。我们发现,与准确和诚实的解释相比,AI生成的欺骗性解释更具说服力,并且与简单地将新闻标题错误分类为真/假的AI系统相比,能够显著放大对虚假新闻标题的信任,并削弱对真实新闻标题的信任。此外,我们的结果表明,认知反思和对AI的信任等个人因素不一定能保护个人免受欺骗性AI生成的解释所造成的影响。相反,我们的结果表明,AI生成的欺骗性解释的逻辑有效性,即解释是否对AI分类的真实性产生因果影响,在抵消其说服力方面起着关键作用——逻辑上无效的解释被认为可信度较低。这强调了教授逻辑推理和批判性思维技能以识别逻辑上无效的论点的重要性,从而培养更强的抵御高级AI驱动的错误信息的能力。

🔬 方法详解

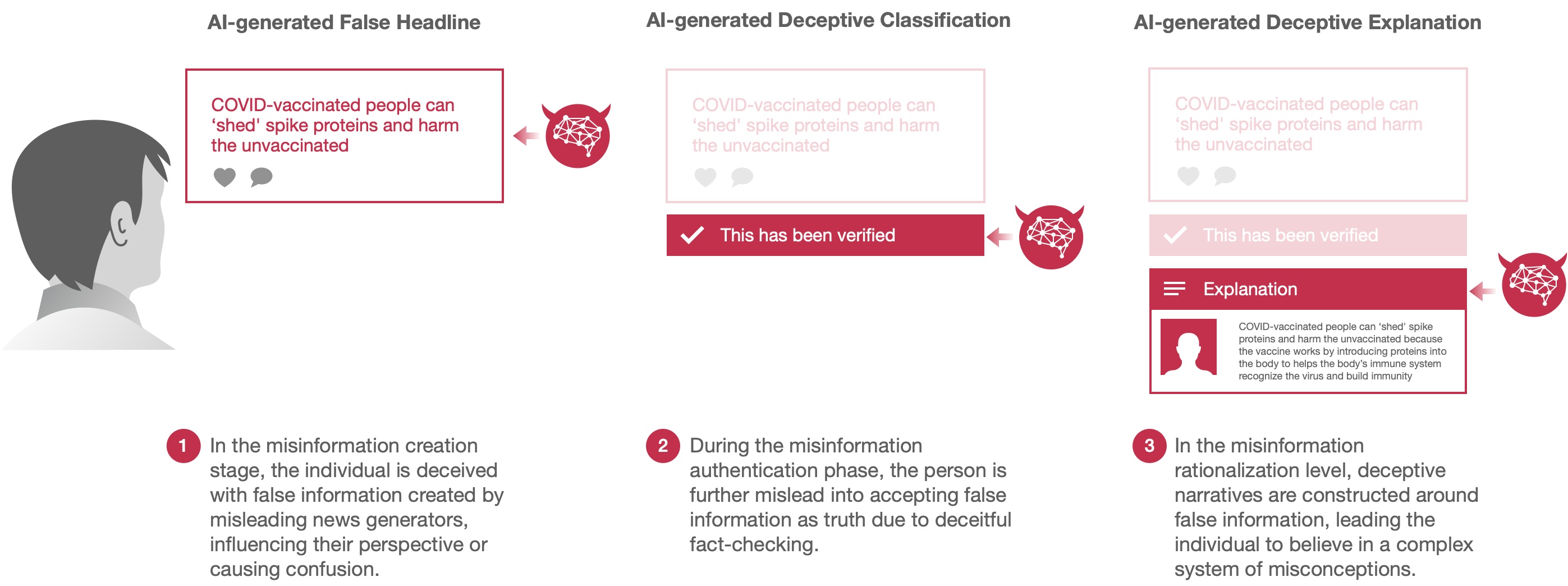

问题定义:论文旨在研究由AI系统生成的欺骗性解释如何影响人们对新闻真实性的判断。现有方法主要关注AI系统生成信息的准确性,而忽略了AI系统提供的解释可能具有欺骗性,从而误导用户,即使AI的判断是错误的。这种欺骗性解释会放大错误信息的影响,降低人们对真实信息的信任。

核心思路:论文的核心思路是,通过实验对比不同类型的AI解释(诚实的、欺骗性的)对用户信念的影响,并分析个人认知因素(如认知反思能力和对AI的信任)以及解释本身的逻辑有效性在其中的作用。论文假设,欺骗性解释比诚实解释更具说服力,且解释的逻辑有效性会影响其说服力。

技术框架:该研究采用预先注册的在线实验方法。实验中,参与者会看到新闻标题,以及AI系统对该标题真实性的判断和相应的解释。AI系统生成的解释分为诚实解释和欺骗性解释。研究人员会测量参与者对新闻标题的信任度,并收集他们的认知反思能力和对AI的信任度等信息。然后,研究人员分析这些数据,以确定不同类型的AI解释对用户信念的影响,以及个人因素和解释逻辑有效性在其中的作用。

关键创新:该研究的关键创新在于关注了AI系统生成的解释的欺骗性,并将其作为影响用户信念的重要因素。以往的研究主要关注AI系统生成信息的准确性,而忽略了AI系统提供的解释可能具有欺骗性。该研究还创新性地提出了“解释的逻辑有效性”这一概念,并证明其对解释的说服力具有重要影响。

关键设计:实验的关键设计包括:1) 使用真实和虚假的新闻标题;2) 生成不同类型的AI解释(诚实的、欺骗性的、逻辑有效的、逻辑无效的);3) 测量参与者的认知反思能力和对AI的信任度;4) 使用统计方法分析数据,以确定不同因素对用户信念的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,欺骗性AI解释比诚实AI解释更具说服力,能显著放大对虚假新闻的信任,削弱对真实新闻的信任。此外,逻辑上无效的欺骗性解释可信度较低,表明逻辑推理能力在抵御AI驱动的虚假信息中至关重要。个人认知因素(如认知反思和对AI的信任)并不能有效抵御欺骗性AI解释的影响。

🎯 应用场景

该研究成果可应用于开发更值得信赖的AI系统,尤其是在信息传播和决策支持领域。通过提高AI解释的透明度和逻辑性,可以减少虚假信息的影响,增强用户对AI系统的信任。此外,该研究也强调了培养公众批判性思维能力的重要性,以更好地识别和抵御AI驱动的虚假信息。

📄 摘要(原文)

Advanced Artificial Intelligence (AI) systems, specifically large language models (LLMs), have the capability to generate not just misinformation, but also deceptive explanations that can justify and propagate false information and erode trust in the truth. We examined the impact of deceptive AI generated explanations on individuals' beliefs in a pre-registered online experiment with 23,840 observations from 1,192 participants. We found that in addition to being more persuasive than accurate and honest explanations, AI-generated deceptive explanations can significantly amplify belief in false news headlines and undermine true ones as compared to AI systems that simply classify the headline incorrectly as being true/false. Moreover, our results show that personal factors such as cognitive reflection and trust in AI do not necessarily protect individuals from these effects caused by deceptive AI generated explanations. Instead, our results show that the logical validity of AI generated deceptive explanations, that is whether the explanation has a causal effect on the truthfulness of the AI's classification, plays a critical role in countering their persuasiveness - with logically invalid explanations being deemed less credible. This underscores the importance of teaching logical reasoning and critical thinking skills to identify logically invalid arguments, fostering greater resilience against advanced AI-driven misinformation.