rLLM: Relational Table Learning with LLMs

作者: Weichen Li, Xiaotong Huang, Jianwu Zheng, Zheng Wang, Chaokun Wang, Li Pan, Jianhua Li

分类: cs.AI

发布日期: 2024-07-29 (更新: 2025-11-12)

🔗 代码/项目: GITHUB

💡 一句话要点

rLLM:一个基于LLM的关系表学习PyTorch库,支持快速构建RTL模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 关系表学习 大型语言模型 图神经网络 模块化设计 PyTorch库

📋 核心要点

- 现有关系表学习方法缺乏灵活性,难以快速集成不同类型的模型(如GNN、LLM和表神经网络)。

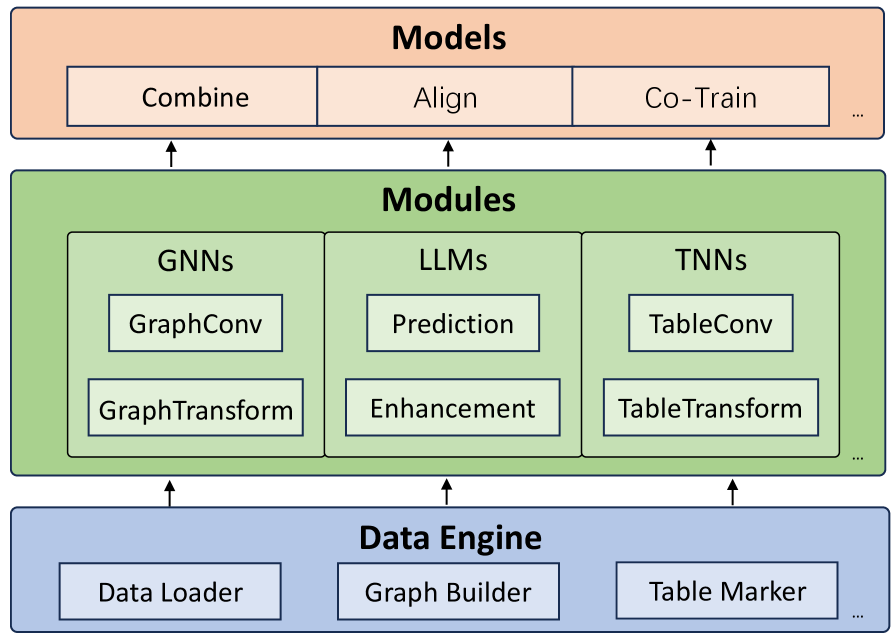

- rLLM通过将各类模型分解为标准化模块,支持以“组合、对齐和协同训练”的方式快速构建新的RTL模型。

- 论文提出了BRIDGE方法作为rLLM的示例,并构建了三个新的关系表格数据集,为RTL研究提供了基准。

📝 摘要(中文)

本文介绍rLLM (relationLLM),这是一个基于PyTorch的库,专为使用大型语言模型(LLM)进行关系表学习(RTL)而设计。其核心思想是将最先进的图神经网络、LLM和表神经网络分解为标准化的模块,从而能够以简单的“组合、对齐和协同训练”的方式快速构建新型RTL模型。为了说明rLLM的用法,我们介绍了一种名为BRIDGE的简单RTL方法。此外,我们通过增强经典数据集,提出了三个新的关系表格数据集(TML1M、TLF2K和TACM12K)。我们希望rLLM可以作为RTL相关任务的有用且易于使用的开发框架。我们的代码可在https://github.com/rllm-project/rllm获取。

🔬 方法详解

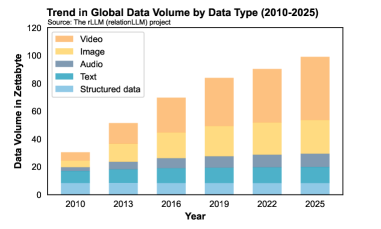

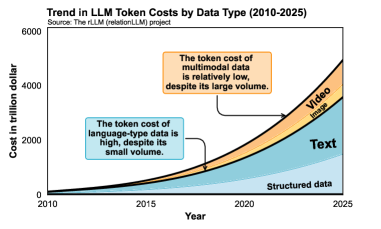

问题定义:关系表学习(RTL)旨在从关系型表格数据中学习,现有方法通常针对特定任务设计,缺乏通用性和灵活性。将大型语言模型(LLM)融入RTL是一个有前景的方向,但现有框架难以快速集成和实验不同的LLM和表格数据处理模块。

核心思路:rLLM的核心思路是将现有的图神经网络(GNN)、LLM和表神经网络分解为标准化的、可重用的模块。通过这种模块化的设计,研究人员可以方便地组合不同的模块,并进行对齐和协同训练,从而快速构建新的RTL模型。

技术框架:rLLM的整体框架包含以下几个主要模块:1) 数据加载和预处理模块,负责加载关系型表格数据,并进行必要的预处理;2) 特征编码模块,包含GNN、LLM和表神经网络等多种编码器,用于将表格数据和关系信息编码为向量表示;3) 对齐模块,负责将不同编码器的输出对齐到同一语义空间;4) 协同训练模块,通过联合优化不同模块的参数,提高整体模型的性能。

关键创新:rLLM最重要的创新在于其模块化的设计理念,它将复杂的RTL模型分解为可重用的组件,极大地简化了模型构建和实验的过程。此外,rLLM还提供了一套标准化的接口,方便研究人员集成新的模块和算法。

关键设计:rLLM的关键设计包括:1) 标准化的模块接口,定义了模块的输入、输出和参数;2) 灵活的配置系统,允许用户通过配置文件指定模型的结构和训练参数;3) 预定义的常用模块,例如不同的GNN层、LLM和表神经网络,方便用户快速构建模型。BRIDGE方法作为rLLM的示例,展示了如何使用rLLM构建一个简单的RTL模型,它使用LLM对表格数据进行编码,并使用GNN对关系信息进行建模。

🖼️ 关键图片

📊 实验亮点

论文提出了BRIDGE方法,并使用rLLM框架在三个新的关系表格数据集(TML1M、TLF2K和TACM12K)上进行了实验。实验结果表明,BRIDGE方法在这些数据集上取得了有竞争力的性能,验证了rLLM框架的有效性和易用性。具体性能数据未知,但论文强调了其作为基准的价值。

🎯 应用场景

rLLM可应用于多种关系表学习任务,例如知识图谱补全、关系抽取、表格数据分类和回归等。该框架能够帮助研究人员快速探索不同的模型结构和训练策略,加速RTL领域的研究进展。此外,rLLM还可以用于构建基于表格数据的智能应用,例如智能推荐系统、金融风险评估等。

📄 摘要(原文)

We introduce rLLM (relationLLM), a PyTorch library designed for Relational Table Learning (RTL) with Large Language Models (LLMs). The core idea is to decompose state-of-the-art Graph Neural Networks, LLMs, and Table Neural Networks into standardized modules, to enable the fast construction of novel RTL-type models in a simple "combine, align, and co-train" manner. To illustrate the usage of rLLM, we introduce a simple RTL method named \textbf{BRIDGE}. Additionally, we present three novel relational tabular datasets (TML1M, TLF2K, and TACM12K) by enhancing classic datasets. We hope rLLM can serve as a useful and easy-to-use development framework for RTL-related tasks. Our code is available at: https://github.com/rllm-project/rllm.