AgentPeerTalk: Empowering Students through Agentic-AI-Driven Discernment of Bullying and Joking in Peer Interactions in Schools

作者: Aditya Paul, Chi Lok Yu, Eva Adelina Susanto, Nicholas Wai Long Lau, Gwenyth Isobel Meadows

分类: cs.CY, cs.AI, cs.CL

发布日期: 2024-07-27

💡 一句话要点

AgentPeerTalk:利用Agentic AI辨别校园欺凌与玩笑,赋能学生。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 校园欺凌 大型语言模型 Agentic AI 自然语言处理 学生心理健康

📋 核心要点

- 校园欺凌对学生心理健康影响重大,现有方法难以有效且及时地识别和干预。

- AgentPeerTalk探索利用Agentic AI,特别是大型语言模型,来区分欺凌和玩笑,为学生提供实时支持。

- 实验表明,ChatGPT-4在agentic方法下表现出较好的上下文准确性,具有赋能学生的潜力。

📝 摘要(中文)

本研究旨在探讨大型语言模型(LLMs)在赋能学生,使其能够辨别校园同伴互动中的欺凌和玩笑方面的潜力,这对学生的心理健康至关重要。我们评估了ChatGPT-4、Gemini 1.5 Pro和Claude 3 Opus,并通过人工评估来验证它们的有效性。结果表明,并非所有LLM都适用于agentic方法,其中ChatGPT-4表现出最大的潜力。我们观察到LLM输出的差异,这可能受到政治过度纠正、上下文窗口限制以及训练数据中预先存在的偏差的影响。在实施agentic方法后,ChatGPT-4在特定上下文中的准确性表现出色,突显了其为弱势学生提供持续、实时支持的潜力。这项研究强调了在教育环境中使用agentic AI的重大社会影响,为减少欺凌的负面影响和提高学生的福祉提供了一条新途径。

🔬 方法详解

问题定义:论文旨在解决校园环境中学生难以区分欺凌和玩笑的问题,现有方法依赖人工干预,效率低且可能存在主观偏差。痛点在于缺乏能够实时、客观地识别欺凌行为并提供支持的工具。

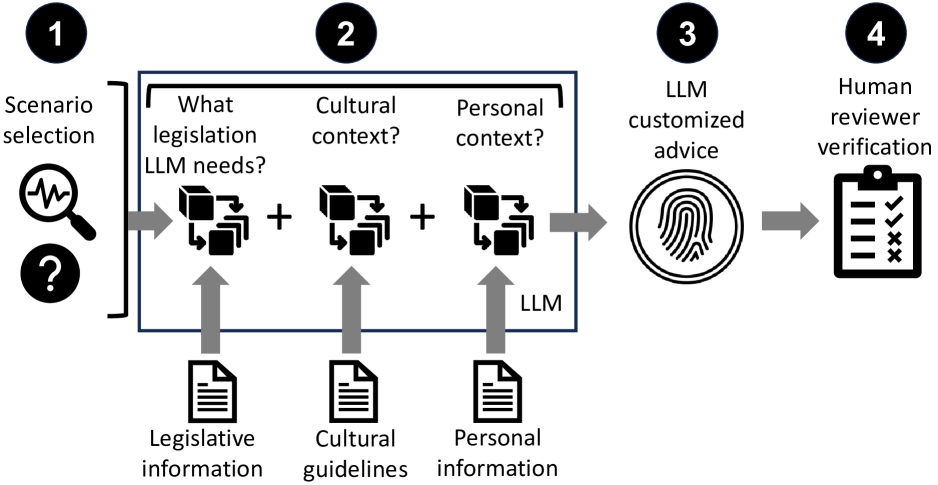

核心思路:核心思路是利用大型语言模型(LLMs)的自然语言理解能力,构建一个agentic AI系统,该系统能够模拟人类的判断,根据上下文区分欺凌和玩笑,并为学生提供反馈和支持。这种设计旨在实现实时、客观的欺凌识别,并赋能学生自主应对。

技术框架:整体框架包含以下几个主要阶段:1) 数据收集:收集校园同伴互动数据,包括文本、语音等;2) 模型选择与训练:选择合适的LLM(如ChatGPT-4),并使用标注数据进行微调,使其能够区分欺凌和玩笑;3) Agentic方法实施:设计agentic策略,使LLM能够根据上下文进行判断,并提供个性化反馈;4) 人工评估:通过人工评估验证LLM的有效性,并进行迭代优化。

关键创新:最重要的技术创新点在于将LLM与agentic方法相结合,构建了一个能够实时、客观地识别欺凌行为并提供支持的系统。与现有方法相比,该方法具有更高的效率和客观性,能够更好地赋能学生。

关键设计:论文的关键设计包括:1) 选择ChatGPT-4作为基础模型,因为它在上下文理解和生成方面表现出色;2) 设计agentic策略,使LLM能够根据上下文进行判断,并提供个性化反馈;3) 使用人工评估来验证LLM的有效性,并进行迭代优化。具体参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ChatGPT-4在实施agentic方法后,在特定上下文中的准确性表现出色,优于Gemini 1.5 Pro和Claude 3 Opus。这表明ChatGPT-4具有为弱势学生提供持续、实时支持的潜力。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于开发校园欺凌预警系统,为学生提供实时支持和干预。此外,该方法还可扩展到其他社交场景,如在线社区、职场等,用于识别和处理不当言论和行为,营造更健康和谐的社交环境。未来,该技术有望整合到教育平台和社交媒体中,提升用户体验和安全性。

📄 摘要(原文)

Addressing school bullying effectively and promptly is crucial for the mental health of students. This study examined the potential of large language models (LLMs) to empower students by discerning between bullying and joking in school peer interactions. We employed ChatGPT-4, Gemini 1.5 Pro, and Claude 3 Opus, evaluating their effectiveness through human review. Our results revealed that not all LLMs were suitable for an agentic approach, with ChatGPT-4 showing the most promise. We observed variations in LLM outputs, possibly influenced by political overcorrectness, context window limitations, and pre-existing bias in their training data. ChatGPT-4 excelled in context-specific accuracy after implementing the agentic approach, highlighting its potential to provide continuous, real-time support to vulnerable students. This study underlines the significant social impact of using agentic AI in educational settings, offering a new avenue for reducing the negative consequences of bullying and enhancing student well-being.