Semantic Communication Enhanced by Knowledge Graph Representation Learning

作者: Nour Hello, Paolo Di Lorenzo, Emilio Calvanese Strinati

分类: cs.AI

发布日期: 2024-07-27

备注: Accepted for publication at the 25th IEEE International Workshop on Signal Processing Advances in Wireless Communications (SPAWC)

💡 一句话要点

提出基于知识图谱表示学习的语义通信方法,实现高压缩率的信息传输。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义通信 知识图谱 图神经网络 大型语言模型 语义编码 信息压缩 无线通信

📋 核心要点

- 现有通信方法缺乏对信息语义的有效利用,导致传输效率低下,冗余信息过多。

- 利用大型语言模型和图神经网络构建语义编码器,提取知识图谱中的语义关系,实现信息的紧凑表示。

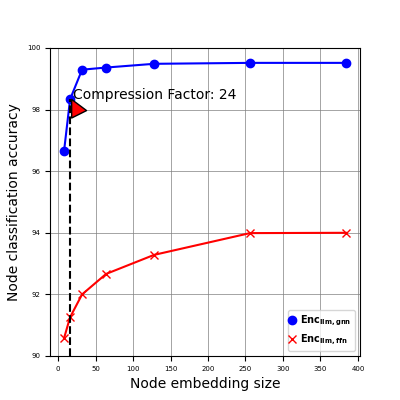

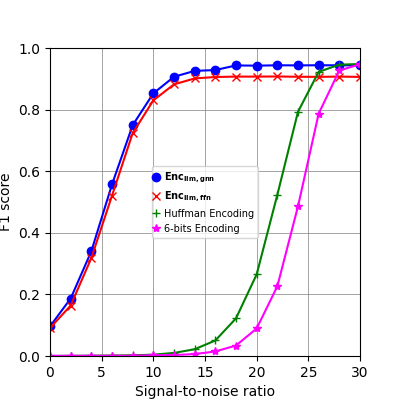

- 通过仅传输节点嵌入并在接收端推断完整知识图谱,实验证明了该方法在压缩率方面的有效性。

📝 摘要(中文)

本文研究了在新兴的语义通信范式中,表示和处理提取到图中的语义知识的优势。该方法利用语义和语用方面,结合大型语言模型(LLM)的最新进展,以实现智能体之间处理和交换的知识的紧凑表示。通过将LLM和图神经网络(GNN)级联作为语义编码器来实现这一点,其中选择要共享的信息,使其对接收者有意义。所提出的语义编码器产生的嵌入向量以三元组的形式表示信息:节点(语义概念实体)、边(概念之间的关系)、节点。因此,语义信息与语义概念抽象空间中元素之间关系的表示相关联。本文研究了通过结合链接图嵌入中元素的关联关系来实现通信中高压缩率的潜力。我们提出仅通过无线信道发送等效于节点嵌入的语义符号,并在接收端推断完整的知识图谱。数值模拟表明了利用知识图谱进行语义压缩和传输信息的有效性。

🔬 方法详解

问题定义:传统通信方法通常关注信号的可靠传输,而忽略了信息的语义内容,导致传输效率低下。在智能体之间交换信息时,如何有效地提取和表示语义知识,并以高压缩率进行传输,是一个关键问题。现有方法在处理复杂语义关系时存在不足,难以实现高效的语义压缩。

核心思路:本文的核心思路是利用知识图谱来表示和处理语义信息。通过将信息编码为知识图谱中的节点和关系,可以有效地捕捉语义关联。然后,仅传输关键的节点嵌入,并在接收端利用图神经网络推断完整的知识图谱,从而实现高压缩率的语义通信。这种方法充分利用了语义关系,减少了冗余信息的传输。

技术框架:该方法的技术框架主要包括以下几个模块:1) 语义编码器:利用大型语言模型(LLM)和图神经网络(GNN)的级联结构,将原始信息编码为知识图谱的嵌入表示。LLM用于提取文本中的语义概念和关系,GNN用于学习图结构的表示。2) 传输模块:仅通过无线信道传输知识图谱中的节点嵌入。3) 语义解码器:在接收端,利用GNN推断完整的知识图谱,从而恢复原始信息。

关键创新:该方法最重要的技术创新点在于将知识图谱表示学习与语义通信相结合。通过利用知识图谱的结构化信息,可以更有效地表示和压缩语义信息。与传统的基于信源编码的方法相比,该方法能够更好地利用语义关系,实现更高的压缩率。此外,仅传输节点嵌入并在接收端推断完整图谱的策略,进一步提高了传输效率。

关键设计:在语义编码器中,LLM的选择和GNN的结构是关键设计因素。LLM需要能够有效地提取语义概念和关系,GNN需要能够学习图结构的表示。损失函数的设计也至关重要,需要保证节点嵌入能够有效地表示语义信息,并且能够通过GNN推断出完整的知识图谱。具体的参数设置和网络结构需要根据具体的应用场景进行调整。例如,可以使用TransE等知识图谱嵌入模型来学习节点和关系的表示。

🖼️ 关键图片

📊 实验亮点

论文通过数值模拟验证了该方法的有效性。实验结果表明,通过利用知识图谱进行语义压缩和传输,可以显著提高压缩率,同时保持较高的信息恢复精度。具体的性能数据(例如,压缩率的提升幅度)在摘要中未明确给出,但强调了利用知识图谱进行语义压缩和传输信息的有效性。

🎯 应用场景

该研究成果可应用于物联网、智能交通、多智能体协作等领域。在这些场景中,智能体需要交换大量的语义信息,而带宽资源有限。通过利用知识图谱进行语义压缩和传输,可以有效地提高通信效率,降低网络拥塞,并支持更复杂的智能应用。未来,该方法有望在资源受限的无线通信环境中发挥重要作用。

📄 摘要(原文)

This paper investigates the advantages of representing and processing semantic knowledge extracted into graphs within the emerging paradigm of semantic communications. The proposed approach leverages semantic and pragmatic aspects, incorporating recent advances on large language models (LLMs) to achieve compact representations of knowledge to be processed and exchanged between intelligent agents. This is accomplished by using the cascade of LLMs and graph neural networks (GNNs) as semantic encoders, where information to be shared is selected to be meaningful at the receiver. The embedding vectors produced by the proposed semantic encoder represent information in the form of triplets: nodes (semantic concepts entities), edges(relations between concepts), nodes. Thus, semantic information is associated with the representation of relationships among elements in the space of semantic concept abstractions. In this paper, we investigate the potential of achieving high compression rates in communication by incorporating relations that link elements within graph embeddings. We propose sending semantic symbols solely equivalent to node embeddings through the wireless channel and inferring the complete knowledge graph at the receiver. Numerical simulations illustrate the effectiveness of leveraging knowledge graphs to semantically compress and transmit information.