Greedy Output Approximation: Towards Efficient Structured Pruning for LLMs Without Retraining

作者: Jianwei Li, Yijun Dong, Qi Lei

分类: cs.AI

发布日期: 2024-07-26

💡 一句话要点

提出基于贪婪输出近似的LLM单次结构化剪枝方法,无需重训练

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 模型剪枝 单次剪枝 无需重训练 输出近似 推理感知 模型压缩

📋 核心要点

- 现有LLM剪枝方法计算成本高昂,通常需要耗时的重训练阶段,限制了其应用。

- 论文提出基于输出近似的剪枝准则,并结合两步重建技术,在无需重训练的情况下实现高效剪枝。

- 实验表明,该方法在降低计算成本和硬件需求的同时,保持了LLM在多个数据集和模型上的优越性能。

📝 摘要(中文)

为了在不产生显著计算成本的情况下移除大型语言模型(LLMs)中的冗余组件,本研究专注于无需重训练的单次剪枝。我们通过识别一个独立运行的深度为2的剪枝结构,简化了基于Transformer的LLMs的剪枝过程。此外,我们提出了两种源于输出近似优化视角的推理感知剪枝准则,其性能优于传统的训练感知指标,如梯度和Hessian。我们还引入了一种两步重建技术,以减轻剪枝误差,而无需模型重训练。实验结果表明,我们的方法显著降低了计算成本和硬件需求,同时在各种数据集和模型上保持了卓越的性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)剪枝过程中计算成本高、需要大量重训练的问题。现有剪枝方法,特别是那些依赖于训练感知指标(如梯度或Hessian)的方法,通常需要大量的计算资源和时间来进行模型微调或重训练,这使得它们在实际应用中效率较低。

核心思路:论文的核心思路是提出一种基于“贪婪输出近似”的单次剪枝方法,该方法无需重训练。其关键在于设计一种“推理感知”的剪枝准则,直接从模型输出的角度出发,选择性地移除对模型输出影响较小的组件,从而在保证模型性能的同时,降低计算复杂度。此外,还引入了两步重建技术来进一步减轻剪枝带来的误差。

技术框架:整体框架包含以下几个主要步骤:1) 识别Transformer模型中可独立剪枝的深度为2的结构;2) 基于输出近似优化视角,推导两种推理感知剪枝准则;3) 使用这些准则对模型进行单次剪枝;4) 应用两步重建技术来减轻剪枝误差,无需重训练。

关键创新:最重要的技术创新点在于提出了“推理感知”的剪枝准则,它直接优化剪枝后的模型输出,使其尽可能接近原始模型输出。与传统的训练感知指标不同,这种方法避免了复杂的梯度计算和模型微调过程,从而显著提高了剪枝效率。此外,两步重建技术也是一个创新点,它可以在不进行模型重训练的情况下,有效地恢复剪枝造成的性能损失。

关键设计:论文的关键设计包括:1) 深度为2的剪枝结构的选择,这允许在Transformer模型中进行更细粒度的剪枝;2) 基于输出近似的剪枝准则的具体形式,例如,可以通过最小化剪枝前后模型输出的差异来确定哪些组件应该被移除;3) 两步重建技术的具体实现,例如,可以通过调整剩余组件的权重来补偿被移除组件的影响。具体的损失函数和网络结构细节在论文中进行了详细描述(未知)。

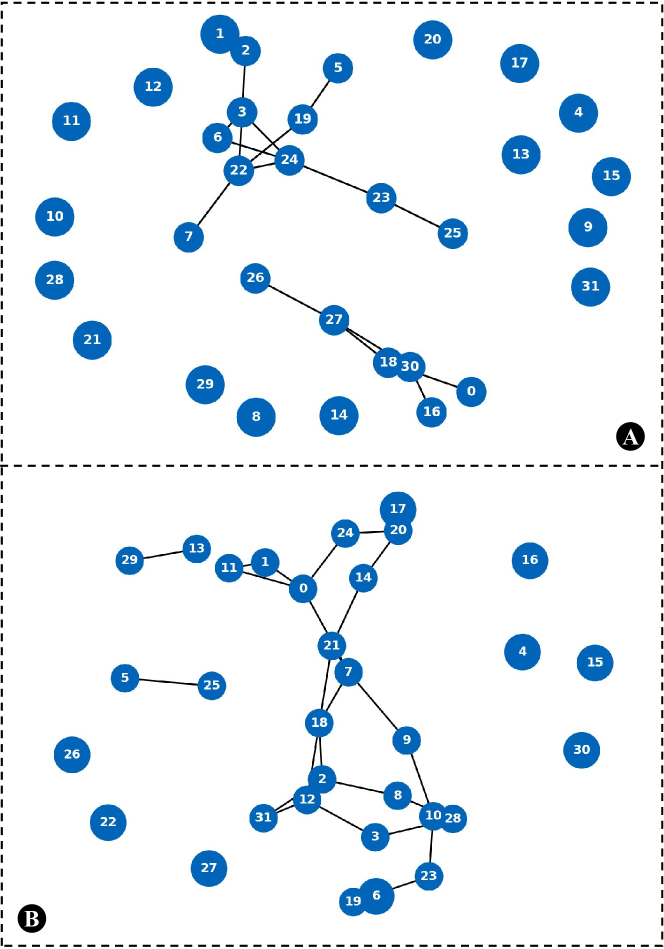

🖼️ 关键图片

📊 实验亮点

该方法在各种数据集和模型上都取得了显著的性能提升。实验结果表明,该方法能够在显著降低计算成本和硬件需求的同时,保持甚至超过原始模型的性能。具体的性能数据、对比基线和提升幅度在论文中进行了详细展示(未知)。

🎯 应用场景

该研究成果可广泛应用于各种需要部署大型语言模型的场景,例如移动设备、边缘计算设备等资源受限的环境。通过降低计算成本和硬件需求,该方法使得LLM能够在更广泛的平台上运行,从而加速人工智能技术的普及和应用。此外,该方法还可以用于模型压缩和加速推理,提高LLM的效率和响应速度。

📄 摘要(原文)

To remove redundant components of large language models (LLMs) without incurring significant computational costs, this work focuses on single-shot pruning without a retraining phase. We simplify the pruning process for Transformer-based LLMs by identifying a depth-2 pruning structure that functions independently. Additionally, we propose two inference-aware pruning criteria derived from the optimization perspective of output approximation, which outperforms traditional training-aware metrics such as gradient and Hessian. We also introduce a two-step reconstruction technique to mitigate pruning errors without model retraining. Experimental results demonstrate that our approach significantly reduces computational costs and hardware requirements while maintaining superior performance across various datasets and models.