Personalized and Context-aware Route Planning for Edge-assisted Vehicles

作者: Dinesh Cyril Selvaraj, Falko Dressler, Carla Fabiana Chiasserini

分类: cs.AI, cs.RO

发布日期: 2024-07-25

💡 一句话要点

提出基于图神经网络和深度强化学习的个性化车辆路径规划方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 个性化路径规划 图神经网络 深度强化学习 自动驾驶 智能交通 驾驶员偏好 道路网络 边缘计算

📋 核心要点

- 现有路径规划服务忽略驾驶员个性化偏好,无法满足未来自动驾驶对定制化导航的需求。

- 利用图神经网络学习道路网络结构,结合深度强化学习,通过奖励机制优化路线选择。

- 实验表明,该方法能有效适应驾驶员偏好,在路线选择和旅行时间上均优于传统方法。

📝 摘要(中文)

传统的路径规划服务通常为所有驾驶员提供相同的路线,主要关注行驶距离或时间等少数标准化因素,忽略了个人驾驶员的偏好。随着未来几年自动驾驶汽车的出现,车辆将依赖此类规划器确定的路线,因此需要结合每个驾驶员的特定偏好,确保个性化的导航体验。本文提出了一种基于图神经网络(GNN)和深度强化学习(DRL)的新方法,旨在定制路线以适应个人偏好。通过分析个人驾驶员的历史轨迹,我们对他们的驾驶行为进行分类,并将其与相关的道路属性相关联,作为驾驶员偏好的指标。GNN能够有效地将道路网络表示为图结构数据,而DRL能够利用奖励机制做出决策,以优化路线选择,同时考虑诸如出行成本、拥堵程度和驾驶员满意度等因素。我们使用真实世界的道路网络评估了我们提出的基于GNN的DRL框架,并证明了其适应驾驶员偏好的能力,提供了为个人驾驶员量身定制的一系列路线选择。结果表明,与通用路线规划器相比,我们的框架可以选择满足驾驶员偏好的路线,性能提升高达17%,并且相对于基于最短距离的方法,旅行时间减少了33%(下午)和46%(晚上)。

🔬 方法详解

问题定义:现有路径规划算法通常以距离或时间最短为目标,忽略了驾驶员的个性化偏好,例如对道路类型、交通状况等的偏好。这在自动驾驶时代,无法为用户提供最佳的驾驶体验。因此,需要一种能够根据驾驶员历史行为学习其偏好,并据此进行个性化路径规划的算法。

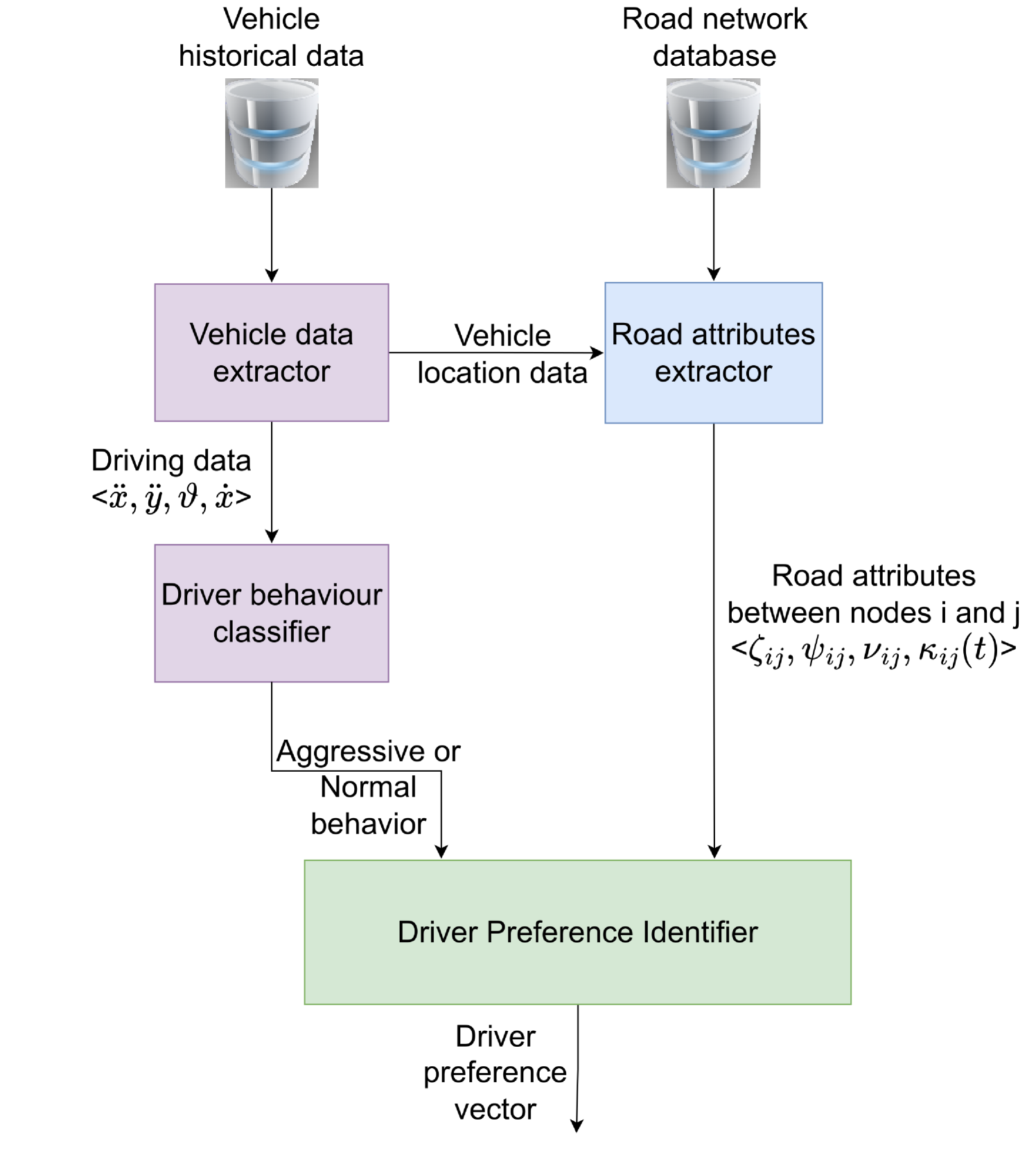

核心思路:本文的核心思路是利用图神经网络(GNN)学习道路网络的拓扑结构和属性,并结合深度强化学习(DRL)来优化路线选择。GNN能够有效地表示道路网络,而DRL可以通过奖励机制来学习驾驶员的偏好,从而选择最符合其需求的路线。

技术框架:该框架主要包含两个模块:GNN模块和DRL模块。首先,GNN模块将道路网络表示为图结构,节点表示路段,边表示路段之间的连接关系,节点和边上可以包含道路的属性信息(如长度、限速、交通流量等)。然后,DRL模块利用GNN学习到的道路网络表示,通过与环境的交互,学习驾驶员的偏好。DRL模块的目标是最大化累积奖励,奖励函数的设计与驾驶员的偏好相关,例如,如果驾驶员偏好避开拥堵路段,则拥堵路段的奖励会降低。

关键创新:该方法的主要创新在于将GNN和DRL结合起来,用于个性化路径规划。GNN能够有效地表示道路网络,DRL能够学习驾驶员的偏好。与传统的路径规划算法相比,该方法能够更好地适应驾驶员的个性化需求。

关键设计:GNN采用图卷积网络(GCN)来学习节点和边的表示。DRL采用深度Q网络(DQN)来学习最优策略。奖励函数的设计至关重要,需要根据驾驶员的偏好进行调整。例如,可以根据驾驶员的历史轨迹,学习其对不同道路属性的偏好,然后将这些偏好转化为奖励函数的权重。此外,还需要考虑探索-利用平衡,以避免DRL陷入局部最优解。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与通用路线规划器相比,该方法在满足驾驶员偏好方面提升了高达17%。此外,相对于基于最短距离的传统方法,旅行时间在下午和晚上分别减少了33%和46%。这些数据表明,该方法能够有效地学习驾驶员的偏好,并据此进行个性化路径规划,显著提升了导航性能。

🎯 应用场景

该研究成果可应用于自动驾驶、智能交通系统等领域,为用户提供个性化的导航服务。通过学习驾驶员的偏好,可以规划出更符合用户需求的路线,提高驾驶体验和出行效率。未来,还可以结合实时交通信息,实现动态的个性化路径规划,进一步提升系统的实用性。

📄 摘要(原文)

Conventional route planning services typically offer the same routes to all drivers, focusing primarily on a few standardized factors such as travel distance or time, overlooking individual driver preferences. With the inception of autonomous vehicles expected in the coming years, where vehicles will rely on routes decided by such planners, there arises a need to incorporate the specific preferences of each driver, ensuring personalized navigation experiences. In this work, we propose a novel approach based on graph neural networks (GNNs) and deep reinforcement learning (DRL), aimed at customizing routes to suit individual preferences. By analyzing the historical trajectories of individual drivers, we classify their driving behavior and associate it with relevant road attributes as indicators of driver preferences. The GNN is capable of representing the road network as graph-structured data effectively, while DRL is capable of making decisions utilizing reward mechanisms to optimize route selection with factors such as travel costs, congestion level, and driver satisfaction. We evaluate our proposed GNN-based DRL framework using a real-world road network and demonstrate its ability to accommodate driver preferences, offering a range of route options tailored to individual drivers. The results indicate that our framework can select routes that accommodate driver's preferences with up to a 17% improvement compared to a generic route planner, and reduce the travel time by 33% (afternoon) and 46% (evening) relatively to the shortest distance-based approach.