In-Depth Analysis of Emotion Recognition through Knowledge-Based Large Language Models

作者: Bin Han, Cleo Yau, Su Lei, Jonathan Gratch

分类: cs.HC, cs.AI, cs.CV

发布日期: 2024-07-17

备注: 7 pages

💡 一句话要点

提出结合知识库大语言模型的贝叶斯线索整合方法,提升社交情境下的情绪识别。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情绪识别 贝叶斯线索整合 大型语言模型 情境感知 情感计算

📋 核心要点

- 现有情绪识别方法忽略了情境信息,导致在复杂社交场景下表现不佳,难以准确理解人类情感。

- 论文提出结合贝叶斯线索整合(BCI)框架,融合面部表情识别和大型语言模型推理的情境知识。

- 实验结果表明,该方法显著提升了情绪识别的准确性,最佳模型性能可与人类观察者相媲美。

📝 摘要(中文)

在社交情境中进行情绪识别是一项复杂的任务,需要整合来自面部表情和情境背景的信息。传统的情绪识别方法侧重于去语境化的信号,而最近的研究强调了情境在塑造情绪感知中的重要性。本文通过利用人类情绪感知的心理学理论来指导自动化方法的设计,为新兴的基于情境的情绪识别领域做出了贡献。我们提出了一种将情绪识别方法与贝叶斯线索整合(BCI)相结合的方法,以整合来自去语境化面部表情的情绪推断和通过大型语言模型推断的情境知识。我们在解释囚徒困境这一社交任务中的面部表情的背景下测试了这种方法。结果为各种自动情绪识别方法中的BCI提供了明确的支持。最佳的自动化方法获得了与人类观察者相当的结果,表明该方法具有推动情感计算领域发展的潜力。

🔬 方法详解

问题定义:论文旨在解决社交情境下情绪识别的准确性问题。现有方法主要依赖于孤立的面部表情分析,忽略了情境信息对情绪理解的关键作用,导致在复杂社交互动场景中表现不佳。

核心思路:论文的核心思路是利用贝叶斯线索整合(BCI)框架,将来自面部表情的情绪推断与通过大型语言模型(LLM)获取的情境知识相结合。BCI模拟了人类整合不同线索进行判断的认知过程,能够更全面地理解情绪。

技术框架:整体框架包含两个主要模块:1) 面部表情识别模块,负责从面部图像中提取情绪特征并进行初步的情绪分类;2) 情境知识推理模块,利用大型语言模型分析社交情境的描述,提取与情绪相关的背景信息。然后,BCI模块将这两个模块的输出作为线索,根据贝叶斯公式计算最终的情绪概率分布。

关键创新:关键创新在于将心理学中的贝叶斯线索整合理论应用于自动情绪识别,并结合大型语言模型来获取情境知识。这使得模型能够像人类一样,综合考虑面部表情和情境背景来判断情绪,从而提高了识别的准确性和鲁棒性。与传统方法相比,该方法更注重情境信息的利用。

关键设计:论文使用预训练的大型语言模型(具体模型未知)进行情境知识推理,并采用标准的贝叶斯公式进行线索整合。具体参数设置和损失函数细节未知。面部表情识别模块可以使用现有的各种方法,论文中测试了多种不同的方法,并验证了BCI框架的有效性。

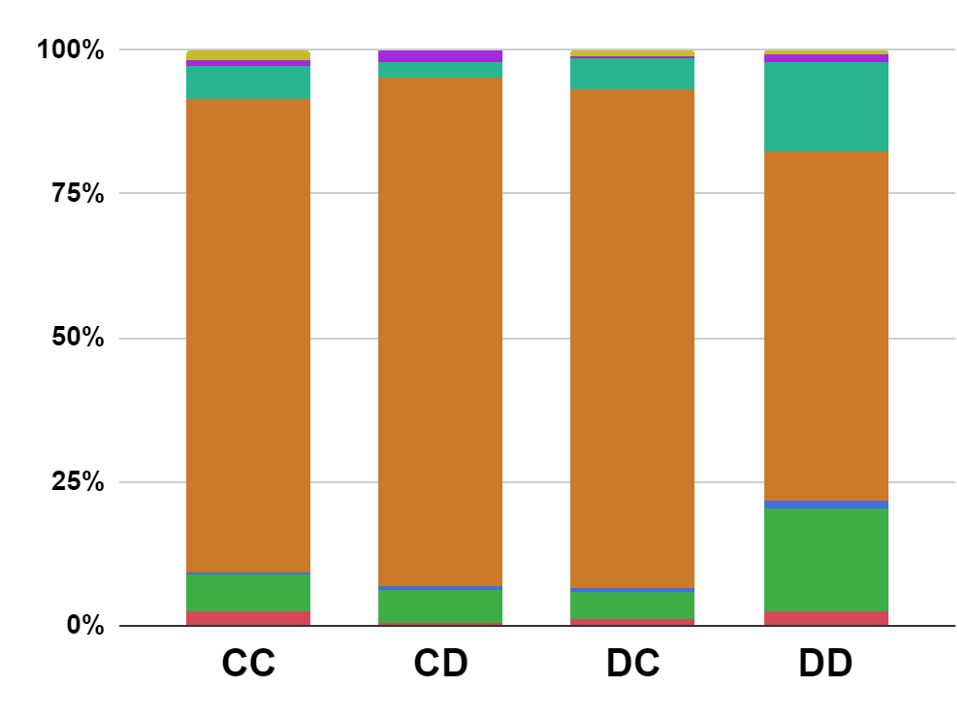

🖼️ 关键图片

📊 实验亮点

实验结果表明,结合贝叶斯线索整合(BCI)的方法显著提升了情绪识别的准确性。最佳的自动化方法获得了与人类观察者相当的结果,证明了该方法在复杂社交情境下的有效性。该研究在多种自动情绪识别方法上验证了BCI的有效性,表明其具有广泛的适用性。

🎯 应用场景

该研究成果可应用于人机交互、社交机器人、心理健康评估等领域。通过更准确地识别用户的情绪,系统可以提供更个性化、更贴心的服务。例如,在教育领域,系统可以根据学生的情绪状态调整教学内容和方式;在医疗领域,可以辅助医生进行心理疾病的诊断和治疗。

📄 摘要(原文)

Emotion recognition in social situations is a complex task that requires integrating information from both facial expressions and the situational context. While traditional approaches to automatic emotion recognition have focused on decontextualized signals, recent research emphasizes the importance of context in shaping emotion perceptions. This paper contributes to the emerging field of context-based emotion recognition by leveraging psychological theories of human emotion perception to inform the design of automated methods. We propose an approach that combines emotion recognition methods with Bayesian Cue Integration (BCI) to integrate emotion inferences from decontextualized facial expressions and contextual knowledge inferred via Large-language Models. We test this approach in the context of interpreting facial expressions during a social task, the prisoner's dilemma. Our results provide clear support for BCI across a range of automatic emotion recognition methods. The best automated method achieved results comparable to human observers, suggesting the potential for this approach to advance the field of affective computing.