Show, Don't Tell: Evaluating Large Language Models Beyond Textual Understanding with ChildPlay

作者: Gonçalo Hora de Carvalho, Oscar Knap, Robert Pollice

分类: cs.AI, cs.CL

发布日期: 2024-07-12 (更新: 2025-02-27)

🔗 代码/项目: GITHUB

💡 一句话要点

ChildPlay:通过游戏评估大语言模型在文本理解之外的泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 泛化能力 策略推理 空间理解 基准测试 游戏AI 化学信息学

📋 核心要点

- 现有大语言模型在文本理解方面表现出色,但其在策略推理和空间理解等方面的泛化能力仍有待考察。

- 论文提出ChildPlay基准测试集,通过一系列ASCII编码的简单游戏,评估大语言模型在策略和空间推理方面的能力。

- 实验结果表明,GPT模型在部分任务上表现出一定能力,但在复杂策略和空间推理任务上表现不佳,泛化能力有限。

📝 摘要(中文)

本文开发了一个基准测试集,旨在评估最先进的大语言模型在语言任务之外的问题上的泛化能力,并在GPT模型(GPT-3.5、GPT-4、GPT-4o、GPT-4o-mini)上进行了系统评估。通过井字游戏、四子棋、战舰游戏和形状识别游戏等简单的ASCII编码游戏,测试了模型的策略能力和空间推理能力,这些能力是人工智能解决化学问题所需掌握的核心能力。为了探究泛化能力,引入了两个新的空间逻辑游戏:LEGO Connect Language (LCL) 和 Guess-the-SMILES (GtS),后者是一个操作简单的化学基准。结果表明,GPT模型对多个任务提供了有意义的响应,但总体表现不佳。只有7个基准任务中的4个观察到模型能力增强带来的系统性能提升(GPT-3.5、GPT-4、GPT-4o)。所有模型在战舰游戏、LCL和GtS上都表现不佳。这表明,虽然GPT模型可以模拟对话能力和基本的规则理解,但在策略和空间推理方面的泛化能力有限。在解释ASCII编码的分子图时,性能尤其差。该开源基准测试套件(ChildPlay GitHub Repository)的结果提醒人们不要过分强调GPT模型中涌现的智能,因为它们似乎比通用智能更专业。

🔬 方法详解

问题定义:现有的大语言模型主要在文本理解任务上进行评估,缺乏对模型在策略推理和空间理解等方面的泛化能力的有效评估方法。现有方法难以区分模型是真正理解了问题,还是仅仅通过记忆和模式匹配来解决问题。

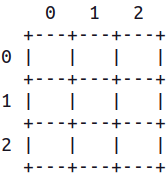

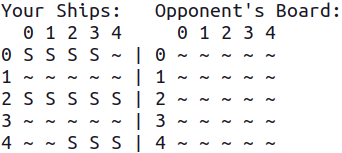

核心思路:论文的核心思路是通过设计一系列简单但具有挑战性的游戏,例如井字游戏、四子棋、战舰游戏等,来评估大语言模型在策略推理和空间理解方面的能力。这些游戏规则简单,但需要一定的策略和空间推理能力才能获胜,从而可以有效区分模型是否真正理解了问题。

技术框架:论文构建了一个名为ChildPlay的基准测试集,包含七个游戏任务:井字游戏、四子棋、战舰游戏、形状识别游戏、LEGO Connect Language (LCL) 和 Guess-the-SMILES (GtS)。所有游戏都以ASCII编码的形式呈现给模型。研究人员使用GPT-3.5、GPT-4、GPT-4o和GPT-4o-mini等模型在这些任务上进行评估,并分析模型的表现。

关键创新:论文的关键创新在于提出了一个专门用于评估大语言模型在策略推理和空间理解方面泛化能力的基准测试集ChildPlay。该基准测试集包含一系列精心设计的游戏任务,可以有效区分模型是否真正理解了问题,而不是仅仅通过记忆和模式匹配来解决问题。此外,论文还提出了两个新的空间逻辑游戏LCL和GtS,用于评估模型在化学领域的应用潜力。

关键设计:所有游戏都以ASCII编码的形式呈现给模型,这使得模型可以直接处理游戏状态,而无需进行额外的图像或语音处理。研究人员使用标准的提示工程技术来指导模型进行游戏,并使用标准的评估指标来衡量模型的表现。对于GtS任务,分子图以SMILES字符串的形式呈现给模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT模型在井字游戏和四子棋等简单游戏上表现出一定的能力,但在战舰游戏、LCL和GtS等复杂游戏上表现不佳。GPT-4o在大多数任务上优于GPT-3.5和GPT-4,但所有模型在解释ASCII编码的分子图时都表现出明显的困难。这表明,虽然GPT模型在某些方面取得了显著进展,但在策略推理和空间理解方面的泛化能力仍然有限。

🎯 应用场景

该研究成果可应用于评估和改进大语言模型在需要策略推理和空间理解的领域的应用,例如机器人导航、化学分子设计、游戏AI等。通过ChildPlay基准测试,可以更好地了解大语言模型的优势和局限性,从而指导模型的设计和训练,使其更好地适应实际应用场景。

📄 摘要(原文)

We developed a benchmark set to assess the generalization of state-of-the-art large language models on problems beyond linguistic tasks and evaluate it on a systematic progression of GPT models (GPT-3.5, GPT-4, GPT-4o, GPT-4o-mini). Using simple games like Tic-Tac-Toe, Connect Four, Battleship, and a Shape Recognition Game, all encoded in ASCII, we test strategic capabilities and spatial reasoning, core abilities any artificial intelligence would need to master for solving problems in chemistry. To probe generalization, we introduce two new games for spatial logic: LEGO Connect Language (LCL) and Guess-the-SMILES (GtS), a operationally simple chemistry benchmark. Our results show that GPT models provide meaningful responses for several tasks but, generally, perform poorly. A systematic performance progression with increased model capabilities (GPT-3.5, GPT-4, GPT-4o) is only observed for 4 out of the 7 benchmark tasks. All models consistently struggle with Battleship, LCL, and GtS. This suggests that while GPT models can emulate conversational proficiency and basic rule comprehension, they have limited generalization with respect to strategy and spatial reasoning. Particularly poor performance is observed for interpreting molecular graphs when encoded in ASCII. The results provided by our open-source benchmark suite (\href{https://github.com/BlueVelvetSackOfGoldPotatoes/child-play}{\texttt{ChildPlay} GitHub Repository}) caution against claims of emergent intelligence in GPT models, which appear more specialized than general.