TelecomGPT: A Framework to Build Telecom-Specfic Large Language Models

作者: Hang Zou, Qiyang Zhao, Yu Tian, Lina Bariah, Faouzi Bader, Thierry Lestable, Merouane Debbah

分类: eess.SP, cs.AI

发布日期: 2024-07-12

备注: arXiv admin note: text overlap with arXiv:1303.2654 by other authors

💡 一句话要点

提出TelecomGPT框架,构建电信领域专用大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电信领域 大语言模型 指令微调 持续预训练 数据集构建 评估基准 6G通信

📋 核心要点

- 现有通用LLM缺乏电信领域专业知识,限制了其在6G通信网络中的应用。

- TelecomGPT框架通过构建电信专用数据集,进行持续预训练、指令微调和对齐微调,使通用LLM适应电信领域。

- 实验表明,TelecomGPT在电信数学建模方面显著优于SOTA模型,并在其他电信任务中表现出竞争力。

📝 摘要(中文)

大型语言模型(LLM)有潜力彻底改变第六代(6G)通信网络。然而,目前主流的LLM普遍缺乏电信领域的专业知识。本文首次提出了一个将通用LLM适配为电信专用LLM的流程。我们收集并构建了电信领域的预训练数据集、指令数据集和偏好数据集,分别用于持续预训练、指令微调和对齐微调。此外,由于电信领域缺乏广泛接受的评估基准,我们扩展了现有的评估基准,并提出了三个新的基准,即电信数学建模、电信开放问答和电信代码任务。这些新基准全面评估了LLM在电信领域的数学建模、开放式问答、代码生成、填充、总结和分析等能力。我们微调的LLM TelecomGPT在电信数学建模基准测试中显著优于包括GPT-4、Llama-3和Mistral在内的最先进(SOTA)LLM,并在TeleQnA、3GPP技术文档分类、电信代码摘要和生成以及填充等各种评估基准中取得了相当的性能。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)在通用领域表现出色,但在电信领域缺乏专业的知识和技能。这限制了它们在电信网络优化、故障诊断、标准文档理解等方面的应用。因此,需要一种方法来使LLM具备电信领域的专业能力。

核心思路:TelecomGPT的核心思路是通过构建电信领域特定的数据集,对通用LLM进行微调,使其能够理解和处理电信领域的专业知识。具体来说,包括构建预训练数据集、指令数据集和偏好数据集,分别用于持续预训练、指令微调和对齐微调。

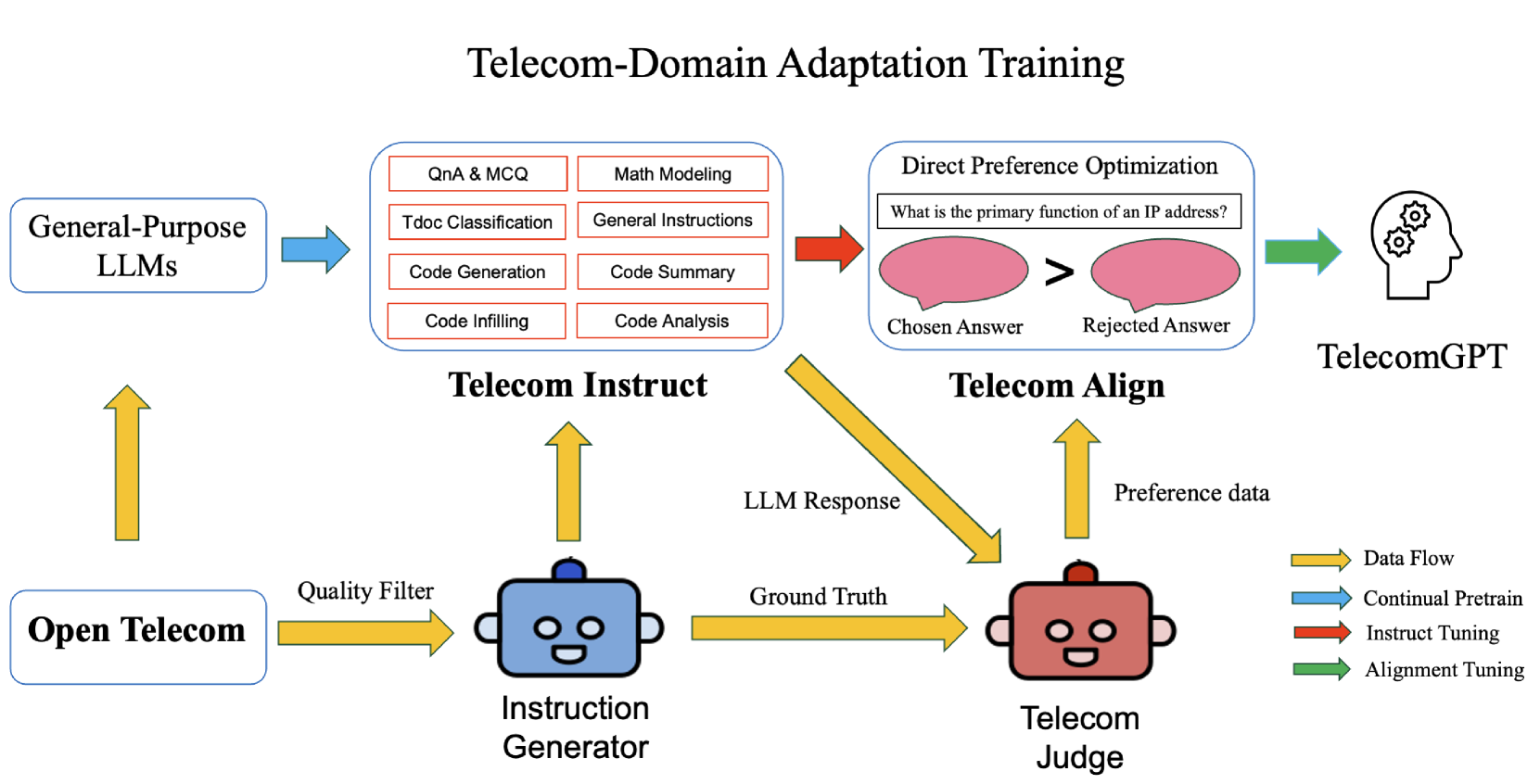

技术框架:TelecomGPT框架包含以下几个主要阶段:1) 数据收集与构建:收集电信领域的文本数据,包括技术文档、标准规范、论坛帖子等,并构建预训练数据集、指令数据集和偏好数据集。2) 持续预训练:使用电信领域的预训练数据集,对通用LLM进行持续预训练,使其掌握电信领域的基础知识。3) 指令微调:使用电信领域的指令数据集,对LLM进行指令微调,使其能够根据指令完成特定的电信任务。4) 对齐微调:使用电信领域的偏好数据集,对LLM进行对齐微调,使其输出更符合人类偏好。5) 评估:使用电信领域的评估基准,评估TelecomGPT的性能。

关键创新:TelecomGPT的关键创新在于提出了一个完整的流程,将通用LLM适配为电信专用LLM。此外,还构建了电信领域的预训练数据集、指令数据集和偏好数据集,并提出了新的评估基准,弥补了电信领域LLM研究的空白。

关键设计:在数据构建方面,需要仔细筛选和清洗电信领域的数据,确保数据的质量和相关性。在微调方面,需要选择合适的学习率、batch size等超参数,并采用合适的正则化方法,防止过拟合。在评估方面,需要选择合适的评估指标,并进行充分的实验,以全面评估TelecomGPT的性能。具体的数据集构建细节和超参数设置在论文中可能没有详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

TelecomGPT在电信数学建模基准测试中显著优于GPT-4、Llama-3和Mistral等SOTA模型。此外,TelecomGPT在TeleQnA、3GPP技术文档分类、电信代码摘要和生成以及填充等各种评估基准中取得了相当的性能。这些结果表明,TelecomGPT在电信领域具有很强的竞争力。

🎯 应用场景

TelecomGPT可应用于电信网络优化、故障诊断、客户服务、标准文档理解等领域。例如,可以利用TelecomGPT分析网络流量数据,优化网络配置;可以利用TelecomGPT诊断网络故障,提高故障排除效率;可以利用TelecomGPT回答客户关于电信服务的咨询,提高客户满意度。未来,TelecomGPT有望成为电信行业的重要工具,推动电信行业的智能化发展。

📄 摘要(原文)

Large Language Models (LLMs) have the potential to revolutionize the Sixth Generation (6G) communication networks. However, current mainstream LLMs generally lack the specialized knowledge in telecom domain. In this paper, for the first time, we propose a pipeline to adapt any general purpose LLMs to a telecom-specific LLMs. We collect and build telecom-specific pre-train dataset, instruction dataset, preference dataset to perform continual pre-training, instruct tuning and alignment tuning respectively. Besides, due to the lack of widely accepted evaluation benchmarks in telecom domain, we extend existing evaluation benchmarks and proposed three new benchmarks, namely, Telecom Math Modeling, Telecom Open QnA and Telecom Code Tasks. These new benchmarks provide a holistic evaluation of the capabilities of LLMs including math modeling, Open-Ended question answering, code generation, infilling, summarization and analysis in telecom domain. Our fine-tuned LLM TelecomGPT outperforms state of the art (SOTA) LLMs including GPT-4, Llama-3 and Mistral in Telecom Math Modeling benchmark significantly and achieve comparable performance in various evaluation benchmarks such as TeleQnA, 3GPP technical documents classification, telecom code summary and generation and infilling.