A Review of Nine Physics Engines for Reinforcement Learning Research

作者: Michael Kaup, Cornelius Wolff, Hyerim Hwang, Julius Mayer, Elia Bruni

分类: cs.AI, cs.LG, cs.MA

发布日期: 2024-07-11 (更新: 2024-08-23)

备注: 11 pages, 3 figures

💡 一句话要点

综述九种强化学习物理引擎,为研究者选择模拟环境提供指导

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 物理引擎 模拟环境 机器人控制 MuJoCo Unity 性能评估 综述

📋 核心要点

- 强化学习研究依赖物理引擎构建模拟环境,但选择合适的引擎面临诸多挑战,缺乏系统性的比较和评估。

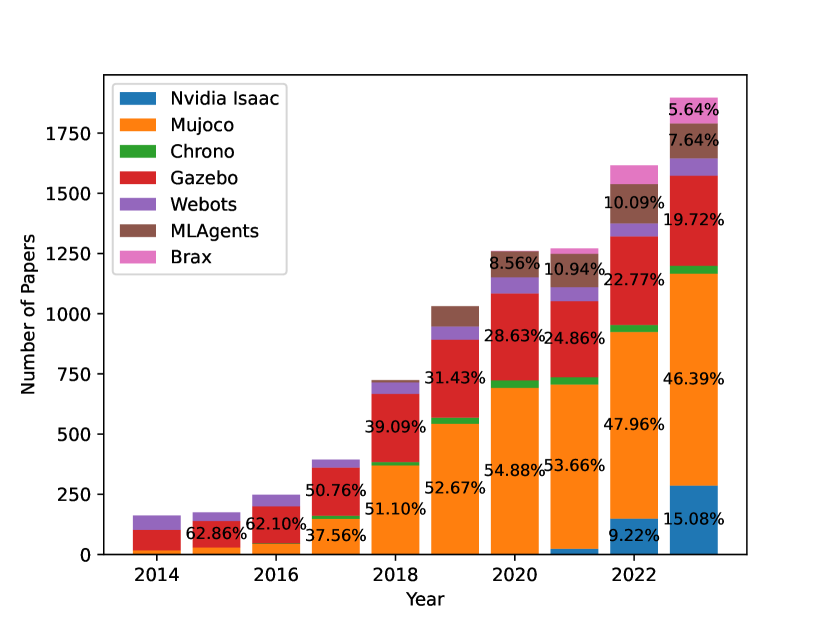

- 该综述对九种主流物理引擎进行全面评估,从受欢迎程度、功能、质量、易用性和RL能力等多维度进行对比分析。

- 研究结果表明MuJoCo在性能和灵活性方面表现突出,但可用性较差;Unity易于使用,但在可扩展性和仿真保真度方面存在不足。

📝 摘要(中文)

本文对强化学习(RL)研究中常用的模拟引擎和框架进行了综述,旨在指导研究人员选择合适的工具,为RL创建模拟物理环境和训练设置。评估了九个框架(Brax、Chrono、Gazebo、MuJoCo、ODE、PhysX、PyBullet、Webots和Unity),评估标准包括其受欢迎程度、功能范围、质量、可用性和RL能力。强调了为RL研究选择和利用物理引擎的挑战,包括需要详细的比较以及对每个框架功能的理解。主要发现表明,MuJoCo因其性能和灵活性而成为领先框架,但可用性方面存在挑战。Unity因其易用性而受到关注,但缺乏可扩展性和仿真保真度。该研究呼吁进一步开发以提高模拟引擎的可用性和性能,并强调RL研究中透明性和可重复性的重要性。本次综述通过提供对模拟引擎选择过程的见解,促进知情决策,为RL社区做出贡献。

🔬 方法详解

问题定义:强化学习研究需要高质量的物理模拟环境进行训练和验证。然而,现有物理引擎种类繁多,研究人员难以选择最适合自身需求的引擎。不同引擎在性能、精度、易用性等方面存在差异,缺乏统一的评估标准和详细的对比分析,导致选择过程困难,影响研究效率和结果的可重复性。

核心思路:该综述的核心思路是对主流物理引擎进行系统性的评估和比较,为研究人员提供选择指南。通过分析各个引擎的特点、优势和劣势,帮助研究人员根据自身研究的具体需求,选择最合适的物理引擎,从而提高研究效率和结果的可靠性。

技术框架:该综述主要包含以下几个阶段:1. 确定评估的物理引擎列表(Brax、Chrono、Gazebo、MuJoCo、ODE、PhysX、PyBullet、Webots和Unity)。2. 确定评估指标,包括受欢迎程度、功能范围、质量、可用性和RL能力。3. 收集和整理各个引擎的相关信息,包括官方文档、用户评价、性能测试结果等。4. 对各个引擎进行详细的评估和比较,分析其优缺点。5. 总结评估结果,为研究人员提供选择建议。

关键创新:该综述的关键创新在于对多个主流物理引擎进行了全面、系统的评估和比较,并从强化学习研究的角度出发,重点关注引擎的RL能力。以往的研究往往只关注单个引擎的性能或功能,缺乏对不同引擎的横向比较。该综述填补了这一空白,为研究人员提供了更全面的信息和更专业的指导。

关键设计:评估指标的设计是关键。除了常规的性能指标(如仿真速度、精度)外,还考虑了引擎的易用性(如API的简洁程度、文档的完善程度)和RL能力(如对RL算法的支持程度、与RL框架的兼容性)。此外,综述还对各个引擎的许可协议进行了分析,帮助研究人员了解使用引擎的法律风险。

🖼️ 关键图片

📊 实验亮点

该综述的关键发现是MuJoCo在性能和灵活性方面表现最佳,但可用性较差;Unity易于使用,但在可扩展性和仿真保真度方面存在不足。这些结论为研究人员选择物理引擎提供了重要的参考依据。此外,该综述还强调了RL研究中透明性和可重复性的重要性,呼吁研究人员公开其使用的物理引擎和参数设置,以便其他研究人员进行复现和验证。

🎯 应用场景

该研究成果可广泛应用于机器人控制、游戏AI、自动驾驶等领域。通过选择合适的物理引擎,可以更高效地训练智能体,提高其在真实环境中的适应性和鲁棒性。此外,该综述还有助于物理引擎的开发者了解用户需求,改进引擎的设计和功能,推动物理模拟技术的发展。

📄 摘要(原文)

We present a review of popular simulation engines and frameworks used in reinforcement learning (RL) research, aiming to guide researchers in selecting tools for creating simulated physical environments for RL and training setups. It evaluates nine frameworks (Brax, Chrono, Gazebo, MuJoCo, ODE, PhysX, PyBullet, Webots, and Unity) based on their popularity, feature range, quality, usability, and RL capabilities. We highlight the challenges in selecting and utilizing physics engines for RL research, including the need for detailed comparisons and an understanding of each framework's capabilities. Key findings indicate MuJoCo as the leading framework due to its performance and flexibility, despite usability challenges. Unity is noted for its ease of use but lacks scalability and simulation fidelity. The study calls for further development to improve simulation engines' usability and performance and stresses the importance of transparency and reproducibility in RL research. This review contributes to the RL community by offering insights into the selection process for simulation engines, facilitating informed decision-making.