Leveraging LLMs to Predict Affective States via Smartphone Sensor Features

作者: Tianyi Zhang, Songyan Teng, Hong Jia, Simon D'Alfonso

分类: cs.HC, cs.AI

发布日期: 2024-07-11

💡 一句话要点

利用大型语言模型和智能手机传感器数据预测情感状态

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感状态预测 大型语言模型 智能手机传感器 数字表型 移动健康

📋 核心要点

- 现有数字表型方法主要依赖统计和机器学习,难以充分挖掘智能手机传感器数据中的情感信息。

- 本研究提出利用大型语言模型(LLMs)直接从智能手机传感器数据预测情感状态,无需人工特征工程。

- 实验结果表明,LLMs在零样本和少样本设置下,能够有效预测大学生的情感状态,展现了其潜力。

📝 摘要(中文)

本研究旨在探索利用大型语言模型(LLMs)通过智能手机传感器数据预测情感状态。针对年轻人心理健康问题日益严峻的现状,本研究探索了利用智能手机(使用情况和传感器数据)等个人数字设备收集和分析数据,以推断行为和心理健康的数字表型方法。尽管传统方法主要采用统计和机器学习方法,但LLMs的出现为理解智能手机传感数据提供了一种新途径。本研究利用LLMs,基于大学生的智能手机传感数据来预测情感结果,弥合了LLMs在数字心理健康领域,特别是整合移动传感器数据方面的空白。研究结果表明,LLMs在推断一般幸福感方面具有有效性,仅使用智能手机传感数据即可对情感指标进行有希望的预测。这项研究揭示了LLMs在情感状态预测方面的潜力,强调了智能手机行为模式与情感状态之间的复杂联系。据我们所知,这是第一项利用LLMs进行情感状态预测和数字表型任务的研究。

🔬 方法详解

问题定义:本研究旨在解决如何利用智能手机传感器数据有效预测用户的情感状态。现有方法通常依赖于人工设计的特征和传统的机器学习模型,这些方法需要领域知识,并且特征工程耗时耗力。此外,传统方法难以捕捉传感器数据中复杂的行为模式与情感状态之间的关联。

核心思路:本研究的核心思路是利用大型语言模型(LLMs)强大的语义理解和推理能力,直接从智能手机传感器数据中学习情感状态的表征。通过将传感器数据转化为LLMs可以理解的输入形式,并利用LLMs进行情感预测,从而避免了人工特征工程的需要,并能够捕捉更复杂的情感模式。

技术框架:整体框架包括数据预处理、LLM输入构建和情感预测三个主要阶段。首先,对智能手机传感器数据进行清洗和标准化。然后,将处理后的传感器数据转化为LLMs可以理解的文本或嵌入表示。最后,利用LLMs进行情感预测,例如,通过分类或回归任务预测情感指标。

关键创新:本研究的关键创新在于首次将LLMs应用于智能手机传感器数据的情感状态预测。与传统方法相比,LLMs能够自动学习特征,并捕捉传感器数据中更复杂的情感模式。此外,本研究探索了零样本和少样本学习设置,进一步提高了模型的泛化能力。

关键设计:研究中,传感器数据被转换成文本描述,例如“用户在过去一小时内移动了X米,使用了Y分钟的社交媒体应用”。这些文本描述被输入到LLM中,LLM输出情感状态的预测。研究人员探索了不同的LLM架构和提示工程方法,以优化预测性能。损失函数根据具体的情感预测任务选择,例如,分类任务使用交叉熵损失,回归任务使用均方误差损失。

🖼️ 关键图片

📊 实验亮点

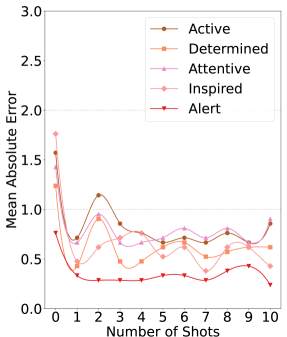

实验结果表明,LLMs在零样本和少样本设置下,能够有效预测大学生的情感状态。具体来说,在预测一般幸福感方面,LLMs取得了显著的性能提升,证明了其在情感状态预测方面的潜力。该研究为利用LLMs进行数字心理健康研究提供了新的思路和方法。

🎯 应用场景

该研究成果可应用于移动健康领域,为用户提供个性化的心理健康监测和干预服务。通过实时分析用户的智能手机传感器数据,可以及早发现潜在的心理健康问题,并及时提供支持和帮助。此外,该技术还可以应用于情绪识别、用户行为分析等领域,具有广泛的应用前景。

📄 摘要(原文)

As mental health issues for young adults present a pressing public health concern, daily digital mood monitoring for early detection has become an important prospect. An active research area, digital phenotyping, involves collecting and analysing data from personal digital devices such as smartphones (usage and sensors) and wearables to infer behaviours and mental health. Whilst this data is standardly analysed using statistical and machine learning approaches, the emergence of large language models (LLMs) offers a new approach to make sense of smartphone sensing data. Despite their effectiveness across various domains, LLMs remain relatively unexplored in digital mental health, particularly in integrating mobile sensor data. Our study aims to bridge this gap by employing LLMs to predict affect outcomes based on smartphone sensing data from university students. We demonstrate the efficacy of zero-shot and few-shot embedding LLMs in inferring general wellbeing. Our findings reveal that LLMs can make promising predictions of affect measures using solely smartphone sensing data. This research sheds light on the potential of LLMs for affective state prediction, emphasizing the intricate link between smartphone behavioral patterns and affective states. To our knowledge, this is the first work to leverage LLMs for affective state prediction and digital phenotyping tasks.