Privacy-Preserving Data Deduplication for Enhancing Federated Learning of Language Models (Extended Version)

作者: Aydin Abadi, Vishnu Asutosh Dasu, Sumanta Sarkar

分类: cs.CR, cs.AI, cs.CL, cs.LG

发布日期: 2024-07-11 (更新: 2024-12-04)

备注: Accepted at the Network and Distributed Systems Security (NDSS) Symposium, 2025

💡 一句话要点

提出EP-MPD协议,解决联邦学习中语言模型数据去重的隐私保护问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 数据去重 隐私保护 私有集合交集 语言模型

📋 核心要点

- 联邦学习中的数据去重可以提升模型性能并节省训练时间和能源,但直接共享数据进行去重会带来隐私风险。

- 论文提出EP-MPD协议,利用私有集合交集协议变体,在不泄露数据的前提下,高效地完成多方数据去重。

- 实验表明,EP-MPD在联邦学习中对大型语言模型进行去重,显著提升了模型困惑度并减少了运行时间。

📝 摘要(中文)

本文提出了一种名为高效隐私保护多方去重(EP-MPD)的协议,旨在解决联邦学习中数据去重的问题。该协议能够在不泄露客户端数据隐私的前提下,高效地去除多个客户端数据集中的重复数据。EP-MPD采用模块化设计,利用了两种新颖的私有集合交集协议变体。实验结果表明,在联邦学习中对大型语言模型进行去重具有显著优势。例如,在重复率介于10%到30%之间时,困惑度最多可提高19.62%,运行时间最多可减少27.95%。EP-MPD有效地平衡了联邦学习中的隐私和性能,使其成为大规模应用的有价值的解决方案。

🔬 方法详解

问题定义:联邦学习中的数据去重是一个重要的预处理步骤,可以提高模型性能和训练效率。然而,直接在联邦学习环境中进行数据去重面临隐私挑战,因为需要共享客户端的数据,这可能导致敏感信息泄露。现有方法难以在保证隐私的同时,实现高效的大规模数据去重。

核心思路:论文的核心思路是利用隐私保护技术,特别是私有集合交集(Private Set Intersection, PSI)协议,来实现多方数据去重。通过PSI协议,各方可以安全地计算出数据集的交集(即重复数据),而无需暴露各自的原始数据。论文进一步优化了PSI协议,使其更适用于大规模联邦学习环境。

技术框架:EP-MPD协议的整体框架包括以下几个主要阶段:1) 各客户端计算其数据集的指纹(fingerprint);2) 使用优化的PSI协议变体,安全地计算出所有客户端数据集指纹的交集;3) 各客户端根据交集结果,去除本地数据集中的重复数据。该框架采用模块化设计,允许灵活地选择和替换不同的PSI协议变体。

关键创新:论文的关键创新在于提出了两种新颖的私有集合交集协议变体,专门针对联邦学习中的数据去重场景进行了优化。这些变体在保证隐私的前提下,提高了计算效率和可扩展性。此外,EP-MPD协议的模块化设计也使其具有很强的灵活性和适应性。

关键设计:EP-MPD协议的关键设计包括:1) 使用高效的指纹算法来表示数据集,以减少PSI协议的计算量;2) 设计了两种不同的PSI协议变体,分别适用于不同的隐私和性能需求;3) 采用安全多方计算技术,确保在PSI协议执行过程中,任何一方都无法获取其他方的数据信息。

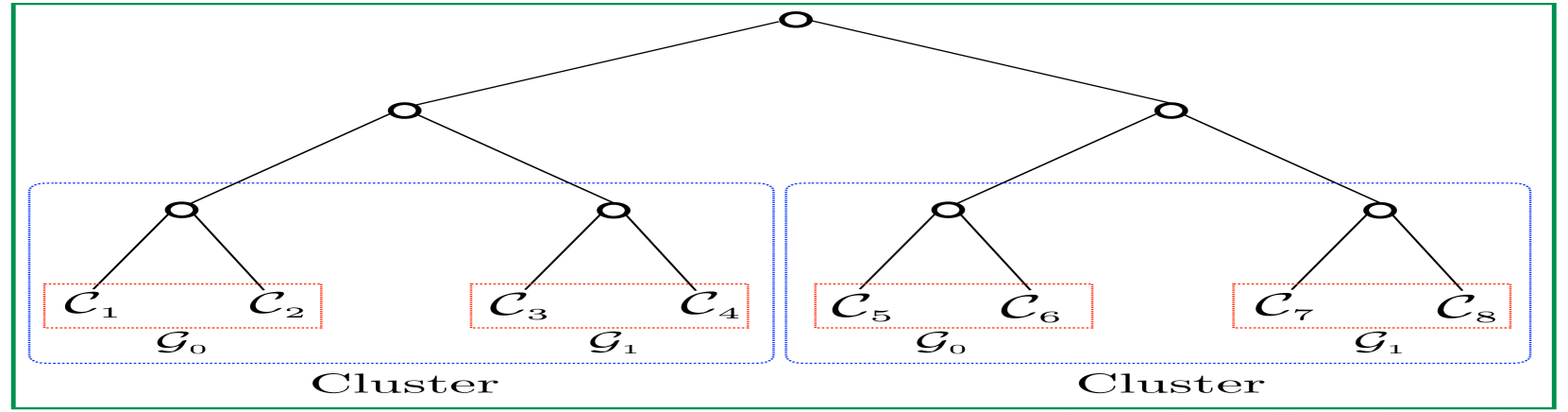

🖼️ 关键图片

📊 实验亮点

实验结果表明,EP-MPD协议在联邦学习中对大型语言模型进行去重时,能够显著提升模型性能并减少运行时间。具体来说,在重复率介于10%到30%之间时,模型的困惑度最多可提高19.62%,运行时间最多可减少27.95%。这些结果表明,EP-MPD协议在平衡隐私和性能方面具有显著优势。

🎯 应用场景

该研究成果可广泛应用于涉及联邦学习的自然语言处理任务,例如分布式语言模型训练、个性化推荐系统、以及金融和医疗等敏感数据领域。通过安全地去除重复数据,可以提高模型训练效率,改善模型性能,并保护用户隐私,从而促进联邦学习技术的更广泛应用。

📄 摘要(原文)

Deduplication is a vital preprocessing step that enhances machine learning model performance and saves training time and energy. However, enhancing federated learning through deduplication poses challenges, especially regarding scalability and potential privacy violations if deduplication involves sharing all clients' data. In this paper, we address the problem of deduplication in a federated setup by introducing a pioneering protocol, Efficient Privacy-Preserving Multi-Party Deduplication (EP-MPD). It efficiently removes duplicates from multiple clients' datasets without compromising data privacy. EP-MPD is constructed in a modular fashion, utilizing two novel variants of the Private Set Intersection protocol. Our extensive experiments demonstrate the significant benefits of deduplication in federated learning of large language models. For instance, we observe up to 19.62\% improvement in perplexity and up to 27.95\% reduction in running time while varying the duplication level between 10\% and 30\%. EP-MPD effectively balances privacy and performance in federated learning, making it a valuable solution for large-scale applications.