Solving for X and Beyond: Can Large Language Models Solve Complex Math Problems with More-Than-Two Unknowns?

作者: Kuei-Chun Kao, Ruochen Wang, Cho-Jui Hsieh

分类: cs.AI, cs.CL, cs.LG

发布日期: 2024-07-06

期刊: https://aclanthology.org/2024.findings-emnlp.980/

💡 一句话要点

提出BeyondX基准,揭示大语言模型在多未知数数学问题上的局限性,并提出Formulate-and-Solve策略。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学问题求解 多未知数问题 基准测试 提示工程 推理能力 自动化流程 问题公式化

📋 核心要点

- 现有数学问题基准测试通常只包含少量未知数,无法充分评估大型语言模型的推理能力。

- 论文提出Formulate-and-Solve策略,通过公式化问题并求解,有效处理任意数量未知数的数学问题。

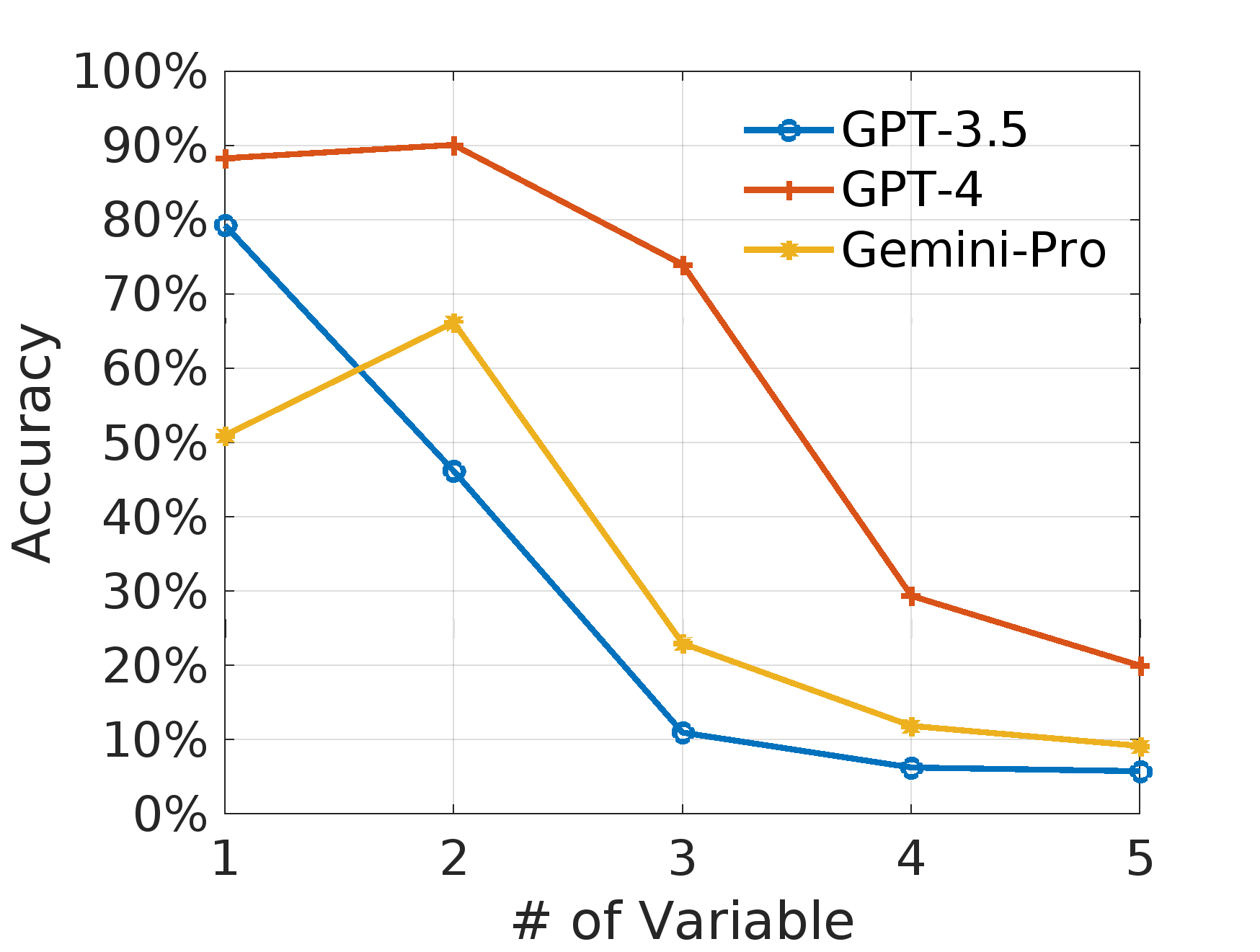

- 实验表明,即使是GPT-4,在多未知数问题上的性能也会显著下降,而Formulate-and-Solve策略能有效提升性能。

📝 摘要(中文)

大型语言模型(LLMs)在解决数学问题方面表现出了卓越的性能,这是人类智能的一个标志。然而,当前基准测试中的问题通常较为简单,仅包含一到两个未知数,未能充分挑战其推理能力。本文介绍了一个新的基准测试BeyondX,旨在通过包含多个未知数的问题来解决这些局限性。考虑到从头开始提出多未知数问题的挑战,我们开发了BeyondX,使用一种创新的自动化流程,通过逐步增加简单问题中未知数的数量来提高复杂性。对BeyondX的实证研究表明,现有LLM的性能,即使是那些专门针对数学任务进行微调的LLM,也会随着未知数数量的增加而显著下降——GPT-4的性能下降高达70%。为了应对这些挑战,我们提出了一种Formulate-and-Solve策略,这是一种通用的提示方法,可以有效地处理具有任意数量未知数的问题。我们的研究结果表明,这种策略不仅提高了LLM在BeyondX基准测试上的性能,而且还提供了对LLM在面对更复杂的数学挑战时的计算极限的更深入的了解。

🔬 方法详解

问题定义:论文旨在解决现有数学问题基准测试中,问题复杂度不足的问题。现有方法在处理包含多个未知数的复杂数学问题时,推理能力明显不足,无法有效解决此类问题。这限制了我们对LLM数学能力的全面评估,也阻碍了LLM在更复杂场景中的应用。

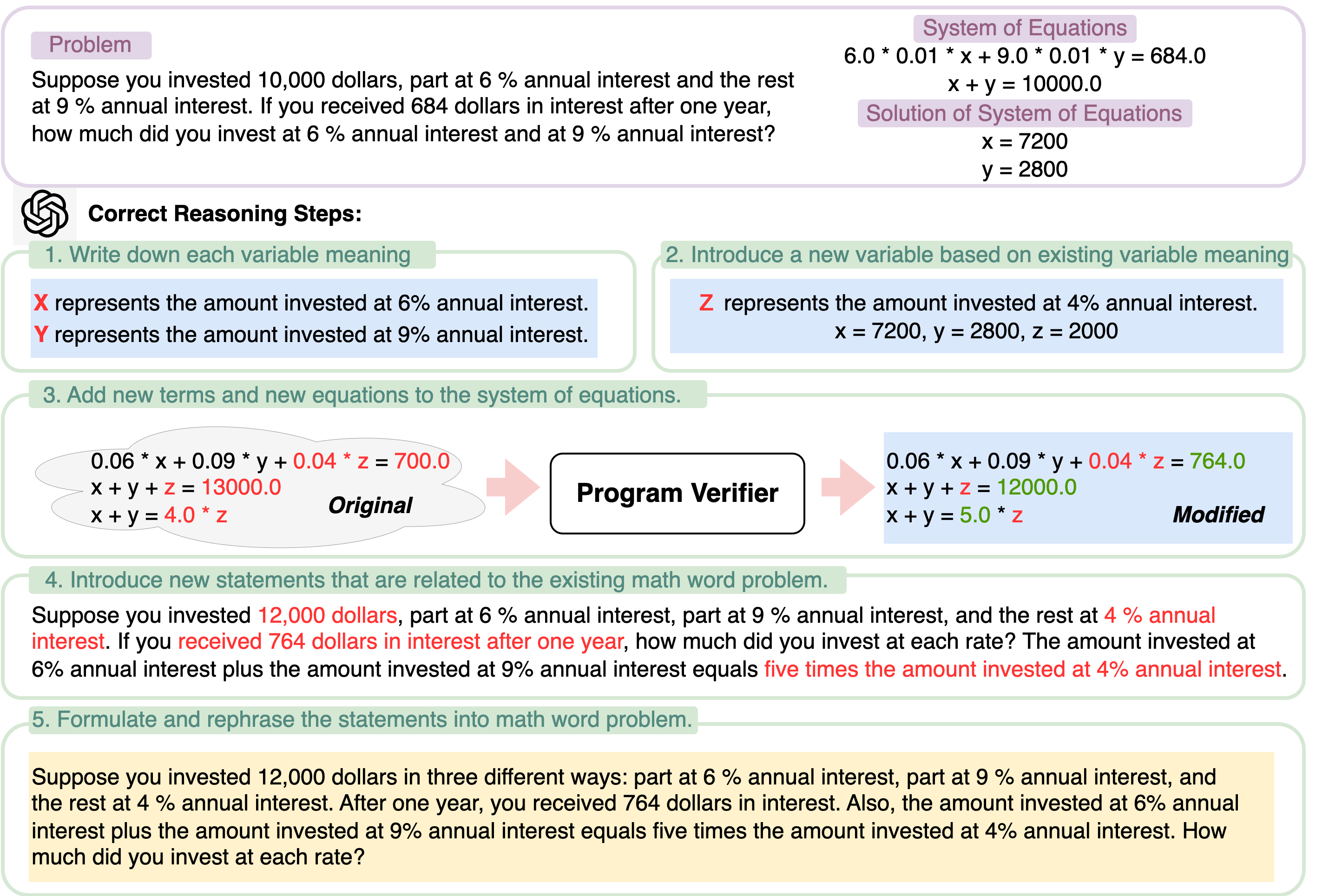

核心思路:论文的核心思路是,首先构建一个包含多个未知数的数学问题基准测试集BeyondX,然后提出一种通用的提示策略Formulate-and-Solve,引导LLM将复杂问题分解为公式化和求解两个阶段。这种分解能够降低问题的复杂度,使LLM更容易理解和解决。

技术框架:整体流程包括两个主要部分:1) BeyondX基准测试集的构建:通过自动化流程,逐步增加简单问题中未知数的数量,生成包含多个未知数的复杂数学问题。2) Formulate-and-Solve策略的应用:首先,提示LLM将问题公式化,即用数学公式表达问题中的关系;然后,提示LLM求解这些公式,得到最终答案。

关键创新:论文的关键创新在于:1) 提出了BeyondX基准测试集,填补了现有基准测试在多未知数问题上的空白。2) 提出了Formulate-and-Solve策略,这是一种通用的提示方法,可以有效处理具有任意数量未知数的数学问题。与现有方法相比,该策略能够更好地引导LLM进行推理,提高解决复杂问题的能力。

关键设计:在BeyondX的构建过程中,设计了自动化流程来保证问题的合理性和难度。在Formulate-and-Solve策略中,关键在于提示语的设计,需要清晰地引导LLM完成公式化和求解两个阶段。具体的提示语形式未知,论文中可能没有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在BeyondX基准测试集上,即使是GPT-4,其性能也会随着未知数数量的增加而显著下降,性能下降高达70%。而采用Formulate-and-Solve策略后,LLM的性能得到了显著提升,表明该策略能够有效应对多未知数数学问题带来的挑战。具体的性能提升幅度未知,论文中可能提供了更详细的数据。

🎯 应用场景

该研究成果可应用于教育领域,用于评估和提升学生的数学推理能力。同时,该方法可以扩展到其他需要复杂推理的领域,例如科学研究、工程设计等,帮助人们解决更复杂的问题。未来,可以进一步研究如何将该方法与其他技术相结合,例如符号计算、知识图谱等,以提高LLM在复杂问题上的解决能力。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable performance in solving math problems, a hallmark of human intelligence. Despite high success rates on current benchmarks; however, these often feature simple problems with only one or two unknowns, which do not sufficiently challenge their reasoning capacities. This paper introduces a novel benchmark, BeyondX, designed to address these limitations by incorporating problems with multiple unknowns. Recognizing the challenges in proposing multi-unknown problems from scratch, we developed BeyondX using an innovative automated pipeline that progressively increases complexity by expanding the number of unknowns in simpler problems. Empirical study on BeyondX reveals that the performance of existing LLMs, even those fine-tuned specifically on math tasks, significantly decreases as the number of unknowns increases - with a performance drop of up to 70\% observed in GPT-4. To tackle these challenges, we propose the Formulate-and-Solve strategy, a generalized prompting approach that effectively handles problems with an arbitrary number of unknowns. Our findings reveal that this strategy not only enhances LLM performance on the BeyondX benchmark but also provides deeper insights into the computational limits of LLMs when faced with more complex mathematical challenges.