LogicVista: Multimodal LLM Logical Reasoning Benchmark in Visual Contexts

作者: Yijia Xiao, Edward Sun, Tianyu Liu, Wei Wang

分类: cs.AI, cs.CL, cs.CV, cs.LG

发布日期: 2024-07-06

备注: LogicVista benchmarks the logical reasoning of multimodal large language models in visual tasks

🔗 代码/项目: GITHUB

💡 一句话要点

提出LogicVista基准,评估多模态LLM在视觉环境下的逻辑推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 逻辑推理 视觉理解 大型语言模型 评估基准

📋 核心要点

- 现有MLLM在逻辑推理能力方面缺乏系统性评估,阻碍了其在导航和解谜等需要复杂逻辑的任务中的应用。

- LogicVista基准通过多项选择题和人工标注的推理过程,全面评估MLLM在视觉环境下的逻辑推理能力。

- 实验结果表明,现有MLLM在LogicVista基准上表现不佳,突显了提升MLLM逻辑推理能力的必要性。

📝 摘要(中文)

本文提出了LogicVista,一个评估基准,旨在评估多模态大型语言模型(MLLM)在视觉环境中的综合逻辑推理能力。尽管MLLM在图像诗歌创作和数学推理等方面展现出令人瞩目的能力,但对于其逻辑推理能力的系统性评估仍然不足,而逻辑推理对于导航和解谜等任务至关重要。因此,我们使用包含448个多项选择题的样本,评估了MLLM在5个逻辑推理任务中涵盖的9种不同能力。每个问题都标注了正确答案和人工编写的推理过程,从而支持开放式和多项选择评估。我们使用LogicVista对总共8个MLLM进行了全面评估。代码和数据可在https://github.com/Yijia-Xiao/LogicVista获取。

🔬 方法详解

问题定义:现有的大型多模态模型(MLLM)在视觉理解和语言生成方面取得了显著进展,但其在视觉环境下的逻辑推理能力仍然缺乏系统的评估。现有的评估方法通常侧重于图像描述、视觉问答等任务,难以全面衡量模型在复杂逻辑推理方面的能力,尤其是在需要结合视觉信息进行推理的场景下。

核心思路:LogicVista的核心思路是构建一个专门用于评估MLLM在视觉环境下逻辑推理能力的基准数据集。该数据集包含多种逻辑推理任务,涵盖不同的逻辑推理能力,并提供人工标注的推理过程,从而可以对模型的推理过程进行深入分析。通过对MLLM在LogicVista上的表现进行评估,可以更全面地了解其逻辑推理能力,并为未来的模型改进提供指导。

技术框架:LogicVista基准包含以下几个主要组成部分:1) 数据集构建:设计了5个逻辑推理任务,涵盖9种不同的逻辑推理能力。2) 数据标注:为每个问题标注了正确答案和人工编写的推理过程。3) 评估指标:采用准确率等指标评估模型的性能,并分析模型的推理过程。4) 模型评估:使用LogicVista对8个MLLM进行了全面评估。

关键创新:LogicVista的关键创新在于其专注于评估MLLM在视觉环境下的逻辑推理能力,并提供了一个包含多种逻辑推理任务和人工标注推理过程的基准数据集。与现有的评估方法相比,LogicVista可以更全面、更深入地评估MLLM的逻辑推理能力。

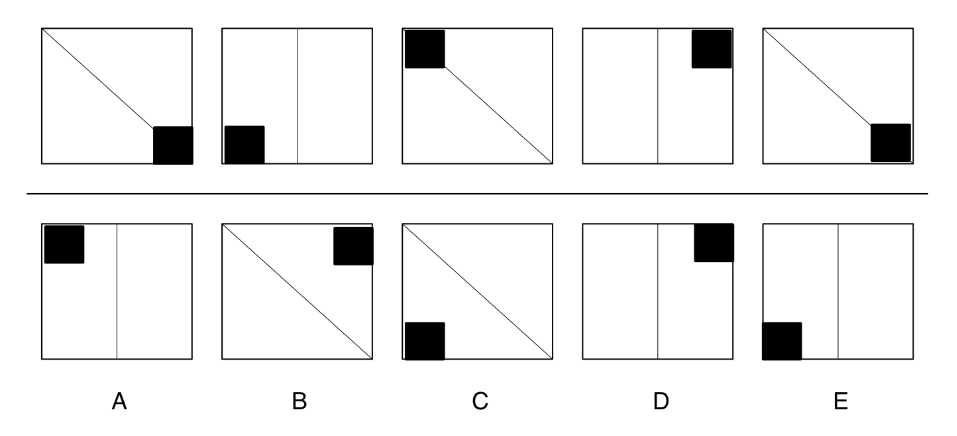

关键设计:LogicVista中的逻辑推理任务包括:1) 空间推理:考察模型对物体空间关系的理解能力。2) 因果推理:考察模型对事件因果关系的理解能力。3) 演绎推理:考察模型从一般性原则推导出具体结论的能力。4) 归纳推理:考察模型从具体事例归纳出一般性原则的能力。5) 类比推理:考察模型识别不同事物之间相似性的能力。每个问题都设计成多项选择题,并提供人工编写的推理过程,以便对模型的推理过程进行分析。

🖼️ 关键图片

📊 实验亮点

LogicVista基准对8个MLLM进行了全面评估,结果表明现有MLLM在视觉环境下的逻辑推理能力仍然有限。在多个逻辑推理任务上,模型的准确率远低于人类水平,表明MLLM在理解复杂视觉场景和进行逻辑推理方面仍有很大的提升空间。该基准的发布为后续研究提供了一个重要的评估工具。

🎯 应用场景

LogicVista的研究成果可应用于开发更智能的机器人、自动驾驶系统和智能助手。通过提升MLLM在视觉环境下的逻辑推理能力,可以使其更好地理解周围环境,并做出更合理的决策。例如,在自动驾驶领域,车辆需要具备强大的逻辑推理能力才能安全地导航和避开障碍物。在智能助手领域,助手需要具备逻辑推理能力才能更好地理解用户的需求并提供个性化的服务。

📄 摘要(原文)

We propose LogicVista, an evaluation benchmark that assesses the integrated logical reasoning capabilities of multimodal large language models (MLLMs) in Visual contexts. Recent advancements in MLLMs have demonstrated various fascinating abilities, from crafting poetry based on an image to performing mathematical reasoning. However, there is still a lack of systematic evaluation of MLLMs' proficiency in logical reasoning tasks, which are essential for activities like navigation and puzzle-solving. Thus we evaluate general logical cognition abilities across 5 logical reasoning tasks encompassing 9 different capabilities, using a sample of 448 multiple-choice questions. Each question is annotated with the correct answer and the human-written reasoning behind the selection, enabling both open-ended and multiple-choice evaluation. A total of 8 MLLMs are comprehensively evaluated using LogicVista. Code and Data Available at https://github.com/Yijia-Xiao/LogicVista.