Over the Edge of Chaos? Excess Complexity as a Roadblock to Artificial General Intelligence

作者: Teo Susnjak, Timothy R. McIntosh, Andre L. C. Barczak, Napoleon H. Reyes, Tong Liu, Paul Watters, Malka N. Halgamuge

分类: cs.AI, cs.CC

发布日期: 2024-07-04

💡 一句话要点

基于复杂性理论,揭示AI系统复杂性阈值对AGI发展的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 复杂性理论 通用人工智能 Agent-Based Modeling 临界阈值 大型语言模型

📋 核心要点

- 现有AI发展预测主要基于线性或指数增长,忽略了复杂系统可能存在的性能瓶颈和不稳定风险。

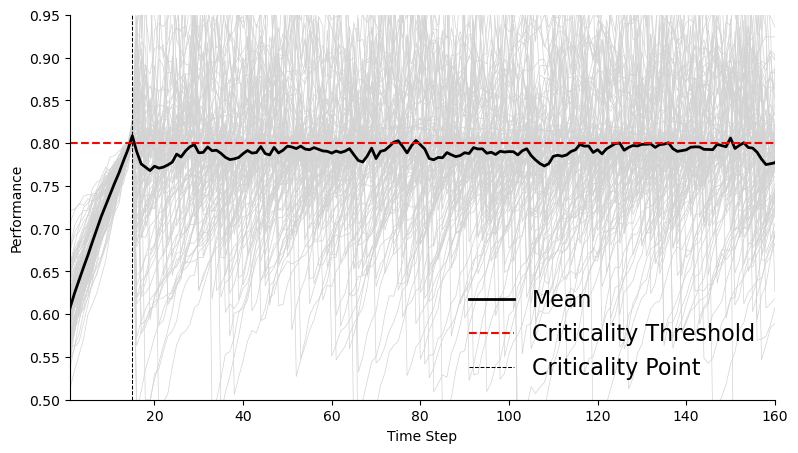

- 本研究利用Agent-Based Modeling模拟AI系统演化,探索复杂性增加对性能的影响,并寻找性能退化的临界阈值。

- 通过模拟实验,验证了AI系统复杂性存在上限阈值,超过该阈值可能导致性能下降,并提出了一种检测该阈值的方法。

📝 摘要(中文)

本研究从复杂性理论的角度探讨了人工智能(AI)系统的发展轨迹。我们挑战了基于Transformer架构的AI向通用人工智能(AGI)发展的传统线性或指数预测,并提出了临界点的概念,类似于复杂系统中的相变,即AI性能可能在超过临界复杂性阈值后停滞或退化为不稳定状态。我们采用基于Agent的建模(ABM)来模拟特定假设下AI系统演化的假设场景,使用基准性能作为能力和复杂性的代理。我们的模拟表明,增加AI系统的复杂性可能会超过一个上限临界阈值,导致不可预测的性能行为。此外,我们开发了一种实用的方法,利用模拟数据和随机梯度下降来微调检测阈值,从而检测这些临界阈值。这项研究为AI发展提供了一个新的视角,尤其与大型语言模型(LLM)相关,强调需要以一种温和的方式来推断AI的增长潜力,并强调开发更强大和全面的AI性能基准的重要性。

🔬 方法详解

问题定义:当前人工智能领域,特别是大型语言模型(LLM)的发展,普遍存在一种线性或指数增长的预期,认为通过不断增加模型规模和复杂性就能实现通用人工智能(AGI)。然而,这种观点忽略了复杂系统可能存在的临界点,即当系统复杂性超过一定阈值时,性能可能不再提升,甚至出现退化或不稳定。现有方法缺乏对这种复杂性阈值的有效评估和预测。

核心思路:本研究的核心思路是将人工智能系统视为一个复杂系统,借鉴复杂性理论中的相变概念,提出AI系统存在一个复杂性上限阈值。通过模拟AI系统的演化过程,观察其性能随复杂性增加的变化,从而寻找并评估这个阈值。这种思路强调了AI发展并非简单的线性增长,而是可能受到复杂性限制。

技术框架:该研究采用Agent-Based Modeling (ABM) 作为主要的模拟工具。ABM允许研究人员创建多个自主的“智能体”,并在一个共享环境中进行交互。在本研究中,每个智能体代表一个AI系统,其行为和性能受到预设规则和参数的影响。通过调整这些参数,可以模拟AI系统复杂性的变化,并观察其对整体性能的影响。研究流程包括:1) 定义AI系统的演化规则和性能指标;2) 使用ABM模拟不同复杂程度的AI系统;3) 分析模拟数据,寻找性能下降的临界阈值;4) 使用随机梯度下降等优化算法微调阈值检测方法。

关键创新:本研究的关键创新在于将复杂性理论引入人工智能研究,提出了AI系统存在复杂性上限阈值的概念。与传统的线性或指数增长预测不同,该研究强调了AI发展可能存在的瓶颈和风险。此外,该研究还提出了一种基于ABM和随机梯度下降的实用方法,用于检测这些临界阈值,为AI系统的设计和优化提供了新的思路。

关键设计:在ABM模拟中,关键设计包括:1) 定义AI系统的复杂性度量,例如模型参数数量、连接复杂度等;2) 设计AI系统的演化规则,例如学习算法、知识获取方式等;3) 选择合适的性能指标,例如准确率、效率等;4) 使用随机梯度下降算法优化阈值检测模型,例如调整学习率、迭代次数等。此外,还需要对模拟结果进行统计分析,例如计算置信区间、进行显著性检验等,以确保结果的可靠性。

🖼️ 关键图片

📊 实验亮点

研究通过Agent-Based Modeling模拟了AI系统在不同复杂程度下的性能表现,发现当复杂性超过一定阈值时,系统性能会出现显著下降。通过随机梯度下降算法,成功地对该阈值进行了检测和微调,为AI系统的设计和优化提供了量化的依据。

🎯 应用场景

该研究成果可应用于指导大型语言模型(LLM)的设计和优化,避免过度追求模型规模和复杂性,从而提高资源利用效率和系统稳定性。此外,该研究提出的复杂性阈值检测方法,可用于评估不同AI系统的潜在风险,为AI治理和安全提供参考。

📄 摘要(原文)

In this study, we explored the progression trajectories of artificial intelligence (AI) systems through the lens of complexity theory. We challenged the conventional linear and exponential projections of AI advancement toward Artificial General Intelligence (AGI) underpinned by transformer-based architectures, and posited the existence of critical points, akin to phase transitions in complex systems, where AI performance might plateau or regress into instability upon exceeding a critical complexity threshold. We employed agent-based modelling (ABM) to simulate hypothetical scenarios of AI systems' evolution under specific assumptions, using benchmark performance as a proxy for capability and complexity. Our simulations demonstrated how increasing the complexity of the AI system could exceed an upper criticality threshold, leading to unpredictable performance behaviours. Additionally, we developed a practical methodology for detecting these critical thresholds using simulation data and stochastic gradient descent to fine-tune detection thresholds. This research offers a novel perspective on AI advancement that has a particular relevance to Large Language Models (LLMs), emphasising the need for a tempered approach to extrapolating AI's growth potential and underscoring the importance of developing more robust and comprehensive AI performance benchmarks.