Tradeoffs When Considering Deep Reinforcement Learning for Contingency Management in Advanced Air Mobility

作者: Luis E. Alvarez, Marc W. Brittain, Steven D. Young

分类: cs.AI, cs.LG

发布日期: 2024-06-28

💡 一句话要点

针对先进空中交通的应急管理,探索深度强化学习的权衡方案

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 先进空中交通 应急管理 自动化 马尔可夫决策过程

📋 核心要点

- 现有应急管理系统难以适应AAM中车辆异构性和环境快速变化带来的复杂性。

- 利用深度强化学习(DRL)构建智能体,通过顺序决策来应对复杂环境中的风险。

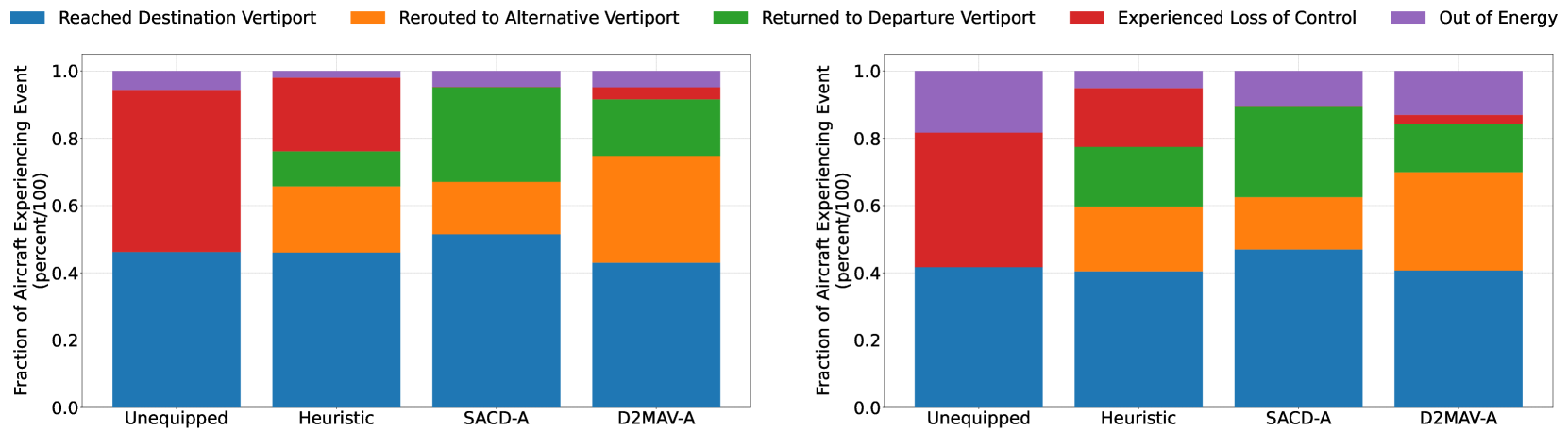

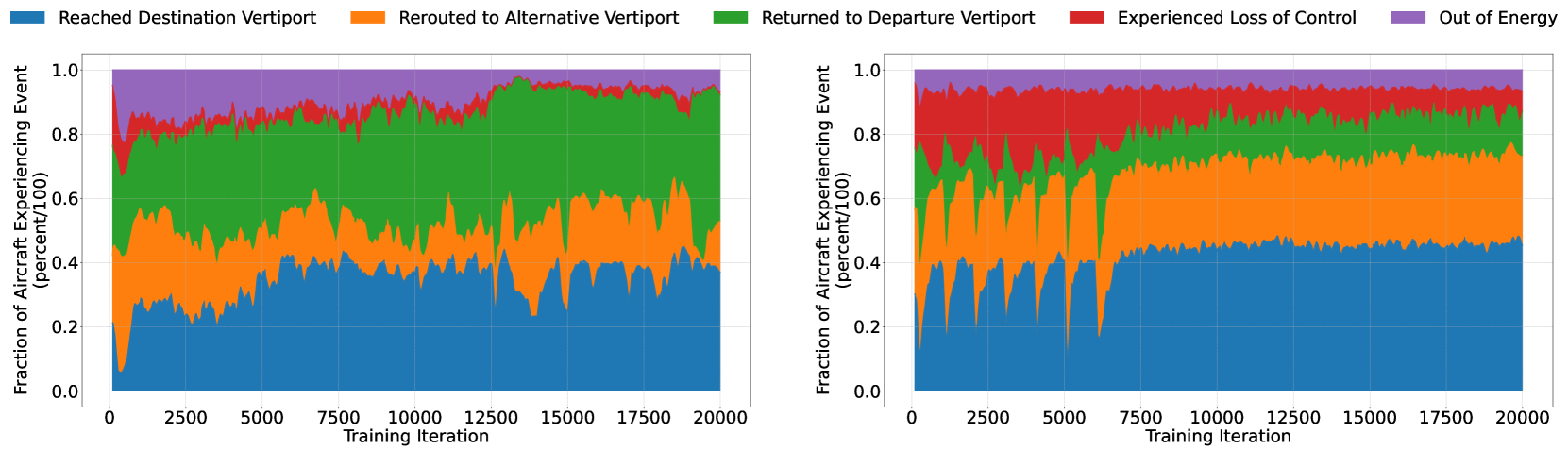

- 对比DRL智能体与传统方法,评估其在性能、验证难度和开发过程中的优劣。

📝 摘要(中文)

随着先进空中交通(AAM)在全球范围内的快速发展,航空运输正经历着一场变革,同时也带来了新的挑战和机遇。由于AAM运营引入了车辆能力和密度的日益异构性,可能需要更高水平的自动化才能实现运营安全和效率目标。本文重点关注增加自动化的一个例子。自主运营将需要应急管理系统,该系统可以监控一系列相互关联(或相互依赖)的危险中不断演变的风险,并在必要时通过监督或自动决策执行适当的控制干预。适应这种复杂环境可能需要应用人工智能(AI)技术的自动化功能(自主性),这些技术可以适应并响应快速变化的环境。本文探讨了深度强化学习(DRL)的应用,该方法在复杂和高维环境中表现出良好的性能,其中目标可以构建为顺序决策问题。本文提出了先前应急管理问题作为马尔可夫决策过程(MDP)的扩展,并使用DRL框架来训练智能体,以减轻模拟环境中存在的危害。将这些基于学习的智能体与经典技术在性能、验证难度和开发过程方面进行了比较。

🔬 方法详解

问题定义:论文旨在解决先进空中交通(AAM)中日益复杂的应急管理问题。现有方法难以适应AAM运营中车辆能力和密度的异构性,以及环境的快速变化,导致难以有效监控和应对潜在风险。传统方法在处理高维、动态的环境时可能效率低下,无法快速做出适应性决策。

核心思路:论文的核心思路是利用深度强化学习(DRL)来训练智能体,使其能够自主地学习如何在复杂的AAM环境中进行应急管理。DRL通过与环境的交互,学习最优的策略,从而能够适应环境的变化并做出相应的决策。这种方法旨在提高应急管理系统的自动化水平和适应性。

技术框架:该研究扩展了先前将应急管理问题建模为马尔可夫决策过程(MDP)的方法。整体框架包括:1) 定义AAM环境的状态空间、动作空间和奖励函数;2) 使用DRL算法(具体算法未知,论文中未明确说明)训练智能体;3) 在模拟环境中评估智能体的性能,并与传统方法进行比较。

关键创新:该研究的关键创新在于将深度强化学习应用于AAM的应急管理。与传统方法相比,DRL能够通过学习自动适应环境的变化,无需人工设计复杂的规则或策略。这种方法有望提高应急管理系统的自动化水平和鲁棒性。

关键设计:论文中未提供关于DRL算法、网络结构、损失函数和参数设置的具体细节。这些细节对于复现和进一步研究至关重要,但目前未知。

🖼️ 关键图片

📊 实验亮点

论文对比了基于DRL的智能体与传统方法在应急管理中的性能,但具体的性能数据、对比基线和提升幅度在摘要中未明确给出。论文强调了在性能、验证难度和开发过程等方面对两种方法的权衡分析,但具体结果未知。

🎯 应用场景

该研究成果可应用于先进空中交通(AAM)的自动化应急管理系统,提升飞行安全和运营效率。通过自主学习和适应,DRL智能体能够有效应对各种突发情况,减少人为干预,降低事故风险。未来,该技术还可扩展到其他复杂系统的自动化控制,如自动驾驶、智能电网等。

📄 摘要(原文)

Air transportation is undergoing a rapid evolution globally with the introduction of Advanced Air Mobility (AAM) and with it comes novel challenges and opportunities for transforming aviation. As AAM operations introduce increasing heterogeneity in vehicle capabilities and density, increased levels of automation are likely necessary to achieve operational safety and efficiency goals. This paper focuses on one example where increased automation has been suggested. Autonomous operations will need contingency management systems that can monitor evolving risk across a span of interrelated (or interdependent) hazards and, if necessary, execute appropriate control interventions via supervised or automated decision making. Accommodating this complex environment may require automated functions (autonomy) that apply artificial intelligence (AI) techniques that can adapt and respond to a quickly changing environment. This paper explores the use of Deep Reinforcement Learning (DRL) which has shown promising performance in complex and high-dimensional environments where the objective can be constructed as a sequential decision-making problem. An extension of a prior formulation of the contingency management problem as a Markov Decision Process (MDP) is presented and uses a DRL framework to train agents that mitigate hazards present in the simulation environment. A comparison of these learning-based agents and classical techniques is presented in terms of their performance, verification difficulties, and development process.