Improving the Consistency in Cross-Lingual Cross-Modal Retrieval with 1-to-K Contrastive Learning

作者: Zhijie Nie, Richong Zhang, Zhangchi Feng, Hailang Huang, Xudong Liu

分类: cs.IR, cs.AI, cs.MM

发布日期: 2024-06-26

备注: Accepted by KDD 2024 Research Track

💡 一句话要点

提出1-to-K对比学习,提升跨语言跨模态检索一致性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 跨语言跨模态检索 对比学习 多模态学习 信息检索 一致性学习

📋 核心要点

- 现有跨语言跨模态检索方法存在模态内误差传播和模态间优化偏差,导致检索结果在不同语言间不一致。

- 提出1-to-K对比学习方法,平等对待每种语言,消除误差传播和优化偏差,从而提升检索一致性。

- 实验结果表明,该方法在四个数据集上均取得了显著提升,并在召回率和平均排序方差指标上达到新的最优。

📝 摘要(中文)

跨语言跨模态检索(CCR)是Web搜索中的一项重要任务,旨在打破模态和语言之间的障碍,通过单一模型实现多语言场景下的图文检索。近年来,基于跨语言跨模态预训练取得了显著进展;特别是,基于大规模数据对比学习的方法显著提升了检索任务的性能。然而,这些方法直接沿用跨语言或跨模态领域中现有的预训练方法,导致CCR中出现两种不一致性问题:跨语言风格的方法存在模态内误差传播,导致整个数据集中不同语言的召回性能不一致;跨模态风格的方法存在模态间优化方向偏差,导致每个实例中不同语言的排序不一致,而召回率@K无法反映这一点。为了解决这些问题,我们提出了一种简单而有效的1-to-K对比学习方法,该方法平等对待每种语言,并消除误差传播和优化偏差。此外,我们提出了一种新的评估指标,平均排序方差(MRV),以反映每个实例中不同语言之间的排序不一致性。在四个CCR数据集上的大量实验表明,我们的方法以更小规模的预训练数据提高了召回率和MRV,实现了新的state-of-the-art。

🔬 方法详解

问题定义:论文旨在解决跨语言跨模态检索(CCR)中,由于现有方法存在的误差传播和优化偏差导致检索结果在不同语言间不一致的问题。现有方法要么侧重跨语言,导致模态内误差传播;要么侧重跨模态,导致模态间优化方向偏差,最终影响检索结果的一致性。

核心思路:论文的核心思路是提出一种1-to-K对比学习方法,将每种语言平等对待,从而消除误差传播和优化偏差。通过这种方式,模型能够学习到更鲁棒的跨语言跨模态表示,从而提升检索结果的一致性。

技术框架:整体框架包含图像编码器、文本编码器以及1-to-K对比学习模块。图像和文本分别通过各自的编码器提取特征,然后通过1-to-K对比学习模块进行训练,目标是使同一图像的不同语言描述在特征空间中更接近,同时远离其他图像的描述。

关键创新:最重要的技术创新点在于1-to-K对比学习策略,它与传统的对比学习方法不同,不是简单地将图像和文本进行配对,而是将每个图像与所有语言的文本描述进行对比,从而确保模型能够学习到与语言无关的图像表示。此外,提出了新的评估指标MRV,用于衡量排序一致性。

关键设计:1-to-K对比学习损失函数的设计是关键。具体来说,对于每个图像,模型需要区分其对应的K个语言描述与其他图像的描述。损失函数可以采用InfoNCE loss等形式,通过调整温度系数等参数来控制对比学习的难度。此外,图像编码器和文本编码器的选择也会影响最终的性能,可以选择预训练的视觉模型和语言模型。

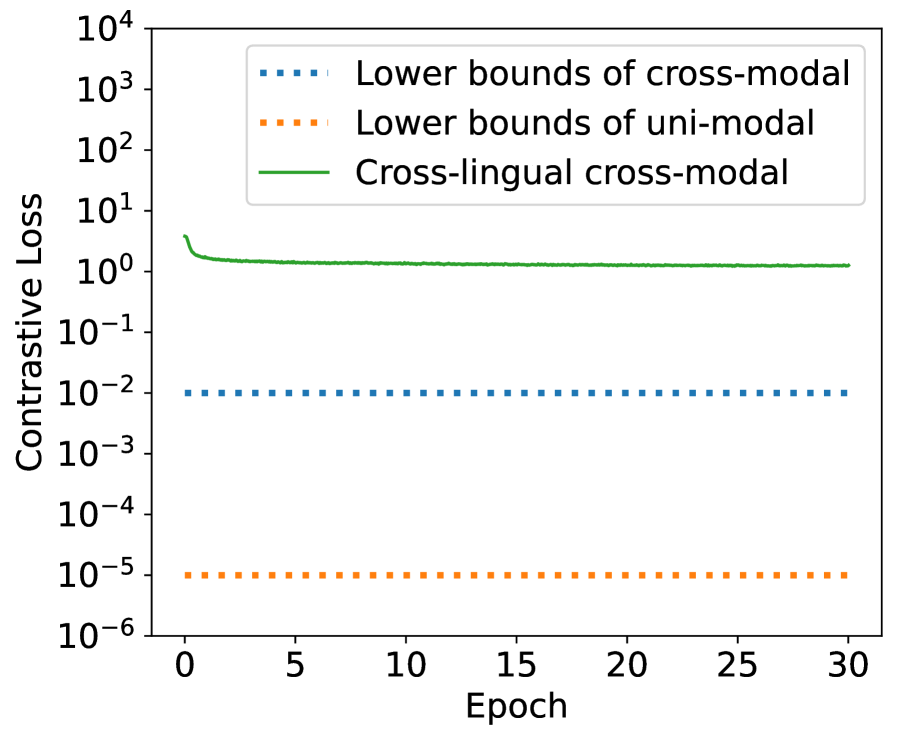

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的1-to-K对比学习方法在四个跨语言跨模态检索数据集上均取得了显著提升。例如,在X-IR数据集上,Recall@1指标提升了超过5个百分点,同时MRV指标也得到了显著改善,表明检索结果的一致性得到了有效提升。该方法在更小规模的预训练数据下,超越了现有最优方法,实现了新的state-of-the-art。

🎯 应用场景

该研究成果可应用于多语言搜索引擎、跨语言电商平台、多语言新闻推荐等领域。通过提升跨语言跨模态检索的一致性,可以为用户提供更准确、更全面的信息检索服务,打破语言障碍,促进不同文化之间的交流与理解。未来,该技术还可扩展到视频检索、语音检索等更多模态和语言的场景。

📄 摘要(原文)

Cross-lingual Cross-modal Retrieval (CCR) is an essential task in web search, which aims to break the barriers between modality and language simultaneously and achieves image-text retrieval in the multi-lingual scenario with a single model. In recent years, excellent progress has been made based on cross-lingual cross-modal pre-training; particularly, the methods based on contrastive learning on large-scale data have significantly improved retrieval tasks. However, these methods directly follow the existing pre-training methods in the cross-lingual or cross-modal domain, leading to two problems of inconsistency in CCR: The methods with cross-lingual style suffer from the intra-modal error propagation, resulting in inconsistent recall performance across languages in the whole dataset. The methods with cross-modal style suffer from the inter-modal optimization direction bias, resulting in inconsistent rank across languages within each instance, which cannot be reflected by Recall@K. To solve these problems, we propose a simple but effective 1-to-K contrastive learning method, which treats each language equally and eliminates error propagation and optimization bias. In addition, we propose a new evaluation metric, Mean Rank Variance (MRV), to reflect the rank inconsistency across languages within each instance. Extensive experiments on four CCR datasets show that our method improves both recall rates and MRV with smaller-scale pre-trained data, achieving the new state-of-art.