APEER: Automatic Prompt Engineering Enhances Large Language Model Reranking

作者: Can Jin, Hongwu Peng, Shiyu Zhao, Zhenting Wang, Wujiang Xu, Ligong Han, Jiahui Zhao, Kai Zhong, Sanguthevar Rajasekaran, Dimitris N. Metaxas

分类: cs.AI

发布日期: 2024-06-20 (更新: 2025-05-20)

💡 一句话要点

提出APEER,通过自动Prompt工程提升大语言模型重排序效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动Prompt工程 大语言模型 信息检索 重排序 偏好优化

📋 核心要点

- 现有LLM重排序依赖人工Prompt工程,成本高且效果受限,缺乏针对IR重排序的自动Prompt优化方法。

- APEER通过反馈和偏好优化迭代生成更优Prompt,无需人工干预,降低了Prompt工程的成本。

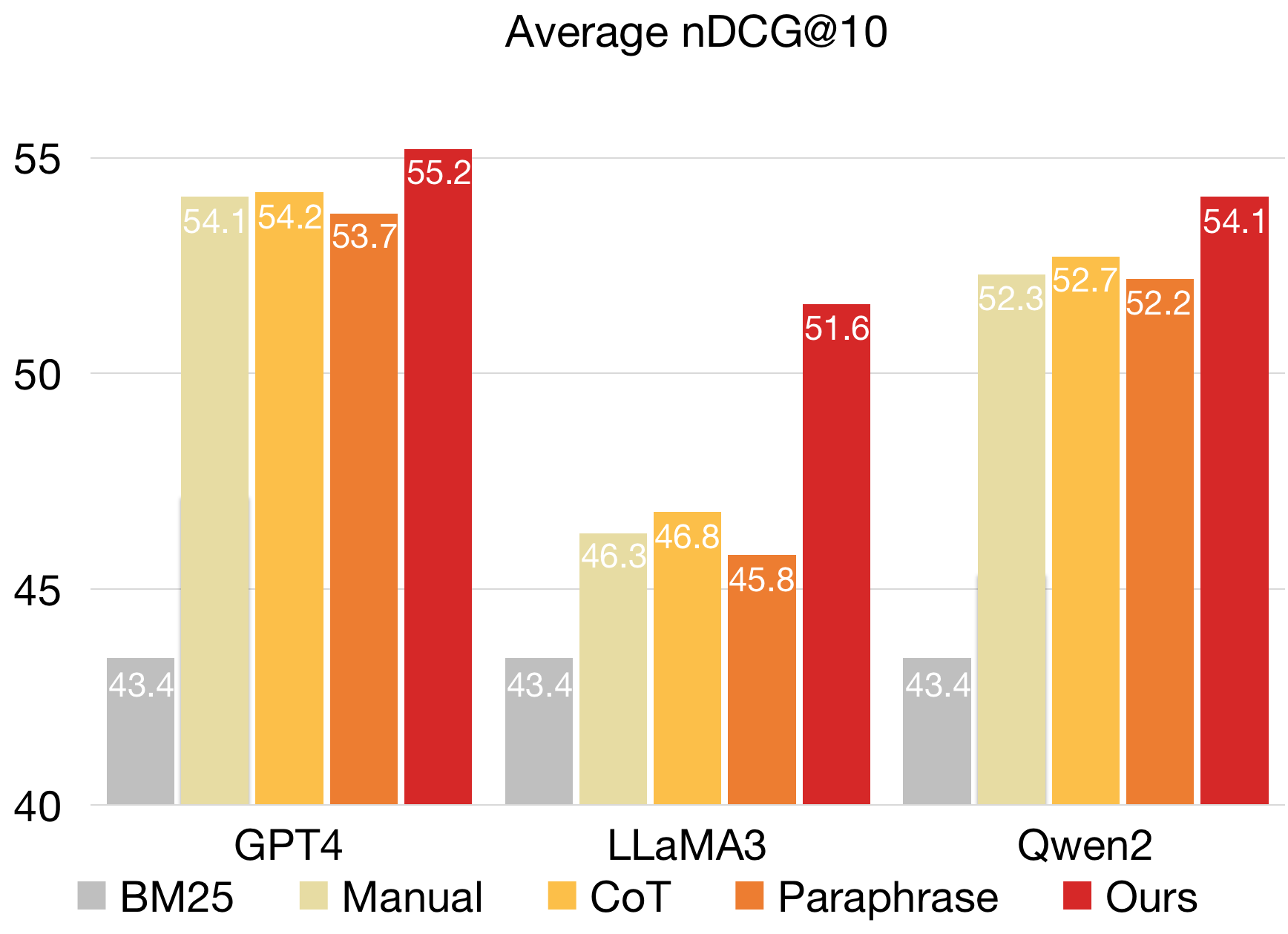

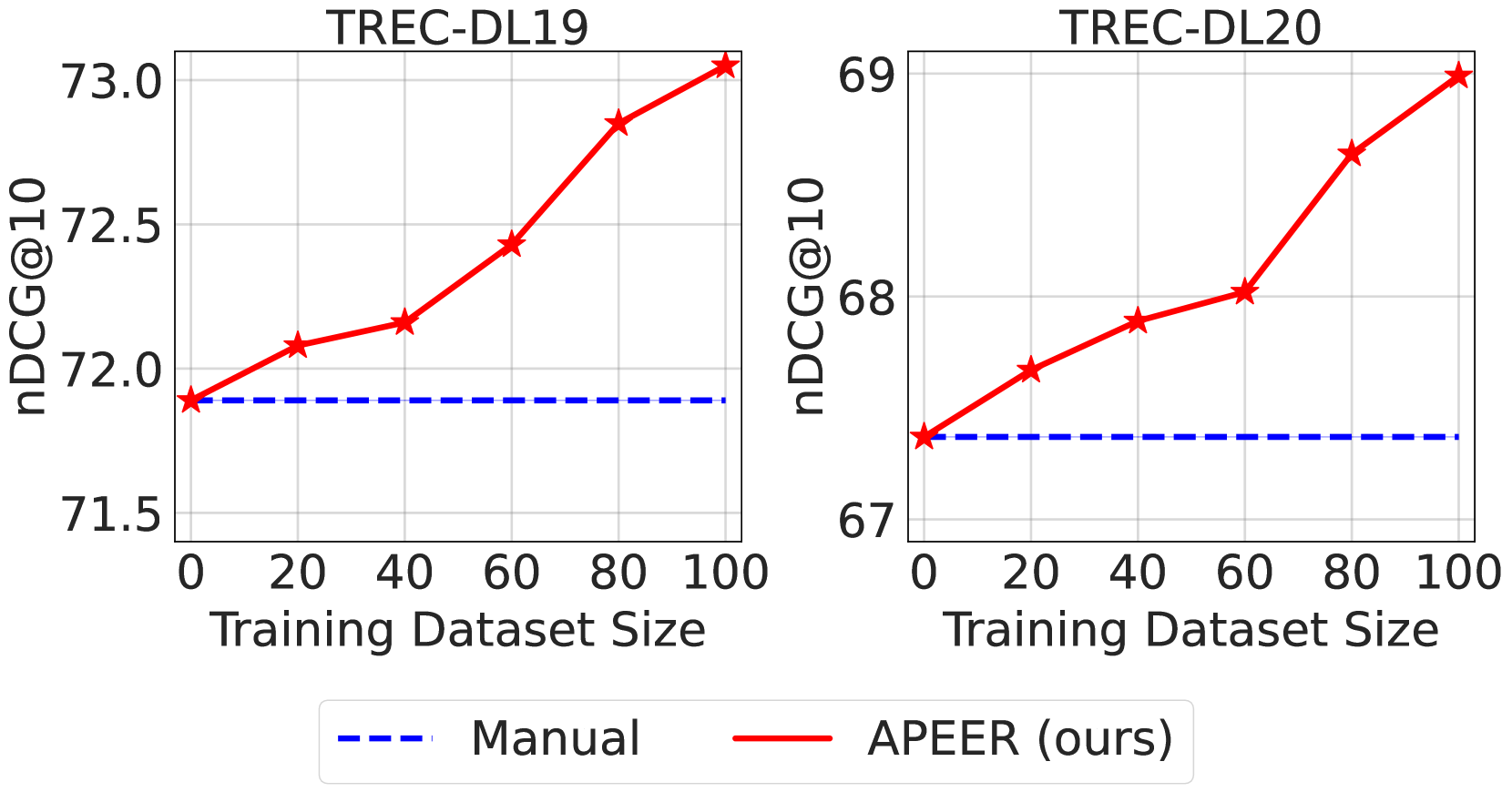

- 实验表明,APEER在多个LLM和数据集上显著优于人工Prompt,并具有更好的跨任务和模型迁移性。

📝 摘要(中文)

大型语言模型(LLMs)显著增强了信息检索(IR)的各个模块,例如重排序。尽管性能令人印象深刻,但目前LLMs的零样本相关性排序严重依赖于人工Prompt工程。现有的自动Prompt工程算法主要集中在语言建模和分类任务上,而IR领域,特别是重排序,尚未得到充分探索。由于输入中集成了查询和长文本对,直接将当前的Prompt工程算法应用于相关性排序具有挑战性,因为排序的复杂性超过了分类任务。为了减少人工工作量并释放Prompt优化在重排序中的潜力,我们提出了一种名为APEER的新型自动Prompt工程算法。APEER通过反馈和偏好优化迭代生成改进的Prompt。对四个LLM和十个数据集进行的大量实验表明,APEER相对于现有的最先进(SoTA)人工Prompt,性能得到了显著提高。此外,我们发现APEER生成的Prompt在不同的任务和LLM中表现出更好的可迁移性。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在信息检索(IR)重排序任务中对人工Prompt工程的依赖问题。现有方法需要大量人工设计和调整Prompt,耗时耗力,且难以保证Prompt的最优性。直接将现有的自动Prompt工程方法应用于重排序任务面临挑战,因为重排序任务涉及查询和文档对的复杂交互,远超分类任务的复杂度。

核心思路:APEER的核心思路是通过自动化的方式,迭代地优化Prompt,使其更适合LLM进行重排序任务。它借鉴了强化学习中的反馈机制,通过评估LLM在不同Prompt下的重排序效果,来指导Prompt的生成和改进。这种方法旨在找到能够最大化重排序性能的Prompt,同时减少人工干预。

技术框架:APEER的整体框架包含以下几个主要模块:1) Prompt生成器:负责生成新的Prompt候选;2) LLM重排序器:使用生成的Prompt对文档进行重排序;3) 评估器:评估重排序结果的质量,并生成反馈信号;4) Prompt优化器:根据反馈信号,优化Prompt生成器,使其能够生成更好的Prompt。整个流程是一个迭代的过程,通过不断地反馈和优化,最终得到一个高性能的Prompt。

关键创新:APEER的关键创新在于其针对IR重排序任务设计的自动Prompt工程方法。与现有的主要面向语言建模和分类任务的自动Prompt工程方法不同,APEER考虑了查询和文档对的复杂交互,并采用了偏好优化策略,更有效地提升了重排序性能。此外,APEER具有良好的跨任务和模型迁移性,这意味着它可以在不同的数据集和LLM上取得良好的效果。

关键设计:APEER的关键设计包括:1) Prompt生成器的设计,可以使用基于规则的方法或基于学习的方法;2) 评估器的设计,可以使用NDCG、MAP等IR评价指标;3) Prompt优化器的设计,可以使用强化学习算法或进化算法。论文中具体使用了何种参数设置、损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,APEER在四个LLM和十个数据集上均取得了显著的性能提升,超越了现有的SOTA人工Prompt。具体提升幅度未知,但论文强调了APEER在不同任务和LLM上的良好迁移性,表明其具有很强的泛化能力。

🎯 应用场景

APEER具有广泛的应用前景,可应用于搜索引擎、推荐系统、问答系统等各种信息检索场景。通过自动优化Prompt,可以显著提升LLM的重排序性能,提高用户获取信息的效率和准确性。该研究成果有助于降低人工成本,推动LLM在IR领域的更广泛应用。

📄 摘要(原文)

Large Language Models (LLMs) have significantly enhanced Information Retrieval (IR) across various modules, such as reranking. Despite impressive performance, current zero-shot relevance ranking with LLMs heavily relies on human prompt engineering. Existing automatic prompt engineering algorithms primarily focus on language modeling and classification tasks, leaving the domain of IR, particularly reranking, underexplored. Directly applying current prompt engineering algorithms to relevance ranking is challenging due to the integration of query and long passage pairs in the input, where the ranking complexity surpasses classification tasks. To reduce human effort and unlock the potential of prompt optimization in reranking, we introduce a novel automatic prompt engineering algorithm named APEER. APEER iteratively generates refined prompts through feedback and preference optimization. Extensive experiments with four LLMs and ten datasets demonstrate the substantial performance improvement of APEER over existing state-of-the-art (SoTA) manual prompts. Furthermore, we find that the prompts generated by APEER exhibit better transferability across diverse tasks and LLMs.