Generative AI Misuse: A Taxonomy of Tactics and Insights from Real-World Data

作者: Nahema Marchal, Rachel Xu, Rasmi Elasmar, Iason Gabriel, Beth Goldberg, William Isaac

分类: cs.AI

发布日期: 2024-06-19 (更新: 2024-06-21)

💡 一句话要点

构建生成式AI滥用策略分类体系,揭示真实世界滥用案例

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成式AI 滥用策略 分类体系 安全风险 多模态 定性分析 真实世界数据

📋 核心要点

- 现有研究缺乏对生成式AI模型在实践中被滥用的具体方式和策略的深入理解。

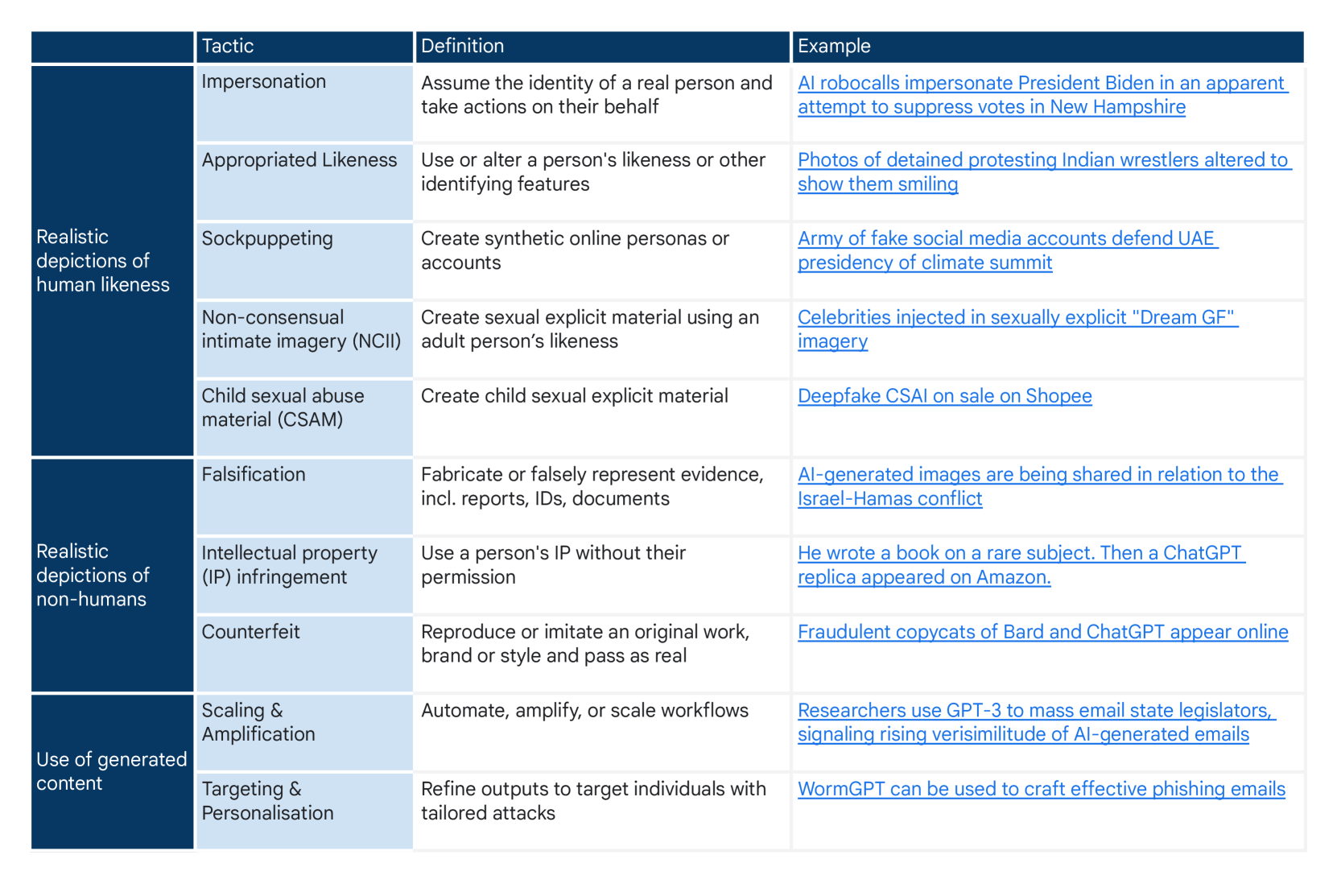

- 本文通过分析真实世界的滥用案例,构建了一个生成式AI滥用策略的分类体系。

- 该研究揭示了滥用的动机、策略以及攻击者如何跨模态利用和滥用系统能力。

📝 摘要(中文)

生成式多模态人工智能(GenAI)在各行业具有变革潜力,但其滥用也带来重大风险。现有研究揭示了高级AI系统被恶意利用的可能性。然而,我们仍然缺乏对GenAI模型在实践中如何被具体利用或滥用的具体理解,包括用于造成伤害的策略。本文基于现有学术文献和对2023年1月至2024年3月期间报告的约200起观察到的滥用事件的定性分析,提出了GenAI滥用策略的分类体系。通过分析,我们阐明了这一时期滥用的关键和新颖模式,包括潜在动机、策略,以及攻击者如何在实际环境中利用和滥用跨模态(例如,图像、文本、音频、视频)的系统能力。

🔬 方法详解

问题定义:论文旨在解决生成式AI模型被滥用的问题,现有方法缺乏对实际滥用案例的系统性分析和分类,难以有效应对潜在风险。缺乏对攻击者动机、策略和跨模态利用方式的理解,使得防御措施难以制定。

核心思路:论文的核心思路是通过对真实世界中已发生的生成式AI滥用案例进行定性分析,从中提取出共性的滥用策略,并构建一个全面的分类体系。通过理解这些策略,可以更好地预测和防范未来的滥用行为。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 数据收集:收集2023年1月至2024年3月期间报告的约200起生成式AI滥用事件。2) 文献综述:回顾现有的学术文献,了解已知的滥用类型和潜在风险。3) 定性分析:对收集到的滥用案例进行深入的定性分析,识别出关键的滥用策略。4) 分类体系构建:基于分析结果,构建一个全面的滥用策略分类体系。

关键创新:该研究的关键创新在于基于真实世界数据构建了生成式AI滥用策略的分类体系,弥补了现有研究中缺乏实践数据的不足。该分类体系能够帮助研究人员和安全专家更好地理解和应对生成式AI滥用风险。

关键设计:该研究的关键设计在于其定性分析方法,通过对每个滥用案例进行细致的分析,识别出攻击者的动机、使用的策略以及利用的系统漏洞。分类体系的设计考虑了跨模态的滥用情况,例如图像、文本、音频和视频的组合滥用。

🖼️ 关键图片

📊 实验亮点

该研究通过分析约200起真实世界的滥用案例,构建了一个全面的生成式AI滥用策略分类体系。该体系揭示了滥用的动机、策略以及攻击者如何跨模态利用和滥用系统能力。研究结果为开发更有效的防御机制提供了重要参考。

🎯 应用场景

该研究成果可应用于生成式AI模型的安全评估、风险管理和防御策略制定。通过理解滥用策略,可以开发更有效的检测和防御机制,降低生成式AI被恶意利用的风险。该研究对提升AI安全性和促进AI技术的负责任发展具有重要意义。

📄 摘要(原文)

Generative, multimodal artificial intelligence (GenAI) offers transformative potential across industries, but its misuse poses significant risks. Prior research has shed light on the potential of advanced AI systems to be exploited for malicious purposes. However, we still lack a concrete understanding of how GenAI models are specifically exploited or abused in practice, including the tactics employed to inflict harm. In this paper, we present a taxonomy of GenAI misuse tactics, informed by existing academic literature and a qualitative analysis of approximately 200 observed incidents of misuse reported between January 2023 and March 2024. Through this analysis, we illuminate key and novel patterns in misuse during this time period, including potential motivations, strategies, and how attackers leverage and abuse system capabilities across modalities (e.g. image, text, audio, video) in the wild.