An Empirical Study on the Fairness of Foundation Models for Multi-Organ Image Segmentation

作者: Qin Li, Yizhe Zhang, Yan Li, Jun Lyu, Meng Liu, Longyu Sun, Mengting Sun, Qirong Li, Wenyue Mao, Xinran Wu, Yajing Zhang, Yinghua Chu, Shuo Wang, Chengyan Wang

分类: eess.IV, cs.AI, cs.CV

发布日期: 2024-06-18

备注: Accepted to MICCAI-2024

💡 一句话要点

针对多器官图像分割,揭示并分析了分割基础模型在公平性方面的潜在问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学图像分割 公平性 基础模型 SAM 人口统计学偏见

📋 核心要点

- 现有的分割基础模型,如SAM,在医学图像分割中应用广泛,但缺乏对公平性的深入研究,可能存在与特定任务深度学习模型类似的偏见。

- 本文构建了一个包含多器官3D医学图像的基准数据集,并记录了受试者的人口统计学信息,用于评估分割模型在不同群体间的性能差异。

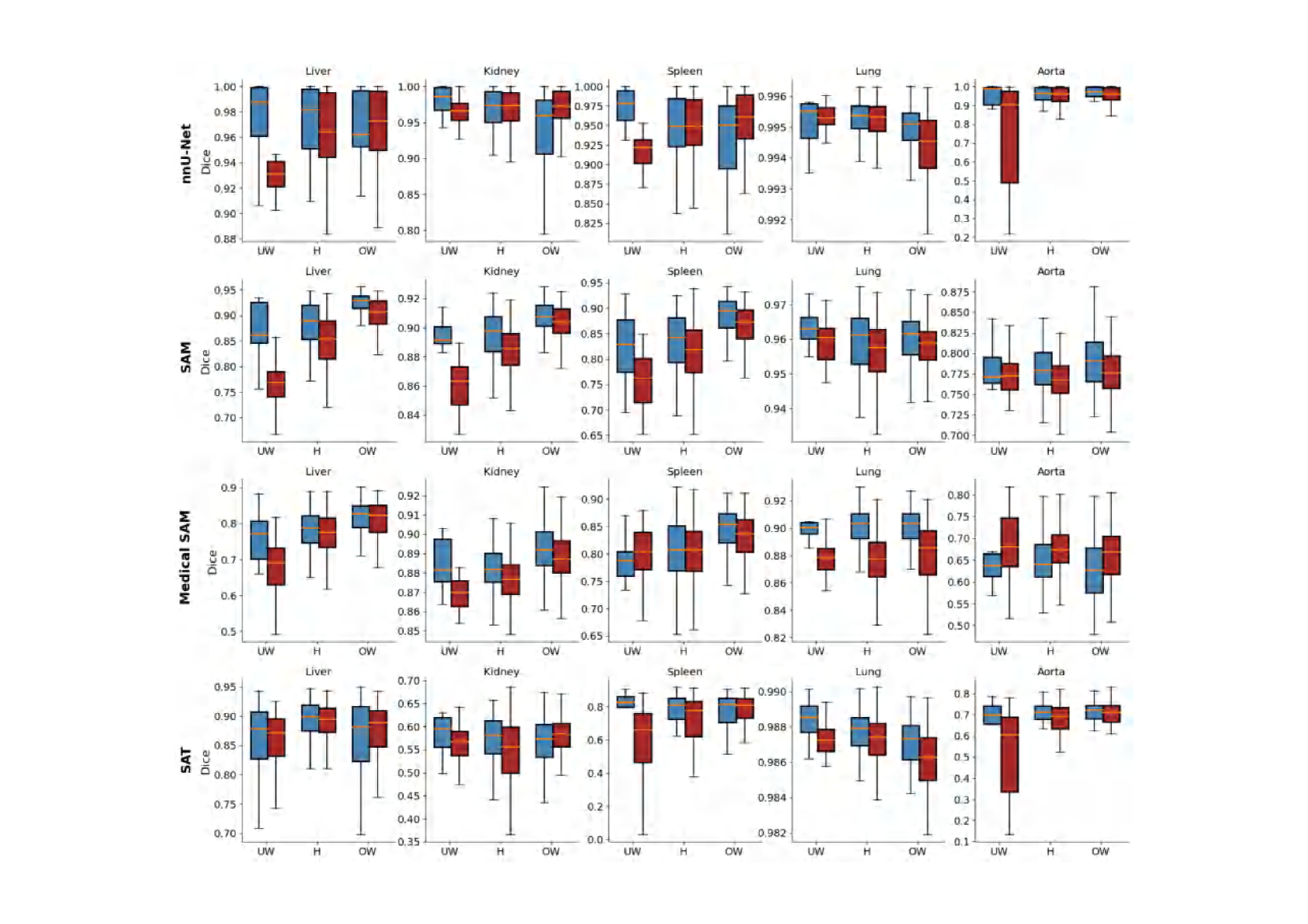

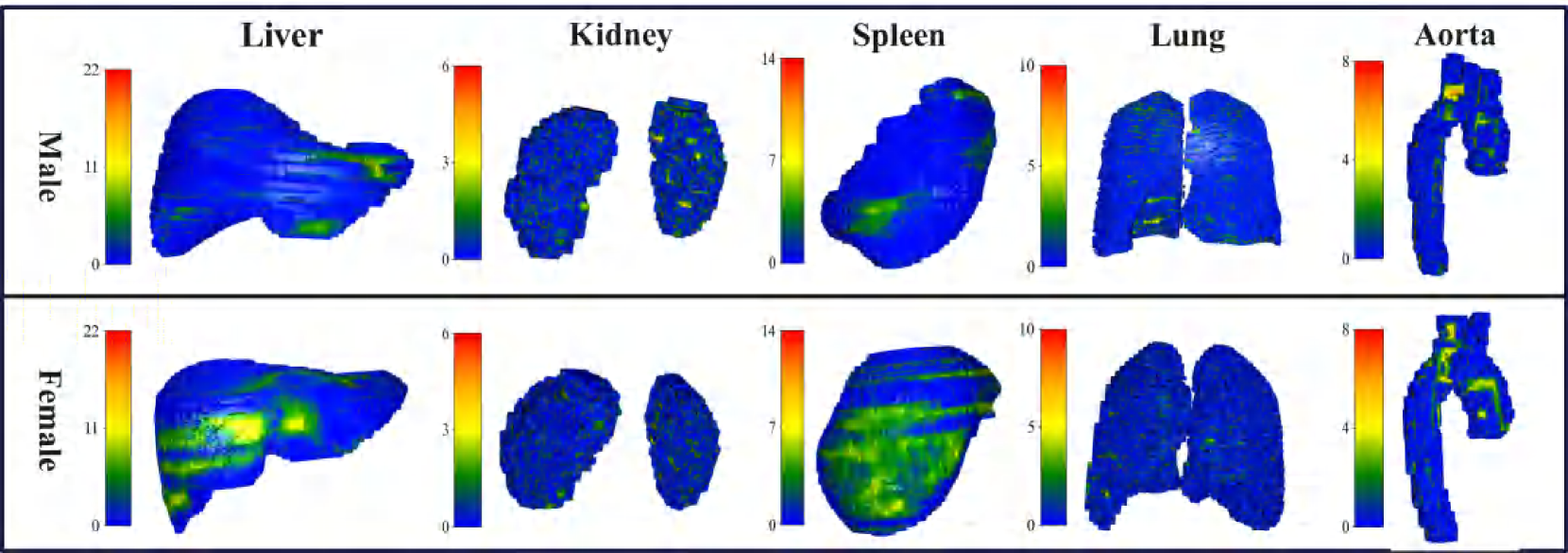

- 实验结果表明,现有的分割基础模型在不同人口统计学群体中存在显著的性能差异,包括整体分割指标和分割误差的空间分布。

📝 摘要(中文)

本文探讨了大型分割基础模型中存在的公平性问题。作者构建了一个包含1056名健康受试者的3D MRI和CT扫描图像的基准数据集,这些图像涵盖肝脏、肾脏、脾脏、肺和主动脉等器官,并由专家进行了分割。数据集中记录了受试者的性别、年龄和身体质量指数(BMI)等人口统计学信息,以便进行细致的公平性分析。研究测试了当前先进的医学图像分割基础模型,包括原始SAM、Medical SAM和SAT模型,评估了它们在不同人口统计学群体中的分割效果,并识别了其中的差异。综合分析表明,这些基础模型存在显著的公平性问题,不仅在Dice相似系数等整体分割指标上存在差异,而且在分割误差的空间分布上也存在显著差异,为确保医学图像分割的公平性提供了经验证据。

🔬 方法详解

问题定义:论文旨在解决医学图像分割基础模型中存在的公平性问题。现有方法主要关注模型的整体准确性和效率,而忽略了模型在不同人口统计学群体(如不同性别、年龄、BMI)中的性能差异,这可能导致对某些群体的分割效果较差,从而加剧医疗不平等。

核心思路:论文的核心思路是通过构建一个包含详细人口统计学信息的医学图像分割数据集,并在此数据集上评估现有分割基础模型在不同群体中的性能差异,从而揭示模型中存在的公平性问题。通过分析分割结果的统计指标和空间分布,可以更全面地了解模型在不同群体中的表现。

技术框架:论文的技术框架主要包括以下几个步骤:1) 构建包含多器官(肝脏、肾脏、脾脏、肺和主动脉)3D MRI和CT扫描图像的基准数据集,并由专家进行分割;2) 记录受试者的性别、年龄和BMI等人口统计学信息;3) 选择当前先进的医学图像分割基础模型(如SAM、Medical SAM和SAT)进行测试;4) 评估模型在不同人口统计学群体中的分割效果,并计算Dice相似系数等指标;5) 分析分割误差的空间分布,以识别模型在不同区域的性能差异。

关键创新:论文的关键创新在于:1) 首次针对医学图像分割基础模型的公平性问题进行了系统性的研究;2) 构建了一个包含详细人口统计学信息的医学图像分割基准数据集,为公平性评估提供了数据基础;3) 不仅评估了整体分割指标,还分析了分割误差的空间分布,从而更全面地了解模型在不同群体中的表现。

关键设计:论文的关键设计包括:1) 数据集的构建:选择了常见的腹部和胸部器官,并确保数据集的多样性,以覆盖不同的人口统计学群体;2) 模型选择:选择了当前先进的分割基础模型,以评估其在公平性方面的表现;3) 评估指标:使用了Dice相似系数等常用的分割指标,并结合分割误差的空间分布分析,以全面评估模型的性能;4) 统计分析:使用了统计方法来分析不同群体间的性能差异,并考虑了各种混淆因素的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的分割基础模型在不同人口统计学群体中存在显著的性能差异。例如,在某些器官的分割中,模型在男性和女性之间的Dice相似系数差异可达5%以上。此外,分割误差的空间分布也存在显著差异,表明模型在不同区域的分割性能存在偏见。这些结果突显了在医学图像分割中关注公平性问题的重要性。

🎯 应用场景

该研究成果可应用于医学图像分析领域,帮助开发更公平、更可靠的分割模型。通过识别和纠正模型中的偏见,可以提高医疗诊断的准确性和公正性,减少医疗不平等现象。未来的研究可以基于此数据集,开发更具公平性的分割算法,并将其应用于临床实践。

📄 摘要(原文)

The segmentation foundation model, e.g., Segment Anything Model (SAM), has attracted increasing interest in the medical image community. Early pioneering studies primarily concentrated on assessing and improving SAM's performance from the perspectives of overall accuracy and efficiency, yet little attention was given to the fairness considerations. This oversight raises questions about the potential for performance biases that could mirror those found in task-specific deep learning models like nnU-Net. In this paper, we explored the fairness dilemma concerning large segmentation foundation models. We prospectively curate a benchmark dataset of 3D MRI and CT scans of the organs including liver, kidney, spleen, lung and aorta from a total of 1056 healthy subjects with expert segmentations. Crucially, we document demographic details such as gender, age, and body mass index (BMI) for each subject to facilitate a nuanced fairness analysis. We test state-of-the-art foundation models for medical image segmentation, including the original SAM, medical SAM and SAT models, to evaluate segmentation efficacy across different demographic groups and identify disparities. Our comprehensive analysis, which accounts for various confounding factors, reveals significant fairness concerns within these foundational models. Moreover, our findings highlight not only disparities in overall segmentation metrics, such as the Dice Similarity Coefficient but also significant variations in the spatial distribution of segmentation errors, offering empirical evidence of the nuanced challenges in ensuring fairness in medical image segmentation.