Implementing engrams from a machine learning perspective: XOR as a basic motif

作者: Jesus Marco de Lucas, Maria Peña Fernandez, Lara Lloret Iglesias

分类: q-bio.NC, cs.AI, cs.NE

发布日期: 2024-06-14

备注: 9 pages, short comment

💡 一句话要点

提出基于XOR逻辑的神经元网络模型,模拟大脑中engram的形成机制,用于序列学习。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Engram 神经元网络 XOR逻辑 机器学习 序列学习

📋 核心要点

- 现有方法缺乏对大脑中engram形成机制的有效建模,难以解释复杂信息如何在神经元层面压缩和存储。

- 论文提出基于XOR逻辑的神经元网络模型,模拟大脑中engram的形成,通过稳态原则和损失函数实现反馈控制。

- 通过计算类比,展示了该方法在学习二元序列(如简单旋律)方面的可行性,为理解生物学习机制提供了一种新思路。

📝 摘要(中文)

本文探讨了如何从机器学习的角度实现大脑中的engram,即压缩形式的复杂多模态信息表示。文章重点关注生物学实现的基本问题:作为损失函数发挥作用的机制是什么?它如何与神经元网络连接,从而为构建简单的训练配置提供所需的反馈?文章提出了基于XOR开关的基本单元,该单元由少量的兴奋性和抑制性神经元构成,并受稳态原则指导,实现了一种损失函数,可以为其他神经元结构提供反馈,从而建立控制系统。文章分析了秀丽隐杆线虫连接体中XOR单元的存在,并指出了其与侧向抑制单元的关系。进一步探索了如何构建具有学习能力的基本生物神经元结构,并将其应用于学习二元序列(如简单旋律)。总而言之,文章通过教学示例,探讨了生物和计算学习机制之间的相似之处,识别了基本单元和训练过程,以及如何使用包含兴奋性和抑制性神经元的简单循环网络构建编码旋律的engram。

🔬 方法详解

问题定义:论文旨在探索大脑中engram(记忆痕迹)的形成机制,特别是如何利用神经元网络以压缩的形式表示和存储复杂的多模态信息。现有方法缺乏对生物神经元网络如何实现类似机器学习中自编码器功能的理解,尤其是在损失函数和反馈机制方面存在空白。

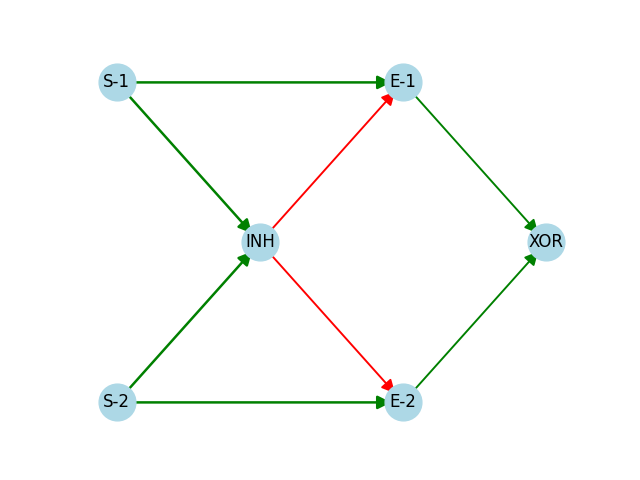

核心思路:论文的核心思路是借鉴机器学习中的自编码器概念,提出基于XOR逻辑的神经元单元作为基本构建块,模拟生物神经元网络中的信息压缩和重建过程。XOR单元能够实现非线性运算,并通过兴奋性和抑制性神经元的相互作用,实现稳态调节和损失函数的计算,从而为网络的学习提供反馈信号。

技术框架:该方法构建了一个简单的循环神经网络,其中XOR单元作为基本模块。该网络包含兴奋性神经元和抑制性神经元,通过连接权重来学习二元序列。网络的训练过程受到稳态原则的指导,即通过调节神经元的活动水平,使其保持在一个稳定的范围内。损失函数基于XOR单元的输出,用于评估网络的重建误差,并指导权重的更新。

关键创新:论文的关键创新在于将XOR逻辑与生物神经元网络联系起来,提出了一种基于XOR单元的神经元模型,能够模拟大脑中的信息压缩和重建过程。这种模型不同于传统的神经网络模型,它更加关注生物神经元网络的特性,如兴奋性和抑制性神经元的相互作用和稳态调节。

关键设计:XOR单元由少量的兴奋性和抑制性神经元组成,其连接权重决定了单元的逻辑功能。稳态原则通过调节神经元的活动水平来实现,例如,如果某个神经元的活动水平过高,则会通过抑制性连接来降低其活动水平。损失函数基于XOR单元的输出,例如,可以使用均方误差来衡量网络的重建误差。网络的训练过程使用梯度下降法来更新连接权重。

🖼️ 关键图片

📊 实验亮点

论文通过计算实验验证了基于XOR单元的神经元网络模型在学习二元序列方面的可行性。实验结果表明,该模型能够成功学习简单的旋律,并能够对学习到的旋律进行重建。虽然没有提供具体的性能数据和对比基线,但该实验结果为进一步研究基于XOR单元的神经元网络模型提供了初步的证据。

🎯 应用场景

该研究成果可应用于神经科学领域,帮助研究人员更好地理解大脑中的学习和记忆机制。此外,该模型还可以应用于人工智能领域,例如,可以用于构建更加高效和鲁棒的神经网络模型,用于处理序列数据和模式识别任务。该研究为类脑计算提供了一种新的思路。

📄 摘要(原文)

We have previously presented the idea of how complex multimodal information could be represented in our brains in a compressed form, following mechanisms similar to those employed in machine learning tools, like autoencoders. In this short comment note we reflect, mainly with a didactical purpose, upon the basic question for a biological implementation: what could be the mechanism working as a loss function, and how it could be connected to a neuronal network providing the required feedback to build a simple training configuration. We present our initial ideas based on a basic motif that implements an XOR switch, using few excitatory and inhibitory neurons. Such motif is guided by a principle of homeostasis, and it implements a loss function that could provide feedback to other neuronal structures, establishing a control system. We analyse the presence of this XOR motif in the connectome of C.Elegans, and indicate the relationship with the well-known lateral inhibition motif. We then explore how to build a basic biological neuronal structure with learning capacity integrating this XOR motif. Guided by the computational analogy, we show an initial example that indicates the feasibility of this approach, applied to learning binary sequences, like it is the case for simple melodies. In summary, we provide didactical examples exploring the parallelism between biological and computational learning mechanisms, identifying basic motifs and training procedures, and how an engram encoding a melody could be built using a simple recurrent network involving both excitatory and inhibitory neurons.