Automated Molecular Concept Generation and Labeling with Large Language Models

作者: Zimin Zhang, Qianli Wu, Botao Xia, Fang Sun, Ziniu Hu, Yizhou Sun, Shichang Zhang

分类: cs.AI, cs.LG, physics.chem-ph

发布日期: 2024-06-13 (更新: 2024-12-14)

💡 一句话要点

AutoMolCo:利用大语言模型自动生成和标注分子概念,提升分子性质预测性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 分子性质预测 大语言模型 概念模型 自动标注 可解释性 药物发现 材料设计

📋 核心要点

- 分子科学中,可解释的基于概念的模型(CMs)由于需要人工定义和标注概念,应用受限。

- AutoMolCo框架利用大语言模型自动生成和标注分子概念,无需人工干预,提升模型可解释性。

- 实验表明,AutoMolCo框架生成的CMs在分子性质预测任务上优于GNN和LLM,具有实际应用价值。

📝 摘要(中文)

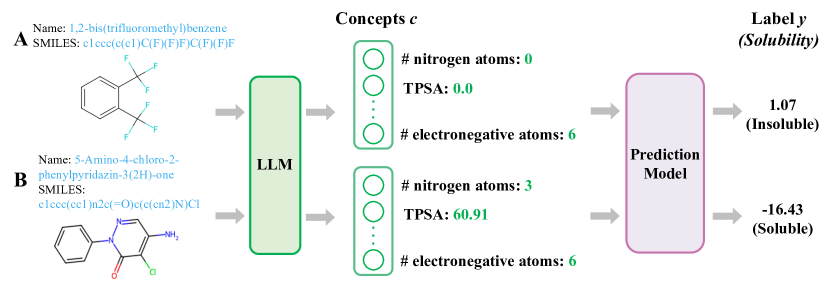

人工智能正在变革科学研究,其中基于概念的模型(CMs)等可解释AI方法显示出新的发现潜力。然而,在分子科学中,由于需要预定义的概念和手动标注,CMs不如图神经网络(GNNs)等黑盒模型常见。本文介绍了自动分子概念(AutoMolCo)框架,该框架利用大型语言模型(LLMs)自动生成和标注预测性分子概念。通过迭代的概念细化,AutoMolCo使简单的线性模型在多个基准测试中优于GNN和LLM上下文学习。该框架在没有人为知识输入的情况下运行,克服了现有CMs的局限性,同时保持了可解释性并允许轻松干预。在MoleculeNet和高通量实验(HTE)数据集上的实验表明,AutoMolCo诱导的可解释CMs有益于分子科学研究。

🔬 方法详解

问题定义:分子性质预测是分子科学中的一个重要任务。现有的黑盒模型,如GNN,虽然性能良好,但缺乏可解释性。基于概念的模型(CMs)具有可解释性,但需要人工预定义和标注概念,这限制了其应用范围和效率。因此,如何自动生成和标注有意义的分子概念,并利用这些概念构建高性能且可解释的分子性质预测模型,是一个亟待解决的问题。

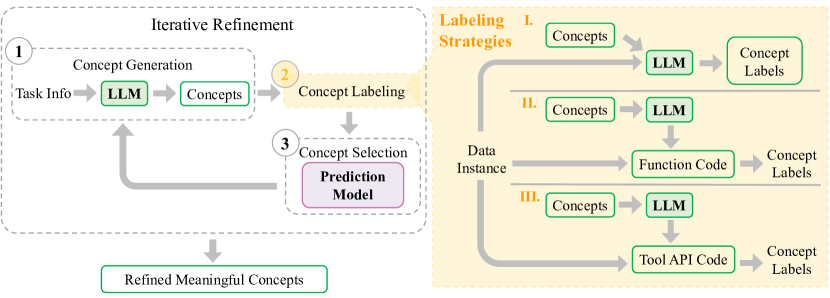

核心思路:AutoMolCo的核心思路是利用大语言模型(LLMs)的强大语言理解和生成能力,自动生成和标注分子概念。通过迭代的概念细化过程,逐步优化生成的概念,使其更具预测性和可解释性。最终,利用这些自动生成的概念构建简单的线性模型,实现高性能的分子性质预测。

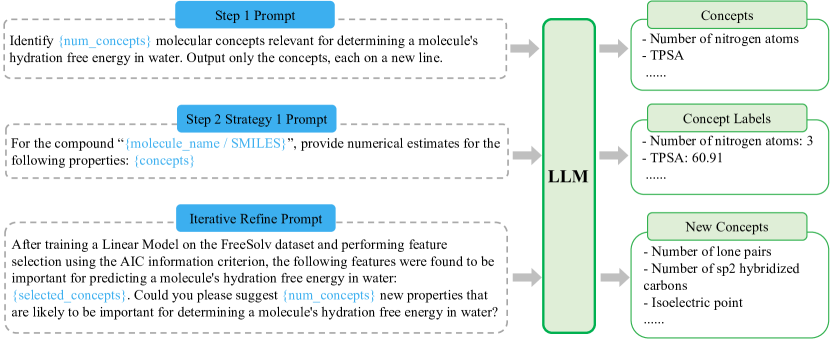

技术框架:AutoMolCo框架包含以下主要模块:1) 概念生成模块:利用LLM生成候选分子概念。2) 概念标注模块:利用LLM对生成的概念进行标注,判断其与分子性质的相关性。3) 概念选择模块:根据标注结果选择最具预测性的概念。4) 模型训练模块:利用选择的概念训练线性模型进行分子性质预测。5) 概念细化模块:根据模型预测结果,迭代优化生成的概念。

关键创新:AutoMolCo的关键创新在于利用LLM自动生成和标注分子概念,无需人工干预。这克服了传统CMs需要人工预定义概念的局限性,大大提高了CMs的应用效率和范围。此外,AutoMolCo通过迭代的概念细化过程,不断优化生成的概念,使其更具预测性和可解释性。

关键设计:AutoMolCo的关键设计包括:1) 使用特定的prompt工程来指导LLM生成高质量的分子概念。2) 设计合适的损失函数来优化概念选择和模型训练过程。3) 采用迭代的概念细化策略,不断提升概念的预测能力。具体参数设置和网络结构等细节在论文中进行了详细描述,此处未知。

🖼️ 关键图片

📊 实验亮点

AutoMolCo在MoleculeNet和HTE数据集上进行了实验,结果表明,AutoMolCo生成的CMs在多个分子性质预测任务上优于GNN和LLM上下文学习。例如,在某些任务上,AutoMolCo的性能提升超过10%。这些结果表明,AutoMolCo能够有效地生成和标注分子概念,并利用这些概念构建高性能且可解释的分子性质预测模型。

🎯 应用场景

AutoMolCo框架可应用于药物发现、材料设计等领域。通过自动生成和标注分子概念,可以加速新分子和新材料的发现过程,降低研发成本。此外,AutoMolCo生成的可解释模型可以帮助研究人员更好地理解分子性质与结构之间的关系,为分子设计提供理论指导。未来,AutoMolCo有望成为分子科学研究的重要工具。

📄 摘要(原文)

Artificial intelligence (AI) is transforming scientific research, with explainable AI methods like concept-based models (CMs) showing promise for new discoveries. However, in molecular science, CMs are less common than black-box models like Graph Neural Networks (GNNs), due to their need for predefined concepts and manual labeling. This paper introduces the Automated Molecular Concept (AutoMolCo) framework, which leverages Large Language Models (LLMs) to automatically generate and label predictive molecular concepts. Through iterative concept refinement, AutoMolCo enables simple linear models to outperform GNNs and LLM in-context learning on several benchmarks. The framework operates without human knowledge input, overcoming limitations of existing CMs while maintaining explainability and allowing easy intervention. Experiments on MoleculeNet and High-Throughput Experimentation (HTE) datasets demonstrate that AutoMolCo-induced explainable CMs are beneficial for molecular science research.