Emotion Manipulation Through Music -- A Deep Learning Interactive Visual Approach

作者: Adel N. Abdalla, Jared Osborne, Razvan Andonie

分类: cs.SD, cs.AI, cs.CY, cs.LG, eess.AS

发布日期: 2024-06-12

💡 一句话要点

提出一种基于深度学习的交互式音乐情感操控方法,实现音乐情感的语义修改。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 音乐情感操控 深度学习 语义修改 交互式系统 Russell环形模型

📋 核心要点

- 现有音乐情感操控方法缺乏有效工具,难以在保持旋律的同时精确修改情感。

- 该论文提出一种交互式流程,利用深度学习模型评估情感修改的准确性,并使用Russell环形模型可视化。

- 实验结果表明,该模型在4Q Emotion数据集上表现与当前最佳技术相当,验证了方法的可行性。

📝 摘要(中文)

本文提出了一种新颖的方法,利用人工智能工具来操控歌曲的情感内容。目标是在尽可能保持原始旋律完整的同时,实现期望的情感转变。为此,我们创建了一个交互式流程,能够将输入的歌曲转换为截然相反的情感,并通过Russell环形模型可视化结果。该方法是音乐语义操控的概念验证,旨在修改现有音乐的情感内容。我们设计了一个深度学习模型,能够评估我们对音调、音色库乐器以及其他音乐特征的修改的准确性。该模型的准确性与4Q Emotion数据集上的当前最先进技术相当。通过进一步改进,这项研究可能有助于按需定制音乐生成、现有作品的自动混音以及为情感进展而调整的音乐播放列表。

🔬 方法详解

问题定义:论文旨在解决音乐情感的语义操控问题,即如何在保持音乐基本旋律结构不变的前提下,改变其情感表达。现有方法可能无法精确控制情感变化,或者对原始旋律产生较大影响,缺乏交互性和可控性。

核心思路:核心思路是利用深度学习模型学习音乐特征与情感之间的映射关系,通过修改关键音乐特征(如音调、乐器音色等)来改变音乐的情感表达。同时,引入交互式流程,允许用户干预和调整情感修改的结果。

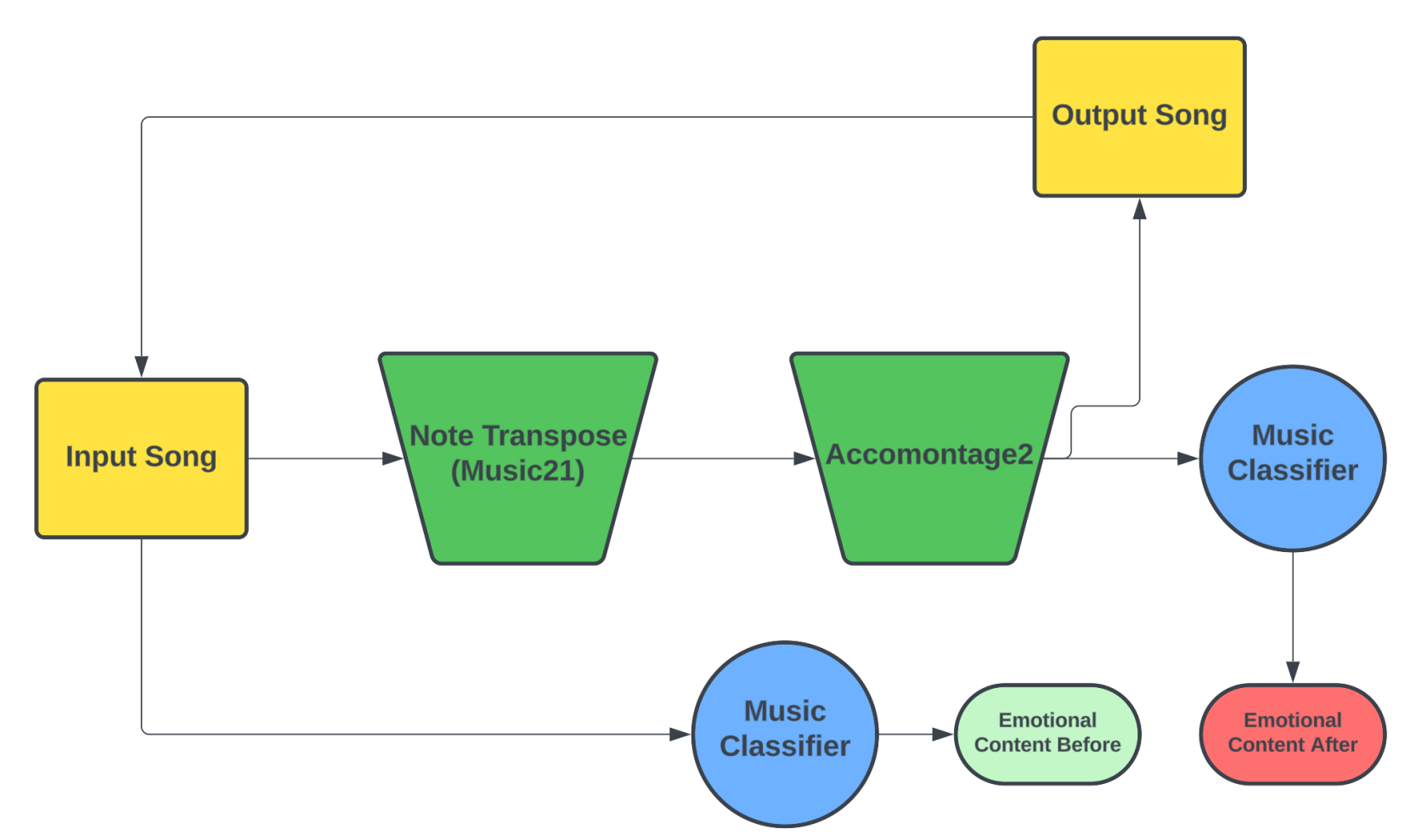

技术框架:整体框架包含以下几个主要模块:1) 音乐情感分析模块:使用深度学习模型分析输入音乐的情感;2) 情感操控模块:根据用户期望的情感目标,修改音乐的关键特征;3) 情感评估模块:使用深度学习模型评估修改后音乐的情感准确性;4) 可视化模块:使用Russell环形模型可视化情感变化。

关键创新:关键创新在于将深度学习模型与交互式流程相结合,实现了对音乐情感的语义操控。通过深度学习模型,可以更精确地控制情感变化,并通过交互式流程,允许用户根据自身需求进行调整。

关键设计:论文中使用的深度学习模型结构未知,但强调了对音调、音色库乐器等关键音乐特征的修改。损失函数的设计可能涉及到情感分类的交叉熵损失,以及对原始旋律保持的约束。具体的网络结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

该研究的实验亮点在于,所提出的深度学习模型在4Q Emotion数据集上取得了与当前最先进技术相当的准确性。这表明该模型能够有效地评估音乐情感,并为后续的情感操控提供了可靠的基础。具体的性能数据和对比基线未知。

🎯 应用场景

该研究具有广泛的应用前景,包括:按需定制音乐生成,根据用户的情感需求自动生成音乐;现有作品的自动混音,将现有音乐作品的情感进行调整;以及音乐播放列表的自动生成,根据用户的情感状态和期望的情感进展,自动生成个性化的音乐播放列表。

📄 摘要(原文)

Music evokes emotion in many people. We introduce a novel way to manipulate the emotional content of a song using AI tools. Our goal is to achieve the desired emotion while leaving the original melody as intact as possible. For this, we create an interactive pipeline capable of shifting an input song into a diametrically opposed emotion and visualize this result through Russel's Circumplex model. Our approach is a proof-of-concept for Semantic Manipulation of Music, a novel field aimed at modifying the emotional content of existing music. We design a deep learning model able to assess the accuracy of our modifications to key, SoundFont instrumentation, and other musical features. The accuracy of our model is in-line with the current state of the art techniques on the 4Q Emotion dataset. With further refinement, this research may contribute to on-demand custom music generation, the automated remixing of existing work, and music playlists tuned for emotional progression.