Large Language Models for Constrained-Based Causal Discovery

作者: Kai-Hendrik Cohrs, Gherardo Varando, Emiliano Diaz, Vasileios Sitokonstantinou, Gustau Camps-Valls

分类: cs.AI, cs.CL

发布日期: 2024-06-11

💡 一句话要点

利用大语言模型进行约束式因果发现,提升因果图构建效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果发现 大语言模型 条件独立性 PC算法 知识推理

📋 核心要点

- 现有因果图构建方法,如PC算法,面临数据需求高和因果充分性假设的挑战,专家驱动方法则耗时且依赖领域知识。

- 该论文提出利用大语言模型(LLM)回答条件独立性查询,并将其结果用于PC算法,以替代领域专家进行因果图生成。

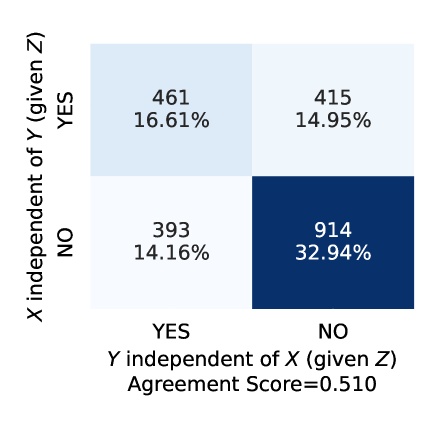

- 实验表明,基于LLM的条件独立性预言机性能存在变异性,通过统计投票方案可提高性能,并发现LLM具有因果推理能力。

📝 摘要(中文)

因果关系对于理解经济、大脑和气候等复杂系统至关重要。构建因果图通常依赖于数据驱动或专家驱动的方法,但两者都面临挑战。数据驱动方法(如PC算法)存在数据需求和因果充分性假设问题,而专家驱动方法则需要大量时间和领域知识。本文探索了使用大语言模型(LLM)作为领域专家的替代方案来生成因果图的能力。我们将条件独立性查询构建为LLM的提示,并使用LLM的答案来运行PC算法。基于已知因果图的系统上的实验表明,基于LLM的条件独立性预言机的性能存在高度的变异性。我们通过一种受统计启发的投票方案来提高性能,该方案允许对假阳性和假阴性率进行一定程度的控制。通过检查思维链论证,我们发现了因果推理来证明其对概率查询的回答。我们展示了基于知识的CIT最终可能成为数据驱动因果发现的补充工具的证据。

🔬 方法详解

问题定义:传统因果发现方法,如PC算法,依赖大量数据并假设因果充分性,在数据稀疏或假设不成立时表现不佳。专家驱动方法虽然准确,但耗时且需要深厚的领域知识。因此,如何高效、低成本地构建因果图是一个关键问题。

核心思路:利用大语言模型(LLM)的知识和推理能力,将其作为领域专家的替代品,回答条件独立性查询。通过将条件独立性查询转化为LLM的prompt,并利用LLM的回答来指导PC算法,从而实现因果图的自动构建。这种方法旨在降低对数据量的需求,并减少对领域专家的依赖。

技术框架:整体流程包括以下几个阶段:1) 将因果图中变量的条件独立性查询构建成自然语言prompt;2) 将prompt输入到LLM中,获取LLM对条件独立性查询的回答;3) 将LLM的回答作为条件独立性测试的预言机,输入到PC算法中;4) PC算法根据LLM的回答构建因果图。此外,论文还提出了一种统计投票方案,通过多次查询LLM并进行投票,来提高条件独立性判断的准确性。

关键创新:该论文的关键创新在于将大语言模型引入到因果发现领域,并将其作为条件独立性测试的预言机。与传统方法相比,该方法无需大量数据,并减少了对领域专家的依赖。此外,论文提出的统计投票方案能够有效提高LLM判断条件独立性的准确性。

关键设计:论文的关键设计包括:1) prompt的设计,需要清晰、明确地表达条件独立性查询;2) 统计投票方案,通过多次查询LLM并进行投票,来降低LLM的随机性带来的影响;3) 对LLM回答的后处理,例如将LLM的自然语言回答转化为PC算法可以理解的布尔值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,直接使用LLM进行条件独立性判断的准确率存在较大波动。通过引入统计投票方案,可以显著提高LLM判断条件独立性的准确性,并有效控制假阳性和假阴性率。此外,对LLM的思维链分析表明,LLM具备一定的因果推理能力,能够为条件独立性判断提供合理的解释。

🎯 应用场景

该研究成果可应用于多个领域,例如经济学、医学、气候科学等,用于理解复杂系统中的因果关系。通过利用LLM的知识和推理能力,可以更高效、低成本地构建因果图,从而为决策提供更可靠的依据。未来,该方法有望成为数据驱动因果发现的重要补充工具。

📄 摘要(原文)

Causality is essential for understanding complex systems, such as the economy, the brain, and the climate. Constructing causal graphs often relies on either data-driven or expert-driven approaches, both fraught with challenges. The former methods, like the celebrated PC algorithm, face issues with data requirements and assumptions of causal sufficiency, while the latter demand substantial time and domain knowledge. This work explores the capabilities of Large Language Models (LLMs) as an alternative to domain experts for causal graph generation. We frame conditional independence queries as prompts to LLMs and employ the PC algorithm with the answers. The performance of the LLM-based conditional independence oracle on systems with known causal graphs shows a high degree of variability. We improve the performance through a proposed statistical-inspired voting schema that allows some control over false-positive and false-negative rates. Inspecting the chain-of-thought argumentation, we find causal reasoning to justify its answer to a probabilistic query. We show evidence that knowledge-based CIT could eventually become a complementary tool for data-driven causal discovery.