Large Language Models are Zero-Shot Next Location Predictors

作者: Ciro Beneduce, Bruno Lepri, Massimiliano Luca

分类: cs.CY, cs.AI, cs.CL

发布日期: 2024-05-31 (更新: 2024-08-23)

💡 一句话要点

利用大型语言模型实现零样本的下一位置预测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 下一位置预测 大型语言模型 零样本学习 地理知识 可解释性

📋 核心要点

- 现有的下一位置预测方法依赖大量个体数据,在冷启动等数据稀缺场景下表现不佳。

- 该论文探索利用大型语言模型(LLM)的地理知识和推理能力,实现零样本下一位置预测。

- 实验表明,LLM在三个真实数据集上取得了显著的准确率提升,并能提供决策解释。

📝 摘要(中文)

预测个体未来将访问的位置对于解决疾病传播和减少污染等社会问题至关重要。然而,下一位置预测器需要大量的个体级别信息,这些信息在某些情况下可能稀缺或不可用(例如,冷启动)。大型语言模型(LLM)已显示出良好的泛化和推理能力,并且富含地理知识,这使我们相信这些模型可以充当零样本下一位置预测器。我们在三个真实世界的移动数据集上测试了超过15个LLM,发现LLM可以获得高达36.2%的准确率,与专门为人类移动性设计的其他模型相比,这是一个显着的相对改进,接近640%。我们还测试了数据污染,并探索了使用LLM作为基于文本的下一位置预测解释器的可能性,表明无论模型大小如何,LLM都可以解释其决策。

🔬 方法详解

问题定义:论文旨在解决下一位置预测问题,尤其是在个体历史数据匮乏的冷启动场景下。现有方法依赖于大量的个体历史轨迹数据进行训练,这限制了它们在新用户或数据稀疏区域的应用。这些方法无法有效利用通用的地理知识和常识推理能力。

核心思路:论文的核心思路是利用大型语言模型(LLM)中蕴含的丰富地理知识和强大的推理能力,将下一位置预测问题转化为一个语言理解和生成任务。通过提示工程,引导LLM基于少量上下文信息预测下一个可能的位置。这种方法无需针对特定用户进行训练,从而实现了零样本预测。

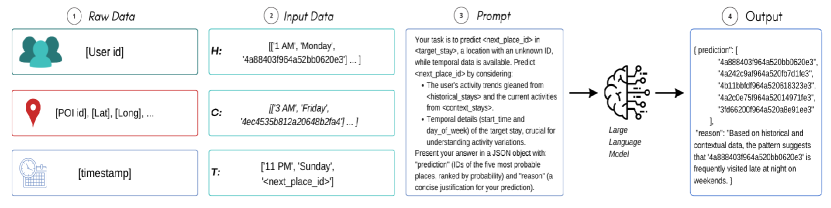

技术框架:该研究的技术框架主要包括以下几个步骤:1)数据准备:从真实世界的移动数据集提取用户轨迹数据,并将其转换为适合LLM处理的文本格式。2)提示工程:设计合适的提示模板,将用户的历史位置信息作为输入,引导LLM预测下一个位置。3)模型推理:使用不同的LLM(例如,GPT-3, LLaMA等)进行推理,生成预测的下一个位置。4)结果评估:将LLM的预测结果与真实位置进行比较,计算准确率等指标。

关键创新:该论文的关键创新在于将大型语言模型应用于零样本下一位置预测任务。与传统的基于用户历史轨迹的预测方法不同,该方法无需针对特定用户进行训练,而是直接利用LLM的通用知识和推理能力。此外,该研究还探索了使用LLM作为文本解释器,为下一位置预测提供可解释性。

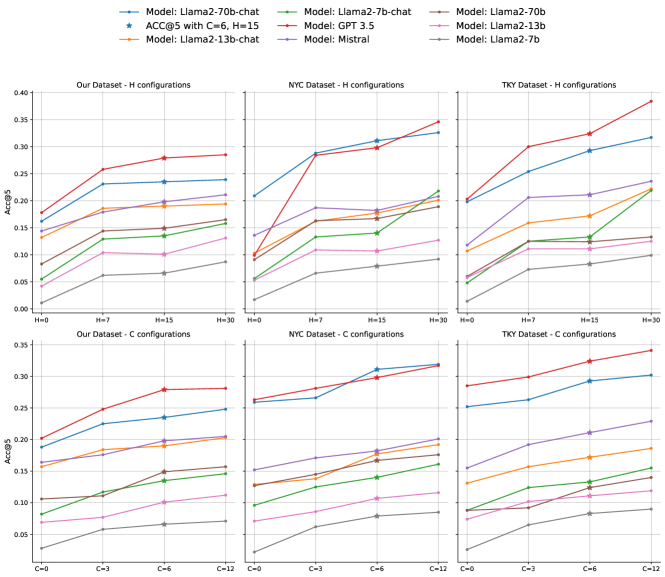

关键设计:论文的关键设计包括:1)提示模板的设计:如何有效地将用户的历史位置信息编码到提示中,以引导LLM进行预测。2)模型选择:选择合适的LLM,并根据其特点进行调整。3)评估指标:采用准确率等指标来评估LLM的预测性能。4)数据污染检测:为了验证LLM的预测能力并非来自于训练数据的泄露,论文还进行了数据污染检测。

🖼️ 关键图片

📊 实验亮点

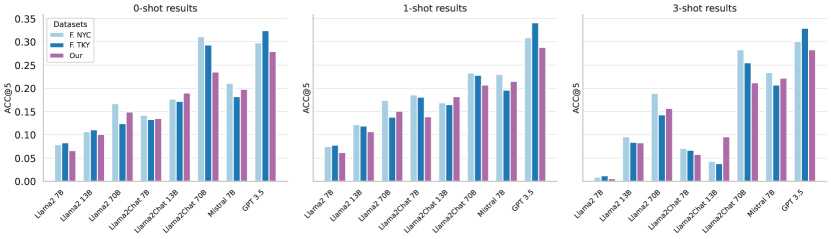

实验结果表明,大型语言模型在零样本下一位置预测任务中表现出色,准确率最高可达36.2%,与专门为人类移动性设计的模型相比,相对提升高达640%。此外,研究还发现,LLM可以作为文本解释器,为下一位置预测提供可解释性,这有助于提高用户对预测结果的信任度。

🎯 应用场景

该研究成果可应用于多种场景,如城市规划、交通管理、个性化推荐和应急响应。例如,在疫情爆发初期,可以利用该方法预测人群流动趋势,为疫情防控提供决策支持。此外,该方法还可以用于个性化旅游推荐,根据用户的兴趣和历史行为,预测其下一个可能访问的地点。未来,该研究可以进一步扩展到其他时空预测任务,如天气预报和交通流量预测。

📄 摘要(原文)

Predicting the locations an individual will visit in the future is crucial for solving many societal issues like disease diffusion and reduction of pollution. However, next-location predictors require a significant amount of individual-level information that may be scarce or unavailable in some scenarios (e.g., cold-start). Large Language Models (LLMs) have shown good generalization and reasoning capabilities and are rich in geographical knowledge, allowing us to believe that these models can act as zero-shot next-location predictors. We tested more than 15 LLMs on three real-world mobility datasets and we found that LLMs can obtain accuracies up to 36.2%, a significant relative improvement of almost 640% when compared to other models specifically designed for human mobility. We also test for data contamination and explored the possibility of using LLMs as text-based explainers for next-location prediction, showing that, regardless of the model size, LLMs can explain their decision.