A Robot Walks into a Bar: Can Language Models Serve as Creativity Support Tools for Comedy? An Evaluation of LLMs' Humour Alignment with Comedians

作者: Piotr Wojciech Mirowski, Juliette Love, Kory W. Mathewson, Shakir Mohamed

分类: cs.AI, cs.CL

发布日期: 2024-05-31 (更新: 2024-06-03)

备注: 15 pages, 1 figure, published at ACM FAccT 2024

💡 一句话要点

评估大型语言模型在喜剧创作中的创造力支持能力,揭示其偏见与局限性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 喜剧创作 创造力支持 伦理考量 价值对齐

📋 核心要点

- 现有大型语言模型在喜剧创作中表现出刻板印象和偏见,未能有效支持喜剧演员的创作过程。

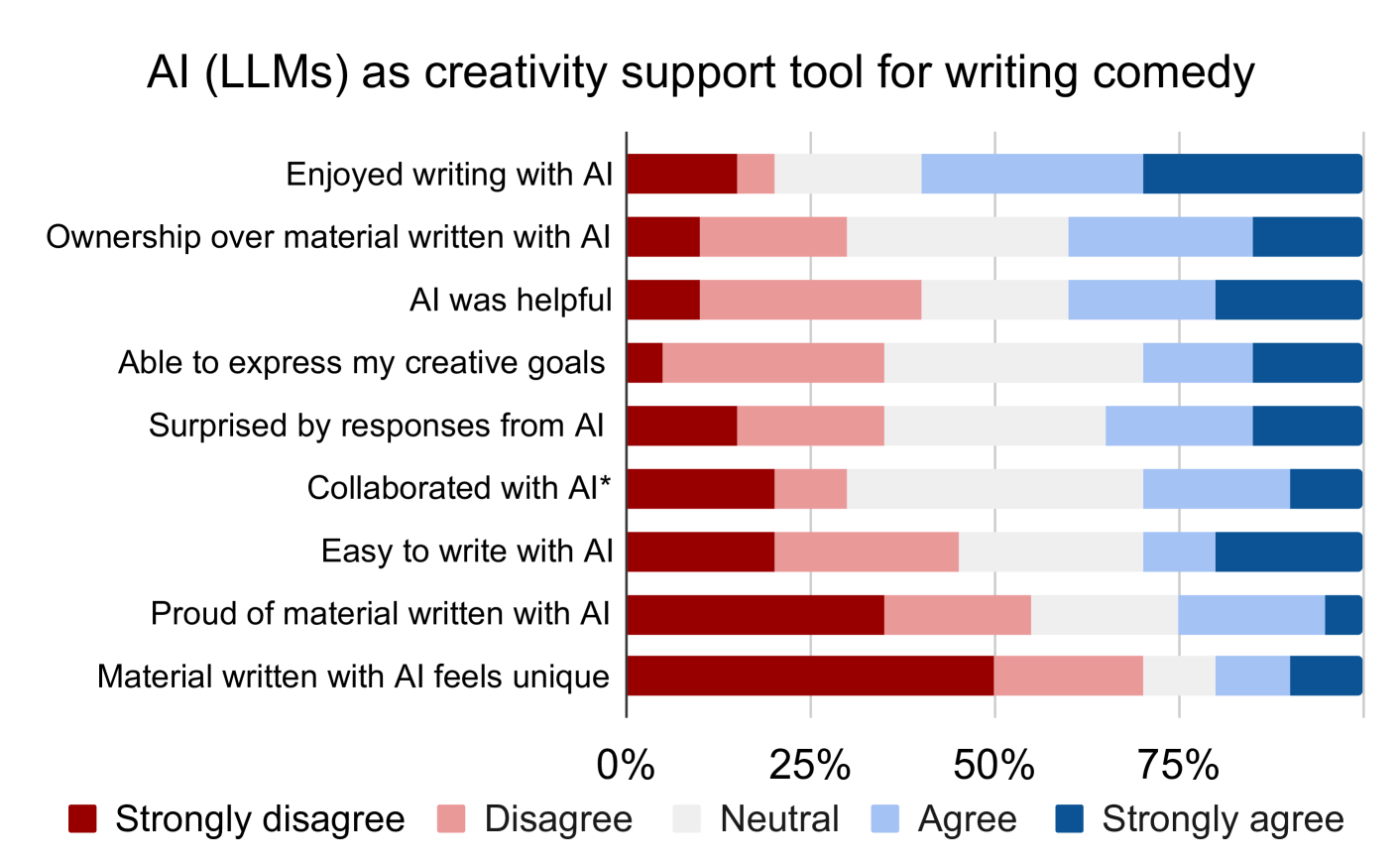

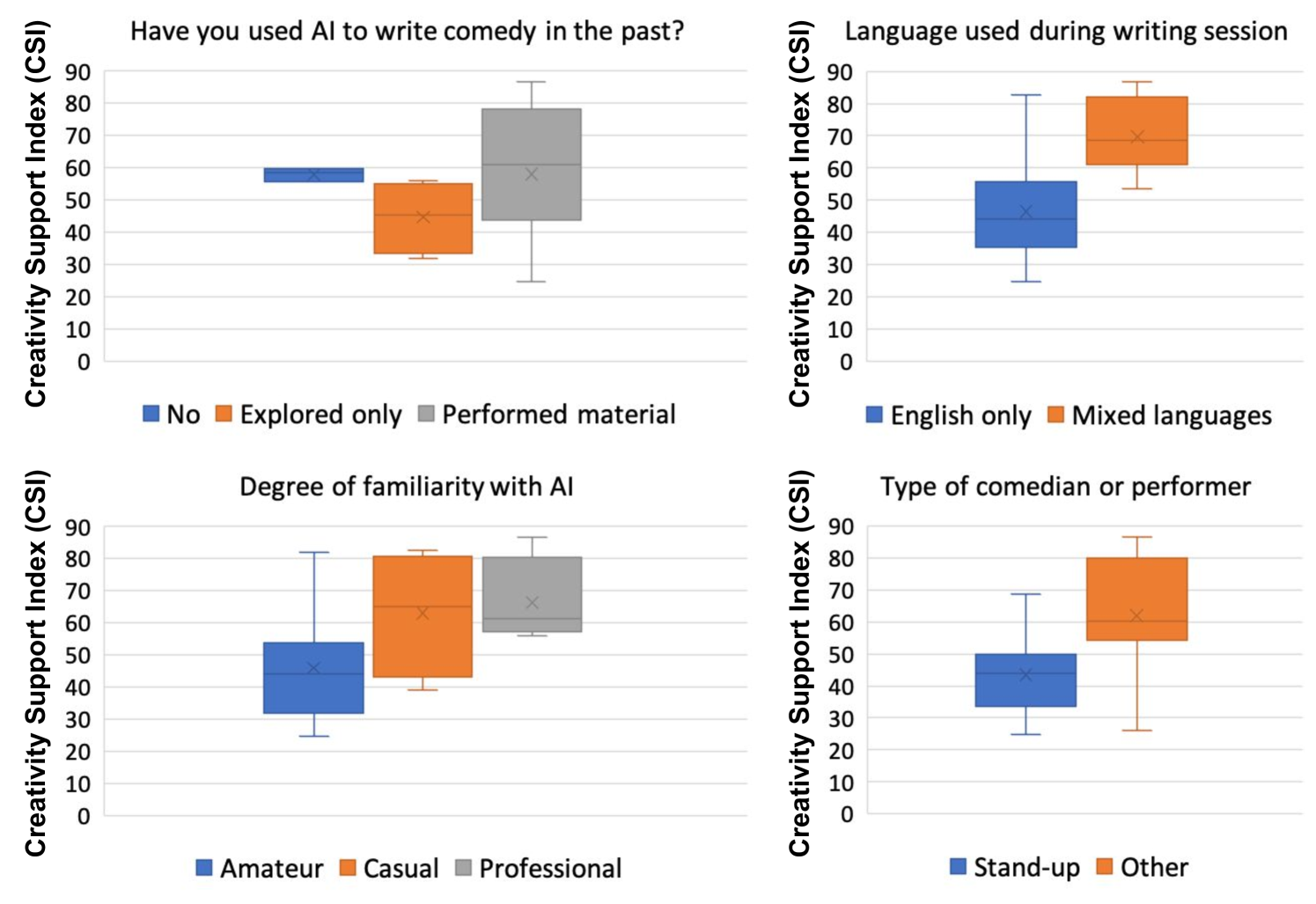

- 通过工作坊形式,收集专业喜剧演员对LLM在喜剧创作中应用的主观评价和伦理考量。

- 研究揭示了LLM在安全过滤机制中存在的审查问题,以及其在喜剧创作中价值对齐的挑战。

📝 摘要(中文)

本文通过对20位在爱丁堡艺术节和线上参与“AI x 喜剧”工作坊的专业喜剧演员的访谈,评估了大型语言模型(LLMs)作为喜剧创作工具的有效性。工作坊包括使用LLMs进行喜剧写作、评估AI作为写作工具的创造力支持指数的人机交互问卷,以及探讨喜剧演员使用AI的动机、过程以及对偏见、审查和版权等伦理问题的焦点小组讨论。参与者指出,安全过滤和指令调整的LLMs中使用的现有审核策略通过消除少数群体及其观点来强化霸权观点,并将其视为一种审查形式。同时,大多数参与者认为LLMs未能成功地作为创造力支持工具,而是产生了平淡且带有偏见的喜剧套路,类似于“20世纪50年代的游轮喜剧材料,但种族主义色彩稍淡”。这项工作扩展了关于有害言论与作为抵抗、讽刺和“向上攻击”实践的“冒犯性”语言之间微妙差异的学术研究。我们还探讨了这些语言模型背后的全球价值对齐,并讨论了基于社区的价值对齐和数据所有权对于构建更适合艺术家需求的AI工具的重要性。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLMs)在喜剧创作中作为创造力支持工具的有效性。现有方法,即直接使用LLMs生成喜剧内容,存在产生平淡、刻板印象和带有偏见的喜剧套路的痛点,无法满足专业喜剧演员的需求。此外,LLMs的安全过滤机制可能存在审查问题,限制了喜剧创作的表达空间。

核心思路:论文的核心思路是通过与专业喜剧演员的互动和反馈,深入了解LLMs在喜剧创作中的优势和局限性。通过定性和定量相结合的方法,评估LLMs的创造力支持能力,并探讨其在伦理和价值对齐方面的问题。这种以人为本的方法旨在揭示LLMs在实际应用中面临的挑战,并为未来开发更适合艺术家需求的AI工具提供指导。

技术框架:研究采用混合方法,包括:1) 为期3小时的“AI x 喜剧”工作坊,包括喜剧写作环节;2) 人机交互问卷,评估AI作为写作工具的创造力支持指数;3) 焦点小组讨论,探讨喜剧演员使用AI的动机、过程以及伦理问题。研究对象为20位在爱丁堡艺术节和线上进行现场表演的专业喜剧演员。

关键创新:论文的关键创新在于其以专业喜剧演员为中心,从艺术家的角度评估LLMs在喜剧创作中的应用。与以往侧重于技术指标的评估不同,该研究关注LLMs在实际创作过程中的表现,以及其对喜剧演员的创造力、表达和伦理观念的影响。此外,论文还探讨了LLMs的安全过滤机制可能存在的审查问题,以及其在价值对齐方面的挑战。

关键设计:研究的关键设计包括:1) 选择具有AI使用经验的专业喜剧演员作为研究对象,确保研究结果的代表性和有效性;2) 采用混合方法,结合定量和定性数据,全面评估LLMs的创造力支持能力;3) 通过焦点小组讨论,深入了解喜剧演员对LLMs的看法和体验;4) 关注LLMs的安全过滤机制和价值对齐问题,揭示其在喜剧创作中可能存在的伦理风险。

🖼️ 关键图片

📊 实验亮点

研究发现,LLMs生成的喜剧内容普遍平淡且带有偏见,未能有效支持喜剧演员的创作。参与者认为LLMs的安全过滤机制存在审查问题,限制了喜剧创作的表达空间。大多数参与者认为LLMs未能成功地作为创造力支持工具,而是产生了类似于“20世纪50年代的游轮喜剧材料,但种族主义色彩稍淡”的喜剧套路。研究强调了基于社区的价值对齐和数据所有权对于构建更适合艺术家需求的AI工具的重要性。

🎯 应用场景

该研究结果可应用于改进AI驱动的喜剧创作工具,使其更符合艺术家的需求,减少偏见和刻板印象,并避免不必要的审查。此外,该研究也为其他创意领域的AI应用提供了借鉴,强调了以人为本的设计理念和伦理考量的重要性。未来的研究可以探索如何利用社区数据和价值对齐机制,构建更具包容性和创造力的AI工具。

📄 摘要(原文)

We interviewed twenty professional comedians who perform live shows in front of audiences and who use artificial intelligence in their artistic process as part of 3-hour workshops on

AI x Comedy'' conducted at the Edinburgh Festival Fringe in August 2023 and online. The workshop consisted of a comedy writing session with large language models (LLMs), a human-computer interaction questionnaire to assess the Creativity Support Index of AI as a writing tool, and a focus group interrogating the comedians' motivations for and processes of using AI, as well as their ethical concerns about bias, censorship and copyright. Participants noted that existing moderation strategies used in safety filtering and instruction-tuned LLMs reinforced hegemonic viewpoints by erasing minority groups and their perspectives, and qualified this as a form of censorship. At the same time, most participants felt the LLMs did not succeed as a creativity support tool, by producing bland and biased comedy tropes, akin tocruise ship comedy material from the 1950s, but a bit less racist''. Our work extends scholarship about the subtle difference between, one the one hand, harmful speech, and on the other hand,offensive'' language as a practice of resistance, satire andpunching up''. We also interrogate the global value alignment behind such language models, and discuss the importance of community-based value alignment and data ownership to build AI tools that better suit artists' needs.