Robust Planning with LLM-Modulo Framework: Case Study in Travel Planning

作者: Atharva Gundawar, Mudit Verma, Lin Guan, Karthik Valmeekam, Siddhant Bhambri, Subbarao Kambhampati

分类: cs.AI

发布日期: 2024-05-31

💡 一句话要点

LLM-Modulo框架提升LLM在旅行规划任务中的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 旅行规划 LLM-Modulo框架 规划与推理 模块化设计

📋 核心要点

- 现有方法如CoT、ReAct和Reflexion在旅行规划任务中表现不佳,GPT3.5-Turbo的准确率接近于零,表明LLM在该领域面临挑战。

- LLM-Modulo框架通过模块化设计,将LLM与外部知识和推理模块相结合,从而提升其在复杂规划任务中的性能。

- 实验结果表明,LLM-Modulo框架显著提升了LLM在旅行规划任务中的性能,GPT4-Turbo提升4.6倍,GPT3.5-Turbo从0%提升到5%。

📝 摘要(中文)

大型语言模型(LLM)的应用已扩展到传统文本处理任务之外,它们在规划和推理任务中的潜力日益受到关注。尽管LLM具有多功能性,但如何有效利用它们仍然是一个挑战。LLM Modulo框架通过增强LLM与规划和推理活动的集成,标志着重要的进步。本文探讨了该框架在旅行规划领域的实际应用,并使用OSU NLP小组的旅行规划基准测试来评估LLM生成有效行程的能力。实验结果表明,LLM-Modulo框架显著提高了GPT4-Turbo和GPT3.5-Turbo等模型的性能,其中GPT3.5-Turbo的性能从0%提升到5%。此外,本文还强调了LLM在规划流程中的其他作用,例如提取有用的评论和评论重构器。

🔬 方法详解

问题定义:论文旨在解决LLM在旅行规划任务中表现不佳的问题。现有方法,如Chain of Thought (CoT)、ReAct和Reflexion,在生成有效旅行行程方面效果有限,无法充分利用LLM的推理能力。这些方法在处理复杂约束和依赖关系时存在困难,导致规划结果的准确性和可靠性较低。

核心思路:论文的核心思路是采用LLM-Modulo框架,将LLM分解为多个模块,并与外部知识库和推理模块相结合。通过模块化设计,可以更好地控制LLM的行为,并利用外部资源来增强其规划能力。这种方法允许针对特定任务定制LLM,并提高其在复杂规划场景中的鲁棒性。

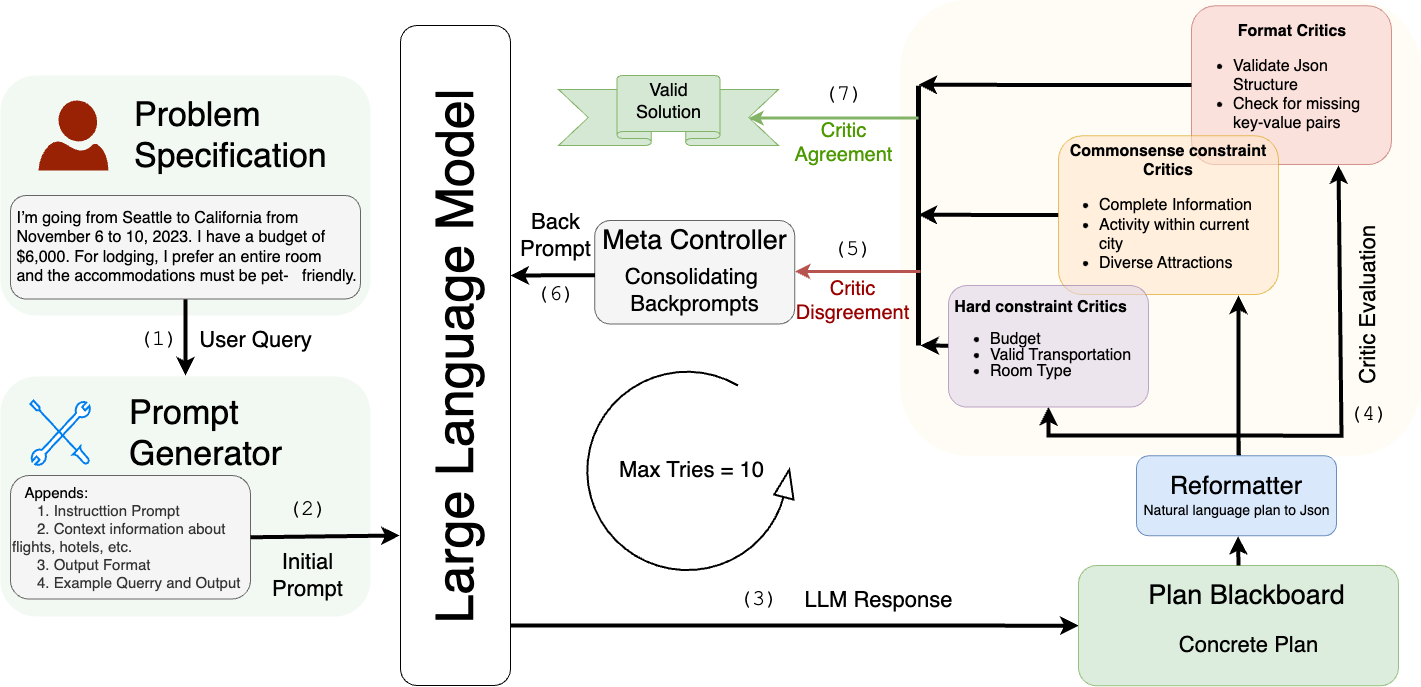

技术框架:LLM-Modulo框架包含以下主要模块:1) LLM作为核心推理引擎;2) 外部知识库,提供旅行相关的信息,如地点、交通方式和时间;3) 评论模块,用于评估生成的行程的有效性;4) 重构模块,用于根据评论结果调整行程。整个流程包括:用户输入自然语言查询,LLM生成初始行程,评论模块评估行程,重构模块根据评估结果修改行程,重复迭代直到生成满足要求的有效行程。

关键创新:最重要的技术创新点是LLM的模块化设计和与外部模块的集成。与传统的端到端方法相比,LLM-Modulo框架允许更灵活地控制LLM的行为,并利用外部知识和推理能力来增强其规划能力。这种方法可以显著提高LLM在复杂规划任务中的准确性和可靠性。

关键设计:论文中关键的设计包括:1) 如何选择合适的外部知识库;2) 如何设计有效的评论模块,以准确评估行程的有效性;3) 如何设计重构模块,以根据评论结果有效地修改行程。这些设计需要根据具体的旅行规划任务进行调整和优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM-Modulo框架显著提升了LLM在旅行规划任务中的性能。GPT4-Turbo的性能提升了4.6倍,而GPT3.5-Turbo的性能从0%提升到5%。这些结果表明,LLM-Modulo框架是一种有效的提升LLM在复杂规划任务中性能的方法。

🎯 应用场景

该研究成果可应用于智能旅行助手、个性化行程推荐、自动旅行规划等领域。通过提升LLM在旅行规划任务中的性能,可以为用户提供更智能、更便捷的旅行服务,并降低人工规划的成本。此外,该框架也可推广到其他复杂规划领域,如物流调度、资源分配等。

📄 摘要(原文)

As the applicability of Large Language Models (LLMs) extends beyond traditional text processing tasks, there is a burgeoning interest in their potential to excel in planning and reasoning assignments, realms traditionally reserved for System 2 cognitive competencies. Despite their perceived versatility, the research community is still unraveling effective strategies to harness these models in such complex domains. The recent discourse introduced by the paper on LLM Modulo marks a significant stride, proposing a conceptual framework that enhances the integration of LLMs into diverse planning and reasoning activities. This workshop paper delves into the practical application of this framework within the domain of travel planning, presenting a specific instance of its implementation. We are using the Travel Planning benchmark by the OSU NLP group, a benchmark for evaluating the performance of LLMs in producing valid itineraries based on user queries presented in natural language. While popular methods of enhancing the reasoning abilities of LLMs such as Chain of Thought, ReAct, and Reflexion achieve a meager 0%, 0.6%, and 0% with GPT3.5-Turbo respectively, our operationalization of the LLM-Modulo framework for TravelPlanning domain provides a remarkable improvement, enhancing baseline performances by 4.6x for GPT4-Turbo and even more for older models like GPT3.5-Turbo from 0% to 5%. Furthermore, we highlight the other useful roles of LLMs in the planning pipeline, as suggested in LLM-Modulo, which can be reliably operationalized such as extraction of useful critics and reformulator for critics.