One QuantLLM for ALL: Fine-tuning Quantized LLMs Once for Efficient Deployments

作者: Ke Yi, Yuhui Xu, Heng Chang, Chen Tang, Yuan Meng, Tong Zhang, Jia Li

分类: cs.AI

发布日期: 2024-05-30

💡 一句话要点

提出One QuantLLM for ALL框架,通过一次量化微调实现LLM在不同资源约束下的高效部署。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 量化 一次性学习 模型压缩 低秩适配器 资源受限部署 超网络

📋 核心要点

- 现有LLM量化方法需针对不同资源约束场景重复训练,耗时且效率低。

- 提出One QuantLLM for ALL框架,通过一次训练得到适应不同量化级别的子网络。

- 实验表明,该方法在保持高性能的同时,显著减少了LLM在不同场景下的部署时间。

📝 摘要(中文)

大型语言模型(LLMs)发展迅速,但面临着巨大的内存需求。量化技术在LLMs中展现了潜力,但现有方法通常需要长时间的训练来缓解量化损失带来的性能下降。然而,在具有不同资源约束的各种场景(例如,服务器和个人计算机)中部署LLMs需要针对每个应用重复训练,这加剧了长时间训练的问题。因此,训练一个一次性(OFA)的超网络,能够通过一次性训练为下游应用产生各种最佳子网络是有利的。然而,当前语言模型的规模阻碍了效率,并放大了子网络之间权重共享的干扰。我们初步尝试将一次性框架扩展到大型语言模型。具体来说,我们解耦共享权重以消除干扰,并结合低秩适配器以提高训练效率。此外,我们观察到传统均匀采样导致训练资源分配不平衡。我们引入了一种非参数调度器来调整每个量化配置的采样率,从而在具有不同需求的子网络之间实现更平衡的分配。我们在LLaMA2系列上验证了该方法,下游评估证实了我们在面对多种场景时能够保持高性能,同时显著减少部署时间。

🔬 方法详解

问题定义:现有LLM量化方法的主要痛点在于,针对不同的部署场景(例如,服务器和个人电脑),需要对量化后的模型进行重复的微调训练。这导致了巨大的计算开销和时间成本,尤其是在资源受限的环境下,使得LLM的部署变得困难。现有方法无法实现一次训练,多次部署,灵活适应不同资源约束的需求。

核心思路:本文的核心思路是借鉴Once-For-All (OFA) 的思想,训练一个“超网络”,这个超网络包含了各种量化级别的子网络。通过一次训练,超网络可以学习到不同量化配置下的权重,从而可以根据实际的资源约束,快速地提取出最佳的子网络进行部署。这样就避免了针对每个场景都进行重复训练的开销。

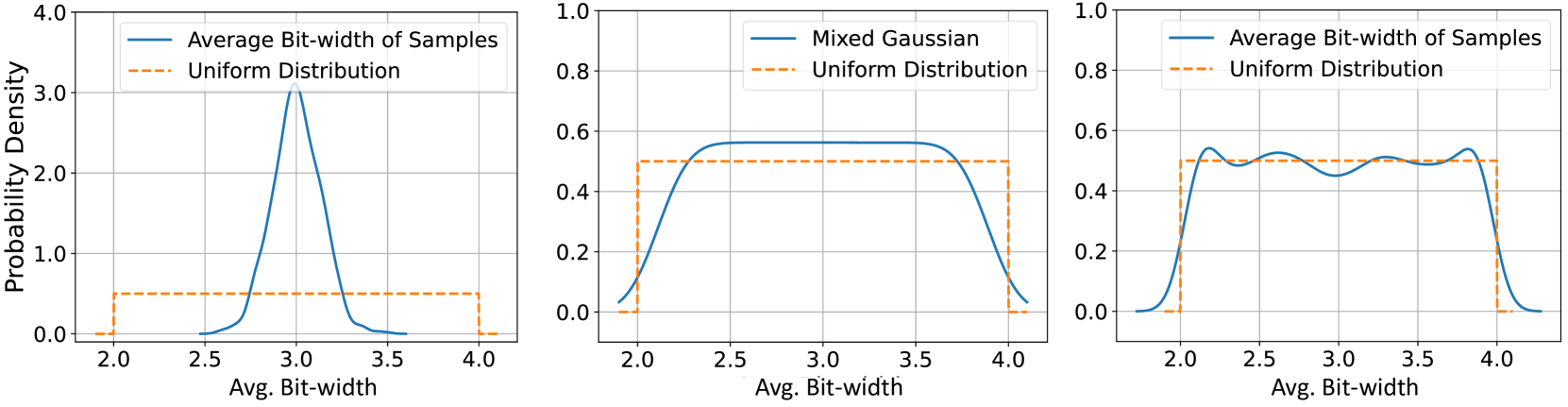

技术框架:该框架主要包含以下几个阶段:1) 权重解耦:为了减少不同量化级别子网络之间的干扰,作者解耦了共享权重。2) 低秩适配器(LoRA):为了提高训练效率,作者采用了LoRA进行微调。LoRA通过引入低秩矩阵来近似权重更新,从而减少了需要训练的参数量。3) 非参数调度器:为了解决训练资源分配不平衡的问题,作者引入了一个非参数调度器,用于动态调整不同量化配置的采样率。

关键创新:该论文的关键创新在于将OFA的思想成功地应用到了LLM的量化微调中。通过权重解耦、LoRA和非参数调度器等技术手段,解决了LLM规模大、训练资源分配不平衡等问题,实现了高效的一次性量化微调。与现有方法相比,该方法可以在保持高性能的同时,显著减少部署时间。

关键设计:1) 权重解耦:具体实现方式未知,但目的是减少不同量化级别子网络之间的权重干扰。2) LoRA:使用LoRA进行微调,具体LoRA的秩(rank)大小等参数设置未知。3) 非参数调度器:该调度器根据不同量化配置的需求动态调整采样率,具体实现细节未知,但目标是平衡不同子网络的训练资源分配。

🖼️ 关键图片

📊 实验亮点

该论文在LLaMA2系列模型上进行了实验验证。实验结果表明,该方法可以在保持高性能的同时,显著减少部署时间。具体的性能数据和提升幅度未知,但摘要中强调了其在多种场景下保持高性能并减少部署时间的优势。

🎯 应用场景

该研究成果具有广泛的应用前景。它可以应用于各种需要部署LLM的场景,尤其是在资源受限的环境下,例如移动设备、嵌入式系统等。通过一次训练,就可以得到适应不同硬件平台的量化模型,从而降低了部署成本,提高了LLM的可用性。此外,该方法还可以应用于模型压缩、模型加速等领域,具有重要的实际价值。

📄 摘要(原文)

Large Language Models (LLMs) have advanced rapidly but face significant memory demands. While quantization has shown promise for LLMs, current methods typically require lengthy training to alleviate the performance degradation from quantization loss. However, deploying LLMs across diverse scenarios with different resource constraints, e.g., servers and personal computers, requires repeated training per application, which amplifies the lengthy training problem. Given that, it is advantageous to train a once-for-all (OFA) supernet capable of yielding diverse optimal subnets for downstream applications through one-shot training. Nonetheless, the scale of current language models impedes efficiency and amplifies interference from weight sharing between subnets. We make an initial attempt to extend the once-for-all framework to large language models. Specifically, we decouple shared weights to eliminate the interference and incorporate Low-Rank adapters for training efficiency. Furthermore, we observe the imbalance allocation of training resources from the traditional uniform sampling. A non-parametric scheduler is introduced to adjust the sampling rate for each quantization configuration, achieving a more balanced allocation among subnets with varying demands. We validate the approach on LLaMA2 families, and downstream evaluation confirms our ability to maintain high performance while significantly reducing deployment time faced with multiple scenarios.