Grade Like a Human: Rethinking Automated Assessment with Large Language Models

作者: Wenjing Xie, Juxin Niu, Chun Jason Xue, Nan Guan

分类: cs.AI

发布日期: 2024-05-30

💡 一句话要点

提出基于LLM的自动化评分系统,模拟人类评分全流程,提升复杂问题评分质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动化评分 大型语言模型 教育评估 评分标准设计 评分后审查

📋 核心要点

- 现有自动化评分方法在处理复杂问题时表现不佳,无法达到人类评分水平,主要瓶颈在于评分流程不够完整。

- 论文提出基于LLM的自动化评分系统,覆盖评分标准制定、评分与反馈、以及评分后审查等完整流程。

- 通过在OS和Mohler数据集上的实验,验证了该方法的有效性,为基于LLM的自动化评分系统提供了新的思路。

📝 摘要(中文)

现有的大语言模型(LLM)在自动化评分方面的应用,尚未达到人类评分员的水平,尤其是在复杂问题的评分上。现有的研究主要集中在评分过程中的特定步骤,即使用预定义的评分标准进行评分。然而,评分是一个多方面的过程,包括评分标准设计和评分后审查等关键步骤。目前缺乏系统性的研究来探索LLM在增强整个评分过程方面的潜力。本文提出了一个基于LLM的评分系统,该系统涵盖了整个评分过程,包括:1) 开发评分标准,不仅考虑问题,还考虑学生的答案,从而更准确地反映学生的表现。2) 在评分标准的指导下,为每个学生提供准确和一致的分数,以及定制的反馈。3) 进行评分后审查,以更好地确保准确性和公平性。此外,我们从大学操作系统课程中收集了一个名为OS的新数据集,并在我们的新数据集和广泛使用的Mohler数据集上进行了大量的实验。实验结果表明了我们提出的方法的有效性,为开发基于LLM的自动化评分系统提供了一些新的见解。

🔬 方法详解

问题定义:现有自动化评分系统,特别是基于LLM的系统,在复杂问题评分上与人类评分员存在差距。主要痛点在于评分流程不完整,仅关注使用预定义评分标准进行评分,忽略了评分标准的设计和评分后的审查环节。这导致评分结果不够准确、公平,且缺乏个性化反馈。

核心思路:论文的核心思路是将整个评分流程进行建模,使其更接近人类评分员的思维方式。具体来说,不仅使用LLM进行评分,还利用LLM辅助设计评分标准,并进行评分后的审查,从而提高评分的准确性、一致性和公平性。同时,为学生提供个性化的反馈,帮助他们更好地理解自己的不足。

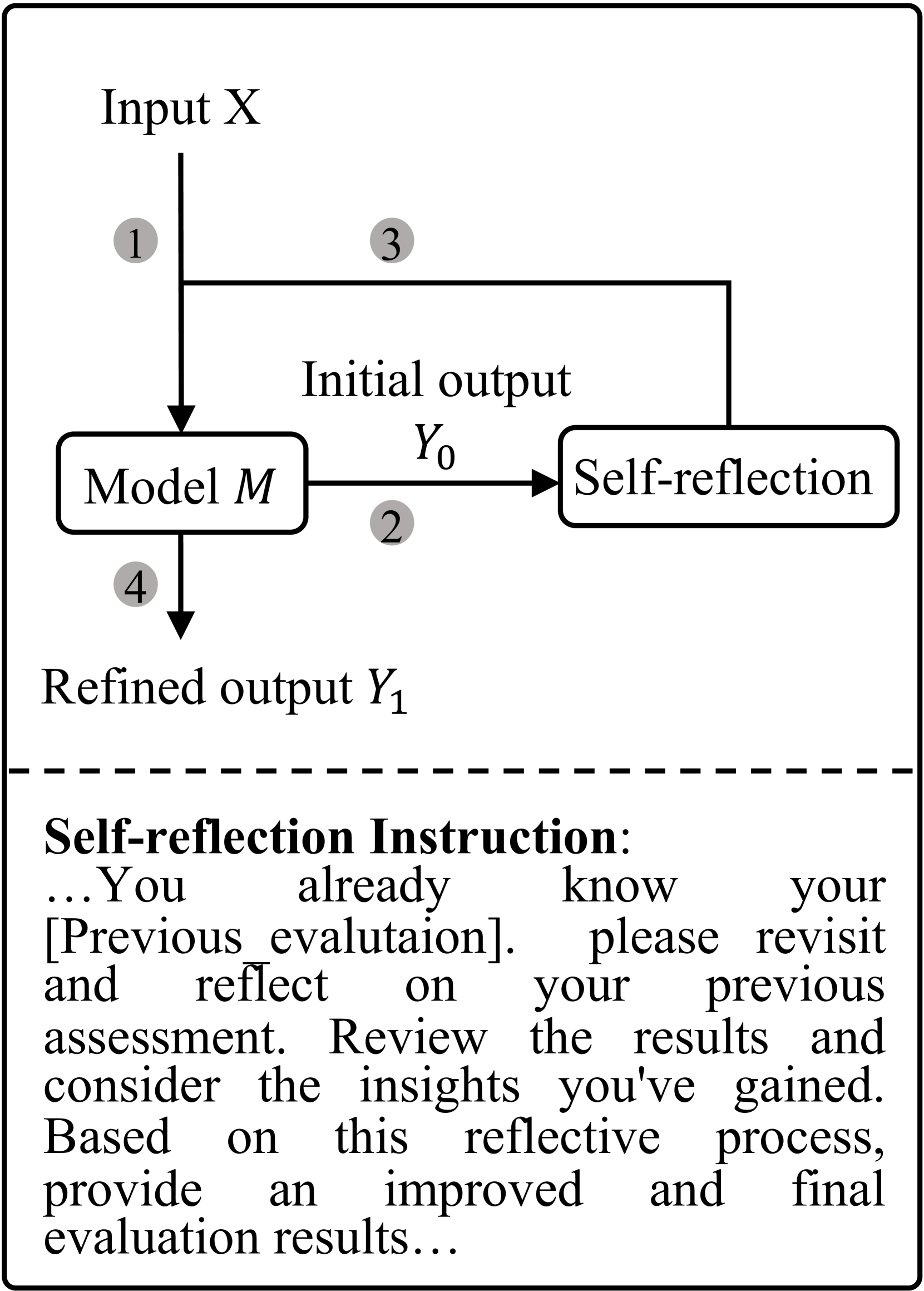

技术框架:该系统包含三个主要模块:1) 评分标准生成模块:利用LLM分析问题和学生答案,生成更细致、更全面的评分标准。2) 评分与反馈模块:基于生成的评分标准,利用LLM对学生答案进行评分,并提供个性化的反馈。3) 评分后审查模块:利用LLM对评分结果进行审查,发现潜在的错误或偏差,并进行修正。整个流程旨在模拟人类评分员的完整评分过程。

关键创新:该论文的关键创新在于将LLM应用于评分流程的各个环节,而不仅仅是评分本身。通过LLM辅助设计评分标准和进行评分后审查,可以显著提高评分的质量和效率。此外,该系统能够为学生提供个性化的反馈,帮助他们更好地学习。

关键设计:论文中没有明确给出关键的参数设置、损失函数、网络结构等技术细节。但是,可以推断,评分标准生成模块可能使用了生成式LLM,评分与反馈模块可能使用了分类或回归式LLM,评分后审查模块可能使用了异常检测或相似度计算等技术。具体的技术细节需要参考论文的补充材料或代码。

🖼️ 关键图片

📊 实验亮点

论文在自建的OS数据集和广泛使用的Mohler数据集上进行了实验,验证了所提出方法的有效性。具体性能数据未知,但论文强调该方法能够提高评分的准确性、一致性和公平性,并为学生提供个性化的反馈。相较于仅使用LLM进行评分的方法,该方法具有显著的优势。

🎯 应用场景

该研究成果可广泛应用于在线教育、大规模考试、作业批改等场景,减轻教师的评分负担,提高评分效率和公平性。通过个性化反馈,还能提升学生的学习效果。未来,该技术有望应用于更复杂的评估任务,例如论文评审、项目评估等。

📄 摘要(原文)

While large language models (LLMs) have been used for automated grading, they have not yet achieved the same level of performance as humans, especially when it comes to grading complex questions. Existing research on this topic focuses on a particular step in the grading procedure: grading using predefined rubrics. However, grading is a multifaceted procedure that encompasses other crucial steps, such as grading rubrics design and post-grading review. There has been a lack of systematic research exploring the potential of LLMs to enhance the entire grading~process. In this paper, we propose an LLM-based grading system that addresses the entire grading procedure, including the following key components: 1) Developing grading rubrics that not only consider the questions but also the student answers, which can more accurately reflect students' performance. 2) Under the guidance of grading rubrics, providing accurate and consistent scores for each student, along with customized feedback. 3) Conducting post-grading review to better ensure accuracy and fairness. Additionally, we collected a new dataset named OS from a university operating system course and conducted extensive experiments on both our new dataset and the widely used Mohler dataset. Experiments demonstrate the effectiveness of our proposed approach, providing some new insights for developing automated grading systems based on LLMs.