Knowledge Graph Tuning: Real-time Large Language Model Personalization based on Human Feedback

作者: Jingwei Sun, Zhixu Du, Yiran Chen

分类: cs.AI

发布日期: 2024-05-30

💡 一句话要点

提出知识图谱调优(KGT)方法,实现基于人类反馈的实时大语言模型个性化。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 大语言模型 个性化 实时调优 人机交互

📋 核心要点

- 现有LLM个性化方法依赖反向传播微调模型参数,导致计算成本高、内存消耗大,且缺乏可解释性。

- 论文提出知识图谱调优(KGT)方法,通过优化知识图谱而非LLM参数,实现高效且可解释的个性化。

- 实验表明,KGT在GPT-2、Llama2和Llama3等模型上显著提升了个性化性能,并降低了延迟和GPU内存成本。

📝 摘要(中文)

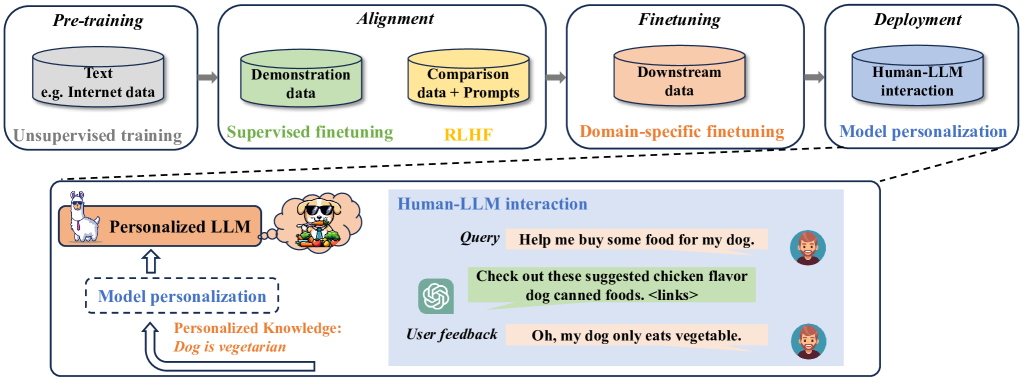

大型语言模型(LLM)在各种自然语言处理任务中表现出卓越的能力。然而,LLM在部署后会遇到具有个性化事实知识的用户,这些知识通过用户与LLM的交互持续反映出来。为了提升用户体验,实时的模型个性化至关重要,它允许LLM基于用户反馈调整用户特定的知识。现有方法大多需要反向传播来微调模型参数,这会产生高昂的计算和内存成本。此外,这些方法的可解释性较低,这将在长期使用过程中对模型性能造成不可预见的影响,因为用户的个性化知识会大量积累。为了解决这些挑战,我们提出了知识图谱调优(KGT),这是一种利用知识图谱(KG)来个性化LLM的新方法。KGT从用户的查询和反馈中提取个性化的事实知识三元组,并优化KG,而无需修改LLM参数。我们的方法通过避免反向传播来提高计算和内存效率,并通过使KG调整对人类可理解来确保可解释性。使用最先进的LLM(包括GPT-2、Llama2和Llama3)进行的实验表明,KGT显著提高了个性化性能,同时降低了延迟和GPU内存成本。最终,KGT为在用户与LLM交互期间进行有效、高效和可解释的实时LLM个性化提供了一个有希望的解决方案。

🔬 方法详解

问题定义:现有的大语言模型个性化方法,如微调,需要大量的计算资源和内存,并且缺乏可解释性。当用户长期使用模型并积累大量个性化知识时,这些问题会变得更加严重。因此,如何高效、低成本且可解释地实现大语言模型的实时个性化是一个关键问题。

核心思路:论文的核心思路是利用知识图谱(KG)来存储和管理用户的个性化知识,并通过调整KG来实现LLM的个性化。这种方法避免了直接修改LLM的参数,从而降低了计算成本和内存消耗,同时提高了可解释性,因为KG的调整过程对人类是可理解的。

技术框架:KGT的技术框架主要包括以下几个阶段:1) 从用户的查询和反馈中提取个性化的事实知识三元组(例如,

关键创新:KGT最重要的技术创新点在于它将知识图谱引入到LLM的个性化过程中,并提出了一种新的调优范式,即通过优化KG而非LLM参数来实现个性化。这与传统的微调方法有本质的区别,因为它避免了反向传播,从而大大降低了计算成本和内存消耗,并提高了可解释性。

关键设计:KGT的关键设计包括:1) 如何有效地从用户的查询和反馈中提取高质量的事实知识三元组;2) 如何设计知识图谱的结构和更新策略,以保证KG的准确性和完整性;3) 如何将KG中的信息有效地融入到LLM的生成过程中,以提高个性化效果。具体的参数设置、损失函数和网络结构等细节取决于具体的LLM和KG的实现方式,论文中可能没有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,KGT在GPT-2、Llama2和Llama3等模型上显著提升了个性化性能,同时降低了延迟和GPU内存成本。具体的性能数据和提升幅度在论文中进行了详细的展示和对比,证明了KGT的有效性和优越性。例如,KGT可能在某些指标上比传统微调方法提升了X%,同时降低了Y%的GPU内存消耗。

🎯 应用场景

KGT具有广泛的应用前景,例如个性化推荐系统、智能客服、教育辅导等领域。它可以帮助LLM更好地理解用户的需求和偏好,从而提供更精准、更个性化的服务。此外,KGT的可解释性使得用户可以更好地理解模型的行为,从而增强用户对模型的信任感。未来,KGT有望成为LLM个性化的重要技术手段。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable proficiency in a range of natural language processing tasks. Once deployed, LLMs encounter users with personalized factual knowledge, and such personalized knowledge is consistently reflected through users' interactions with the LLMs. To enhance user experience, real-time model personalization is essential, allowing LLMs to adapt user-specific knowledge based on user feedback during human-LLM interactions. Existing methods mostly require back-propagation to finetune the model parameters, which incurs high computational and memory costs. In addition, these methods suffer from low interpretability, which will cause unforeseen impacts on model performance during long-term use, where the user's personalized knowledge is accumulated extensively.To address these challenges, we propose Knowledge Graph Tuning (KGT), a novel approach that leverages knowledge graphs (KGs) to personalize LLMs. KGT extracts personalized factual knowledge triples from users' queries and feedback and optimizes KGs without modifying the LLM parameters. Our method improves computational and memory efficiency by avoiding back-propagation and ensures interpretability by making the KG adjustments comprehensible to humans.Experiments with state-of-the-art LLMs, including GPT-2, Llama2, and Llama3, show that KGT significantly improves personalization performance while reducing latency and GPU memory costs. Ultimately, KGT offers a promising solution of effective, efficient, and interpretable real-time LLM personalization during user interactions with the LLMs.