Calibrating Reasoning in Language Models with Internal Consistency

作者: Zhihui Xie, Jizhou Guo, Tong Yu, Shuai Li

分类: cs.AI, cs.CL

发布日期: 2024-05-29 (更新: 2024-12-05)

备注: NeurIPS 2024 camera ready

💡 一句话要点

利用内部一致性校准语言模型推理,提升推理性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 推理校准 内部一致性 中间层表征 思维链 可解释性 自评估

📋 核心要点

- 大型语言模型在推理过程中存在内部不一致性,降低了推理的可靠性,现有方法难以有效利用模型内部信息。

- 论文提出利用“内部一致性”来衡量模型在推理过程中的置信度,并以此为依据校准推理路径。

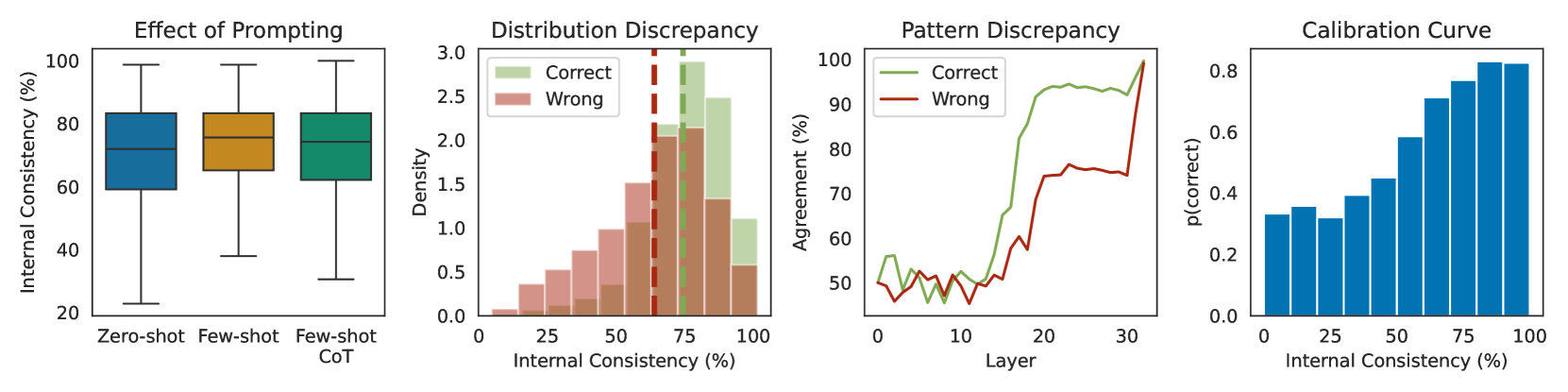

- 实验表明,该方法能够有效区分正确和错误的推理路径,并通过加权高一致性路径显著提升推理性能。

📝 摘要(中文)

大型语言模型(LLMs)在各种推理任务中表现出令人印象深刻的能力,这得益于诸如思维链提示等技术,这些技术可以引出语言化的推理过程。然而,LLMs经常生成带有明显错误和矛盾的文本,这让人怀疑它们是否有能力稳健地处理和利用生成的理由。在这项工作中,我们通过内部表征的视角来研究LLMs中的推理,重点关注这些表征如何受到生成的理由的影响。我们的初步分析表明,虽然生成的理由提高了答案的准确性,但模型中间层和最终层的内部表征之间出现了不一致,这可能会削弱其推理过程的可靠性。为了解决这个问题,我们提出内部一致性作为衡量模型置信度的一种方法,通过检查从中间层解码的潜在预测的一致性。跨不同模型和数据集的广泛实证研究表明,内部一致性有效地区分了正确和不正确的推理路径。受此启发,我们提出了一种新的方法,通过对具有高内部一致性的推理路径进行加权来校准推理,从而显著提高推理性能。进一步的分析揭示了跨层注意力和前馈模块中的不同模式,从而深入了解了内部不一致的出现。总而言之,我们的结果证明了使用内部表征进行LLMs自我评估的潜力。我们的代码可在github.com/zhxieml/internal-consistency上找到。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在推理过程中产生的内部不一致性问题。现有方法,如思维链提示,虽然能提高答案准确性,但模型内部表征在不同层之间存在矛盾,导致推理过程不可靠。这种内部不一致性使得模型即使给出了看似合理的解释,其内部运作机制也可能存在问题。

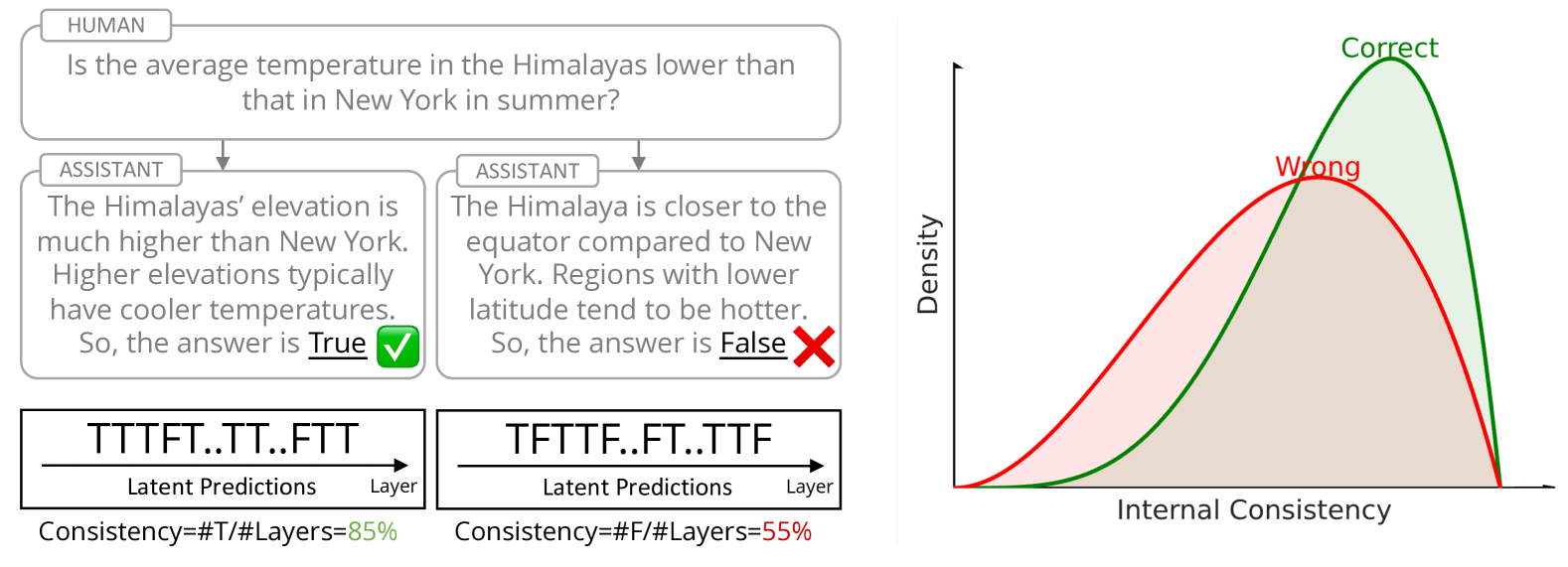

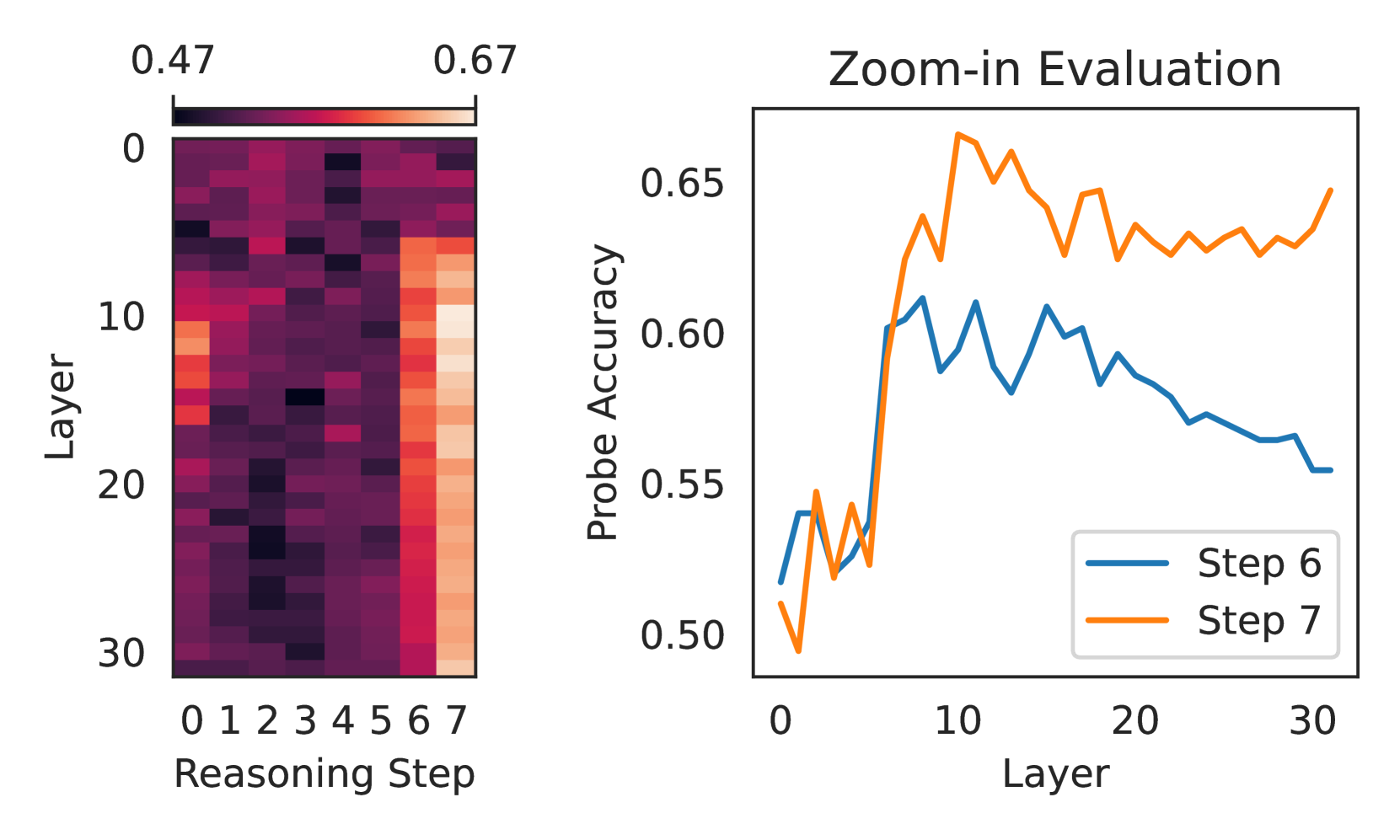

核心思路:论文的核心思路是利用模型中间层的内部表征来评估推理过程的“内部一致性”。如果模型在不同层产生的预测结果一致,则认为该推理路径更可靠。通过对高内部一致性的推理路径进行加权,可以校准模型的推理过程,提高整体性能。这种方法的核心在于挖掘和利用模型自身的内部信息,而非仅仅依赖最终的输出结果。

技术框架:整体框架包括以下几个主要步骤:1) 使用思维链提示等方法生成多个推理路径;2) 从模型的中间层提取内部表征;3) 基于中间层表征解码出潜在的预测结果;4) 计算不同层预测结果之间的“内部一致性”得分;5) 根据内部一致性得分对不同的推理路径进行加权;6) 最终的预测结果由加权后的推理路径共同决定。

关键创新:论文最重要的创新点在于提出了“内部一致性”这一概念,并将其作为衡量模型推理可靠性的指标。与以往关注模型输出结果的方法不同,该方法深入挖掘了模型内部的表征信息,从而更全面地评估推理过程的质量。此外,利用内部一致性进行推理路径加权也是一种新颖的校准方法。

关键设计:论文的关键设计包括:1) 如何选择合适的中间层进行表征提取;2) 如何定义和计算内部一致性得分(例如,可以使用交叉熵损失或余弦相似度等);3) 如何根据内部一致性得分对推理路径进行加权(例如,可以使用softmax函数将一致性得分转化为权重);4) 如何选择合适的解码器从中间层表征中预测结果。具体参数设置和网络结构的选择可能需要根据不同的模型和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个数据集上都取得了显著的性能提升。例如,在某些数据集上,该方法能够将推理准确率提高5%以上,并且优于现有的基线方法。此外,论文还通过分析注意力机制和前馈网络,深入探讨了内部不一致性产生的原因。

🎯 应用场景

该研究成果可应用于各种需要可靠推理的场景,例如问答系统、对话生成、代码生成等。通过提高语言模型的推理可靠性,可以减少错误信息的传播,提升用户体验。未来,该方法可以进一步扩展到其他类型的模型和任务中,例如多模态推理、知识图谱推理等,具有广阔的应用前景。

📄 摘要(原文)

Large language models (LLMs) have demonstrated impressive capabilities in various reasoning tasks, aided by techniques like chain-of-thought prompting that elicits verbalized reasoning. However, LLMs often generate text with obvious mistakes and contradictions, raising doubts about their ability to robustly process and utilize generated rationales. In this work, we investigate reasoning in LLMs through the lens of internal representations, focusing on how these representations are influenced by generated rationales. Our preliminary analysis reveals that while generated rationales improve answer accuracy, inconsistencies emerge between the model's internal representations in middle layers and those in final layers, potentially undermining the reliability of their reasoning processes. To address this, we propose internal consistency as a measure of the model's confidence by examining the agreement of latent predictions decoded from intermediate layers. Extensive empirical studies across different models and datasets demonstrate that internal consistency effectively distinguishes between correct and incorrect reasoning paths. Motivated by this, we propose a new approach to calibrate reasoning by up-weighting reasoning paths with high internal consistency, resulting in a significant boost in reasoning performance. Further analysis uncovers distinct patterns in attention and feed-forward modules across layers, providing insights into the emergence of internal inconsistency. In summary, our results demonstrate the potential of using internal representations for self-evaluation of LLMs. Our code is available at github.com/zhxieml/internal-consistency.