Revision Matters: Generative Design Guided by Revision Edits

作者: Tao Li, Chin-Yi Cheng, Amber Xie, Gang Li, Yang Li

分类: cs.HC, cs.AI, cs.CV, cs.LG

发布日期: 2024-05-27

💡 一句话要点

提出基于人类修订指导的生成式设计方法,提升多模态布局生成质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成式设计 多模态学习 人机协作 布局生成 修订编辑

📋 核心要点

- 现有布局设计方法缺乏对人类迭代修订过程的有效建模,导致生成质量受限。

- 提出一种基于人类修订编辑指导的生成式设计框架,利用专家知识提升模型性能。

- 实验表明,人类修订能显著提升布局生成质量,FID分数接近人类水平,优于自我修订。

📝 摘要(中文)

本文研究了人类设计师的修订编辑如何帮助多模态生成模型。为此,作者构建了一个专家数据集,记录了人类设计师如何迭代地编辑和改进布局生成,并以语言目标为提示。基于该数据,作者探索了在Gemini多模态骨干模型上进行各种监督微调任务设置。结果表明,人类修订在迭代布局优化中起着关键作用。尽管专家修订编辑存在噪声,但它使模型获得了非常强的设计FID分数(约10),接近人类表现(约6)。相比之下,完全依赖模型自身判断的自我修订会导致回声室效应,阻碍迭代改进,有时甚至导致生成质量下降。幸运的是,作者发现早期阶段提供人类指导对于最终生成至关重要。这种人机协作场景为基于预训练大型多模态模型的迭代设计修订铺平了道路。

🔬 方法详解

问题定义:论文旨在解决布局设计中,如何有效利用人类设计师的迭代修订过程来提升生成模型性能的问题。现有方法通常忽略或无法有效利用人类的专业知识,导致生成结果不够理想,缺乏迭代改进的能力。自我修订方法容易陷入局部最优,产生“回声室”效应。

核心思路:论文的核心思路是将人类设计师的修订编辑作为指导信号,通过监督学习的方式,让生成模型学习人类的修改策略,从而在迭代过程中逐步提升布局设计的质量。这种方法模拟了人类设计师不断修改和完善设计的流程,能够更好地利用人类的专业知识。

技术框架:整体框架基于一个大型多模态模型(Gemini),通过监督微调的方式,学习人类设计师的修订编辑。框架包含以下主要阶段:1) 数据收集:构建包含人类设计师迭代修订过程的数据集,包括初始布局、语言提示和修订编辑;2) 模型训练:在Gemini模型上进行监督微调,目标是预测给定初始布局和语言提示下,人类设计师的修订编辑;3) 迭代生成:模型根据初始布局和语言提示生成修订编辑,然后将修订后的布局作为新的输入,进行下一轮迭代,直到满足停止条件。

关键创新:最重要的创新点在于将人类修订编辑作为一种显式的指导信号,用于训练生成模型。与传统的生成模型不同,该方法不仅仅依赖于数据分布的学习,而是直接学习人类的修改策略。此外,论文还发现,早期阶段的人类指导对于最终生成质量至关重要,这为未来的人机协作设计提供了重要的启示。

关键设计:论文的关键设计包括:1) 数据集的构建:高质量的专家数据集是模型训练的基础;2) 监督微调任务的设置:选择合适的损失函数和训练策略,以有效地学习人类的修订编辑;3) 迭代生成过程的控制:设计合理的停止条件和迭代策略,以保证生成过程的稳定性和效率。具体的参数设置和网络结构细节在论文中未详细说明,属于未知信息。

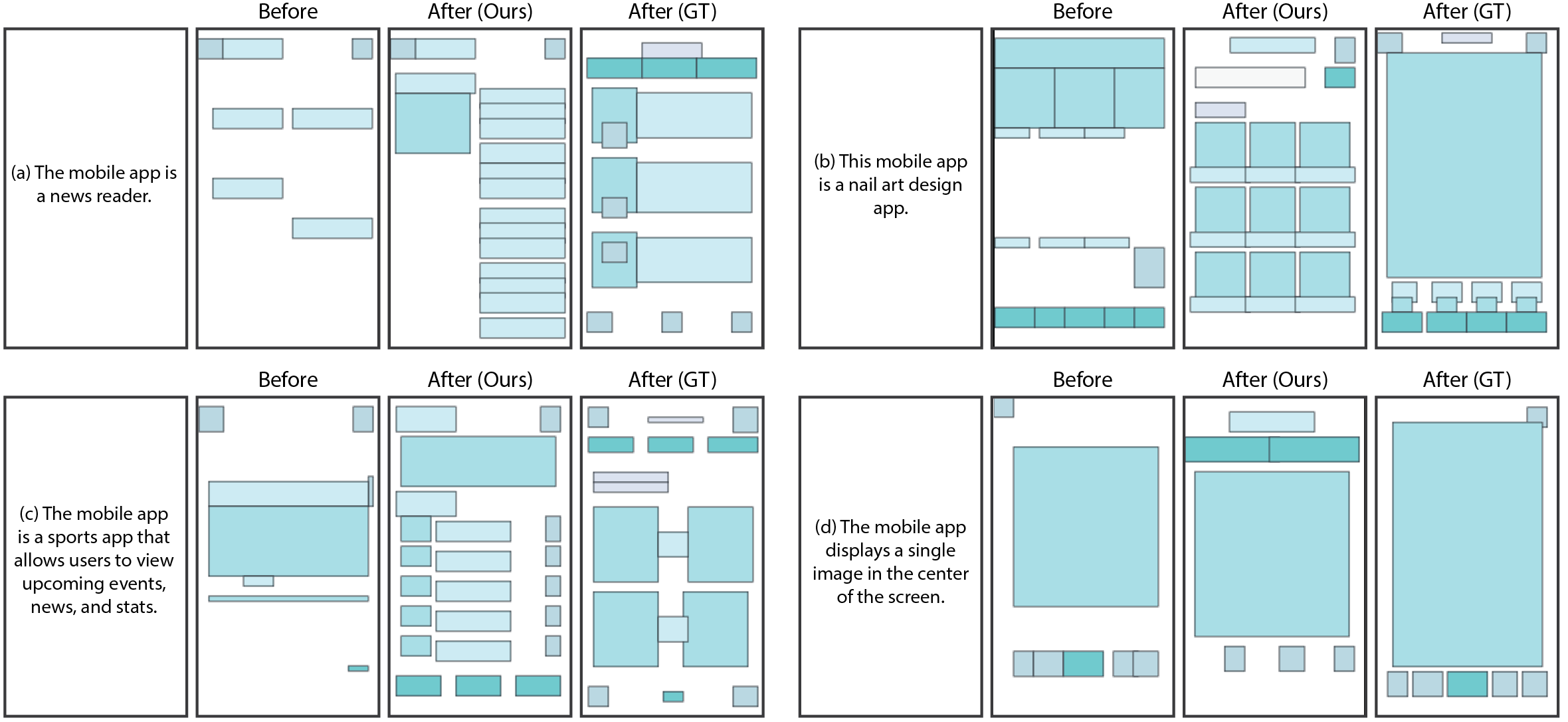

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于人类修订指导的模型在布局生成任务上取得了显著的性能提升,设计FID分数达到约10,接近人类水平(约6)。相比之下,完全依赖模型自身判断的自我修订方法性能较差,验证了人类指导的重要性。早期阶段的人类指导对于最终生成质量至关重要。

🎯 应用场景

该研究成果可应用于用户界面设计、图形布局设计等领域,帮助设计师快速生成高质量的布局方案。通过人机协作,可以显著提高设计效率和质量,降低设计成本。未来,该方法有望扩展到其他设计领域,如产品设计、建筑设计等。

📄 摘要(原文)

Layout design, such as user interface or graphical layout in general, is fundamentally an iterative revision process. Through revising a design repeatedly, the designer converges on an ideal layout. In this paper, we investigate how revision edits from human designer can benefit a multimodal generative model. To do so, we curate an expert dataset that traces how human designers iteratively edit and improve a layout generation with a prompted language goal. Based on such data, we explore various supervised fine-tuning task setups on top of a Gemini multimodal backbone, a large multimodal model. Our results show that human revision plays a critical role in iterative layout refinement. While being noisy, expert revision edits lead our model to a surprisingly strong design FID score ~10 which is close to human performance (~6). In contrast, self-revisions that fully rely on model's own judgement, lead to an echo chamber that prevents iterative improvement, and sometimes leads to generative degradation. Fortunately, we found that providing human guidance plays at early stage plays a critical role in final generation. In such human-in-the-loop scenario, our work paves the way for iterative design revision based on pre-trained large multimodal models.