Large Language Models for Explainable Decisions in Dynamic Digital Twins

作者: Nan Zhang, Christian Vergara-Marcillo, Georgios Diamantopoulos, Jingran Shen, Nikos Tziritas, Rami Bahsoon, Georgios Theodoropoulos

分类: cs.AI, eess.SY

发布日期: 2024-05-23 (更新: 2024-09-04)

备注: 9 pages, 3 figures, accepted by DDDAS2024 -- the 5th International Conference on Dynamic Data Driven Applications Systems

💡 一句话要点

利用大语言模型为动态数字孪生中的决策提供可解释性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 动态数字孪生 大型语言模型 可解释性 自然语言生成 智慧农业

📋 核心要点

- 自主决策的数字孪生系统缺乏透明度,理解其决策过程需要专业知识,这限制了其应用。

- 利用大型语言模型,结合领域知识库,为数字孪生系统的决策过程生成自然语言解释。

- 通过智慧农业案例研究,验证了该方法在提供决策解释方面的有效性,提升了系统的可信度。

📝 摘要(中文)

动态数据驱动的数字孪生(DDTs)能够支持知情决策,并为底层系统提供优化平台。通过利用动态数据驱动应用系统(DDDAS)的原则,DDTs可以构建用于反馈循环、模型更新和决策(包括自主决策)的计算模式。然而,理解自主决策通常需要技术和领域特定的知识。本文探讨了使用大型语言模型(LLMs)为DDTs提供可解释性平台,通过利用领域特定的知识库,生成系统决策的自然语言解释。文中展示了一个来自智慧农业的案例研究。

🔬 方法详解

问题定义:现有动态数字孪生(DDTs)在进行自主决策时,其决策过程往往难以理解,需要技术和领域专家才能解读。这导致用户难以信任和有效利用DDTs的决策结果,阻碍了DDTs的广泛应用。因此,如何为DDTs的决策提供可解释性是一个关键问题。

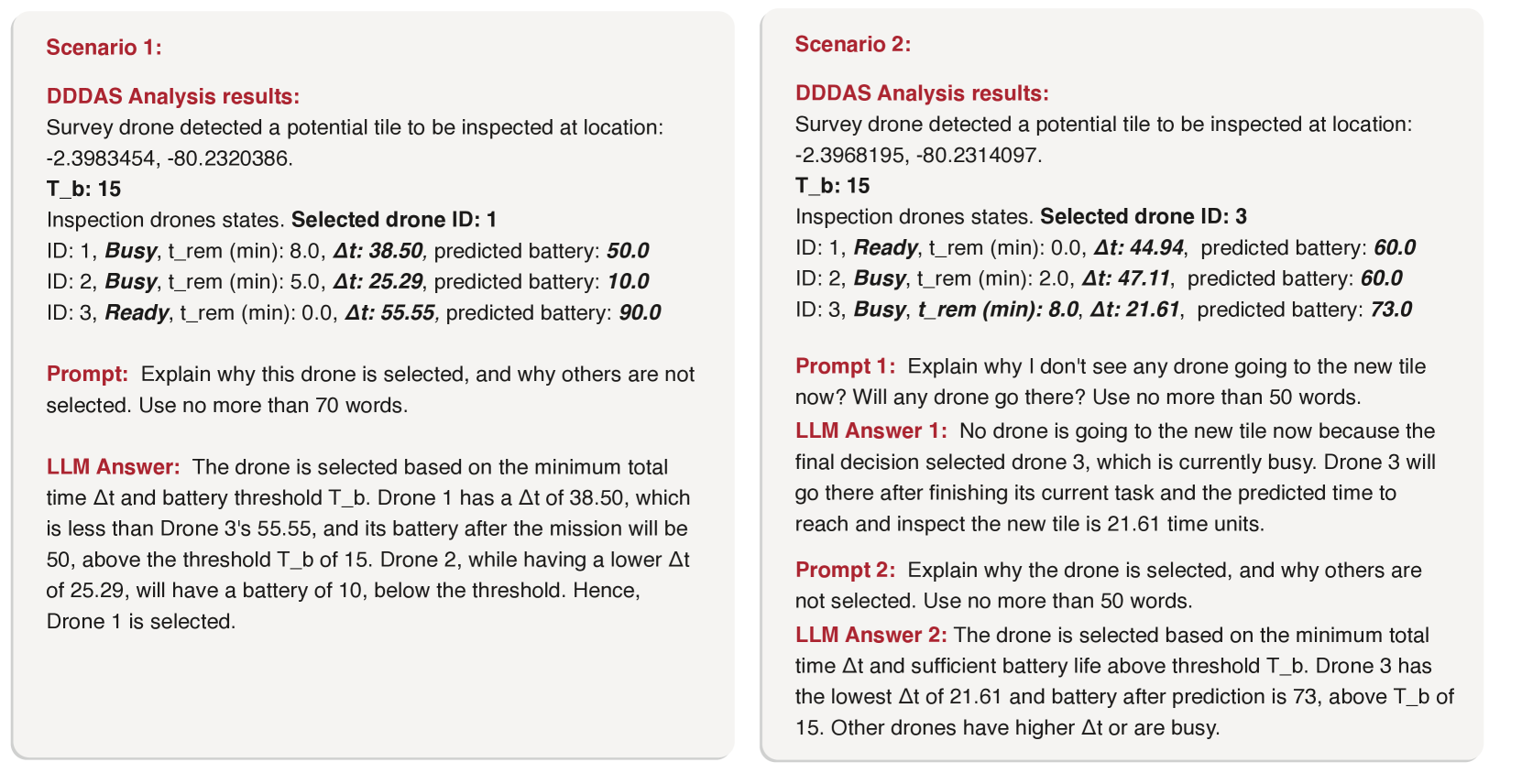

核心思路:本文的核心思路是利用大型语言模型(LLMs)的自然语言生成能力,将DDTs的决策过程转化为人类可理解的自然语言解释。通过结合领域特定的知识库,LLMs可以生成更准确、更具上下文相关性的解释,从而提高DDTs决策的透明度和可信度。

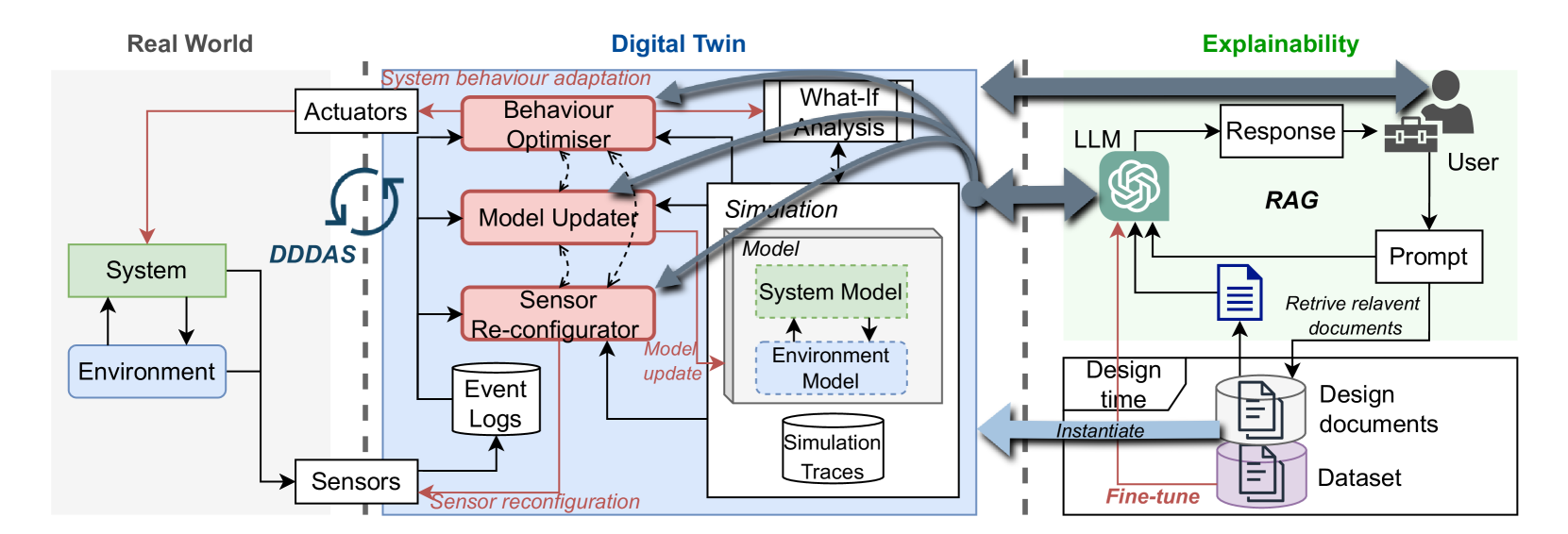

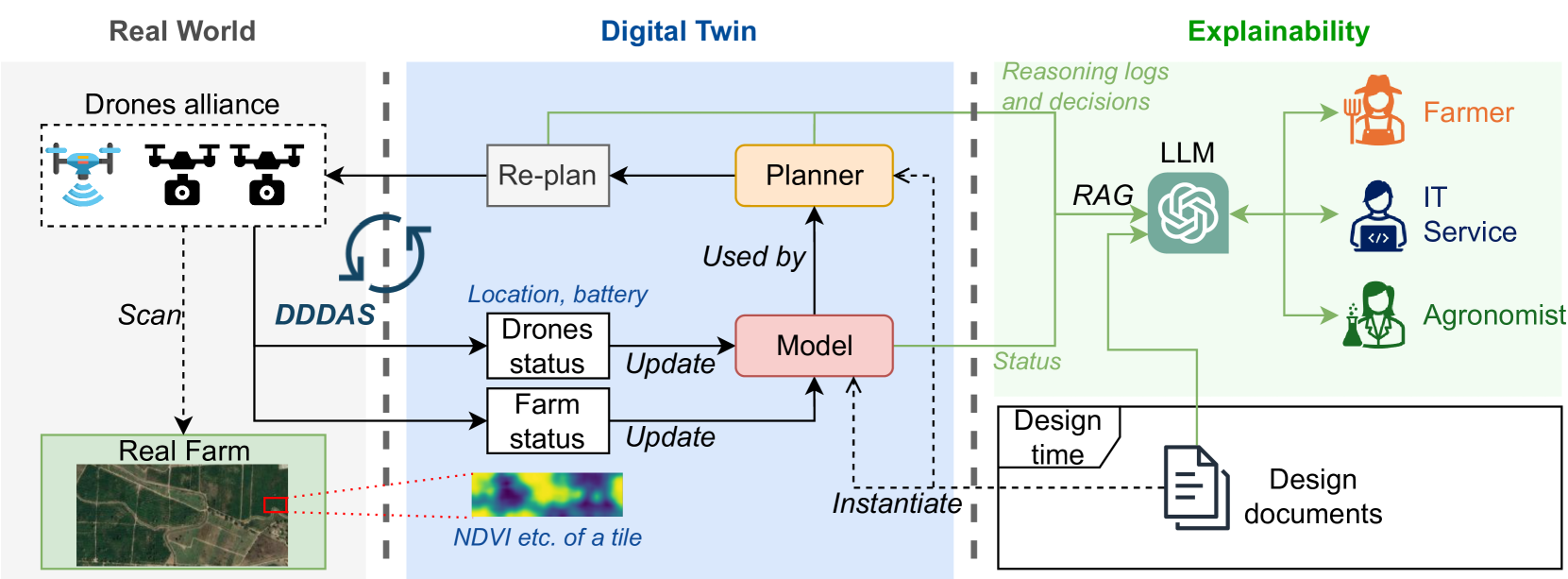

技术框架:该方法的技术框架主要包含三个部分:1) 动态数字孪生系统:负责收集数据、进行模型更新和做出决策;2) 领域知识库:存储领域相关的知识和规则,为LLMs提供背景信息;3) 大型语言模型:接收DDTs的决策过程和领域知识库的信息,生成自然语言解释。整个流程是DDTs做出决策后,将决策过程和相关数据传递给LLM,LLM结合知识库生成解释,最终将解释呈现给用户。

关键创新:该方法最重要的创新点在于将LLMs应用于DDTs的可解释性问题。与传统的解释方法(如决策树可视化)相比,LLMs可以生成更自然、更易于理解的解释,并且可以根据用户的需求进行定制。此外,结合领域知识库可以提高解释的准确性和相关性。

关键设计:论文中没有详细说明LLM的具体参数设置、损失函数或网络结构。关键设计在于如何有效地将DDTs的决策过程和领域知识库的信息输入到LLM中,以及如何评估生成的解释的质量。这可能涉及到特定的提示工程(prompt engineering)技术和评估指标。

🖼️ 关键图片

📊 实验亮点

该论文提出了使用大型语言模型为动态数字孪生提供可解释性的新思路,并通过智慧农业案例研究验证了其可行性。虽然论文没有提供具体的性能数据,但展示了LLMs在生成自然语言解释方面的潜力,为DDTs的可解释性研究开辟了新的方向。未来的研究可以进一步探索如何优化LLMs的提示工程,以及如何评估生成的解释的质量。

🎯 应用场景

该研究成果可广泛应用于需要可解释性决策的动态数字孪生系统,例如智能制造、智慧医疗、智能交通等领域。通过提供清晰的决策解释,可以提高用户对系统的信任度,促进人机协作,并最终提升系统的整体性能和效率。未来,该方法有望应用于更复杂的决策场景,并与其他可解释性技术相结合。

📄 摘要(原文)

Dynamic data-driven Digital Twins (DDTs) can enable informed decision-making and provide an optimisation platform for the underlying system. By leveraging principles of Dynamic Data-Driven Applications Systems (DDDAS), DDTs can formulate computational modalities for feedback loops, model updates and decision-making, including autonomous ones. However, understanding autonomous decision-making often requires technical and domain-specific knowledge. This paper explores using large language models (LLMs) to provide an explainability platform for DDTs, generating natural language explanations of the system's decision-making by leveraging domain-specific knowledge bases. A case study from smart agriculture is presented.