Panmodal Information Interaction

作者: Chirag Shah, Ryen W. White

分类: cs.IR, cs.AI, cs.HC

发布日期: 2024-05-21

💡 一句话要点

提出泛模态信息交互框架,旨在融合多种信息交互方式以提升用户体验。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 泛模态信息交互 多模态融合 信息检索 生成式AI 用户体验 人机交互

📋 核心要点

- 传统搜索引擎的信息交互方式单一,无法充分利用多种模态的优势,限制了用户体验。

- 提出泛模态信息交互框架,旨在融合传统搜索和AI聊天等多种模态,实现无缝切换和组合。

- 通过用户调研,分析了不同模态的优缺点,为泛模态信息交互系统的设计提供了依据。

📝 摘要(中文)

生成式人工智能(GenAI)的出现正在改变信息交互的方式。长期以来,Google和Bing等搜索引擎一直是大众获取相关信息的主要途径,它们以相同的标准格式(即“10个蓝色链接”)提供搜索结果。现在,通过自然语言与基于AI的代理进行聊天,并让GenAI自动实时合成答案(基于排名靠前的结果),正在大规模地改变人们与信息交互和消费信息的方式。这两种信息交互方式(传统搜索和AI驱动的聊天)共存于当前的搜索引擎中,要么松散耦合(例如,作为单独的选项/标签),要么紧密耦合(例如,集成为直接嵌入在传统搜索结果页面中的聊天答案)。我们认为,这两种不同方式的存在,以及潜在的更多方式,创造了一个重新构想搜索体验的机会,可以利用多种方式的优势,并开发系统和策略来支持它们之间的无缝流动。我们将这些称为泛模态体验。与仅有一种方式可用和/或用于手头任务的单模态体验不同,泛模态体验使多个方式可供用户使用(多模态),直接支持方式之间的转换(跨模态),并无缝地组合方式以定制任务辅助(转模态)。虽然我们的重点是搜索和聊天,并从对100多名最近在这些方式上执行常见任务的个人的调查中获得见解,但我们也提出了一个更通用的愿景,即使用多种方式和GenAI的新兴能力来实现未来的信息交互。

🔬 方法详解

问题定义:论文旨在解决传统搜索引擎信息交互方式单一的问题。现有搜索引擎主要依赖“10个蓝色链接”的模式,无法充分利用自然语言交互、生成式AI等新兴技术带来的优势。用户需要在不同模态之间手动切换,体验不流畅,效率低下。

核心思路:论文的核心思路是构建一个泛模态信息交互框架,将多种信息交互模态(如传统搜索、AI聊天)整合到一个统一的系统中。该框架支持用户在不同模态之间无缝切换,并能根据用户需求自动组合不同模态的优势,提供定制化的任务辅助。

技术框架:论文提出了一个泛模态信息交互的愿景,但并未提供具体的系统架构或流程图。根据描述,该框架应包含以下主要模块:1) 多模态信息输入模块,负责接收用户通过不同模态(如文本、语音)提出的信息需求;2) 模态转换模块,负责在不同模态之间进行转换,例如将文本查询转换为AI聊天的输入;3) 信息融合模块,负责将不同模态的信息进行融合,例如将传统搜索结果与AI聊天生成的答案进行整合;4) 用户界面模块,负责向用户呈现整合后的信息,并支持用户在不同模态之间进行切换。

关键创新:论文的关键创新在于提出了“泛模态信息交互”的概念,强调了多种信息交互模态的融合和无缝切换的重要性。与现有方法相比,该方法不再局限于单一的搜索模式,而是将多种模态整合到一个统一的框架中,从而能够更好地满足用户的多样化信息需求。

关键设计:论文主要侧重于概念的提出和愿景的描述,并未涉及具体的技术细节。未来的研究可以关注以下关键设计:1) 如何设计有效的模态转换算法,实现不同模态之间的无缝切换;2) 如何设计信息融合算法,将不同模态的信息进行有效整合;3) 如何设计用户界面,支持用户在不同模态之间进行流畅的交互。

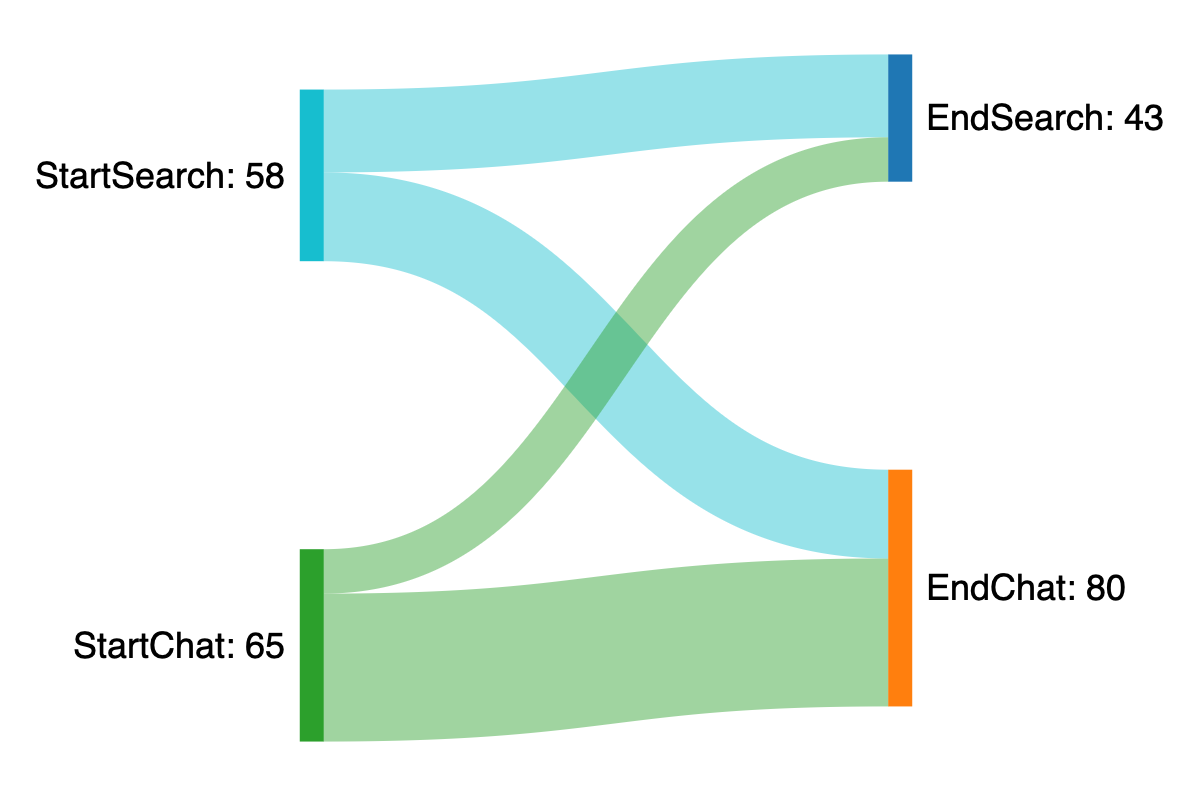

🖼️ 关键图片

📊 实验亮点

论文通过对100多名用户的调研,分析了传统搜索和AI聊天两种模态的优缺点,为泛模态信息交互系统的设计提供了重要的参考依据。虽然论文没有提供具体的实验结果,但用户调研的结果表明,用户对于融合多种模态的信息交互方式具有较高的需求。

🎯 应用场景

该研究的潜在应用领域包括智能助手、在线教育、客户服务等。通过融合多种信息交互模态,可以为用户提供更加个性化、高效的信息服务。例如,在智能助手中,用户可以通过语音提出问题,系统可以结合传统搜索结果和AI聊天生成的答案,以语音或文本的形式进行回复。在在线教育中,学生可以通过文本提问,系统可以结合课程资料和AI辅导,提供个性化的学习指导。未来,泛模态信息交互有望成为信息服务的重要发展方向。

📄 摘要(原文)

The emergence of generative artificial intelligence (GenAI) is transforming information interaction. For decades, search engines such as Google and Bing have been the primary means of locating relevant information for the general population. They have provided search results in the same standard format (the so-called "10 blue links"). The recent ability to chat via natural language with AI-based agents and have GenAI automatically synthesize answers in real-time (grounded in top-ranked results) is changing how people interact with and consume information at massive scale. These two information interaction modalities (traditional search and AI-powered chat) coexist in current search engines, either loosely coupled (e.g., as separate options/tabs) or tightly coupled (e.g., integrated as a chat answer embedded directly within a traditional search result page). We believe that the existence of these two different modalities, and potentially many others, is creating an opportunity to re-imagine the search experience, capitalize on the strengths of many modalities, and develop systems and strategies to support seamless flow between them. We refer to these as panmodal experiences. Unlike monomodal experiences, where only one modality is available and/or used for the task at hand, panmodal experiences make multiple modalities available to users (multimodal), directly support transitions between modalities (crossmodal), and seamlessly combine modalities to tailor task assistance (transmodal). While our focus is search and chat, with learnings from insights from a survey of over 100 individuals who have recently performed common tasks on these two modalities, we also present a more general vision for the future of information interaction using multiple modalities and the emergent capabilities of GenAI.