Can Github issues be solved with Tree Of Thoughts?

作者: Ricardo La Rosa, Corey Hulse, Bangdi Liu

分类: cs.SE, cs.AI

发布日期: 2024-05-20

备注: 8 pages, 2 figures, 7 tables

💡 一句话要点

探索思维树(ToT)框架在解决GitHub问题中的应用,分析其局限性与改进方向

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维树 大型语言模型 代码生成 GitHub问题 软件工程 问题解决 推理能力

📋 核心要点

- 现有代码生成基准侧重于函数级代码,缺乏对解决GitHub问题等实际场景所需批判性思维的考察。

- 论文探索使用思维树(ToT)框架,旨在通过多路径推理和自我评估来增强LLM的问题解决能力。

- 实验结果表明,单独使用ToT框架无法超越现有方法,论文分析了原因并提出了改进方向。

📝 摘要(中文)

本文研究将思维树(ToT)语言模型推理框架应用于解决GitHub问题,旨在提升大型语言模型(LLM)在此复杂任务中的决策和问题解决能力。尽管LLM在代码生成方面取得了显著进展,但在解决需要批判性思维和范围概念的实际问题(如GitHub问题)时仍面临挑战。ToT通过结构化地探索多个推理路径并进行自我评估,有望优于传统的输入-输出(IO)提示和检索增强生成(RAG)技术。然而,实验结果表明,仅靠ToT框架不足以赋予LLM超越现有方法的关键推理能力。本文分析了这些不足的潜在原因,并确定了改进的关键领域,例如深化思考过程和引入代理能力。研究旨在为改进ToT的应用和更好地利用LLM在实际问题解决中的潜力提供参考。

🔬 方法详解

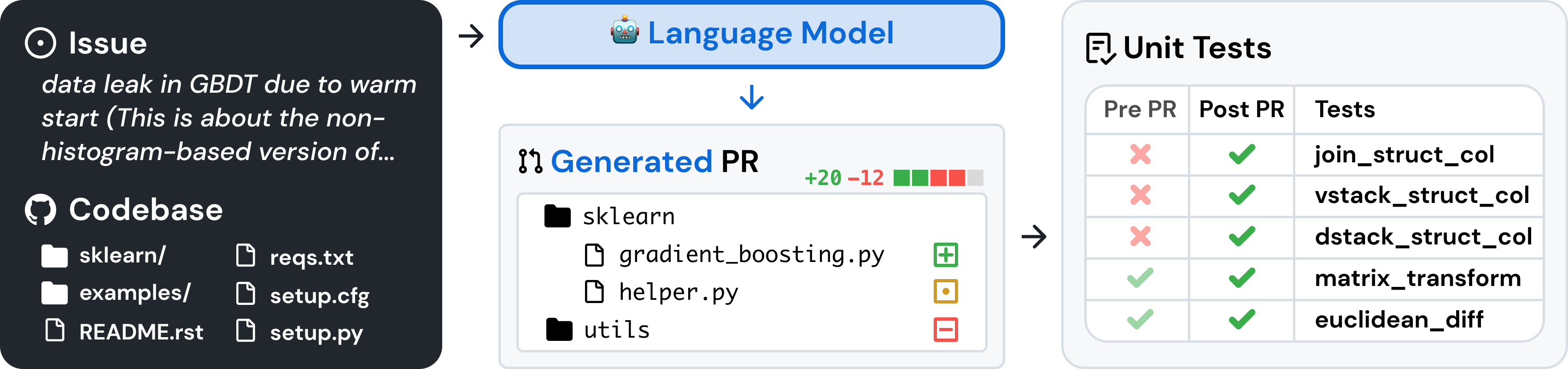

问题定义:论文旨在解决大型语言模型(LLM)在解决复杂、真实的软件工程问题(例如GitHub issue)时推理能力不足的问题。现有方法,如简单的输入-输出提示或检索增强生成(RAG),无法充分利用LLM的推理潜力,难以处理需要多步骤推理和全局视野的任务。

核心思路:论文的核心思路是将思维树(Tree of Thoughts, ToT)框架应用于GitHub issue的解决。ToT允许模型探索多个可能的推理路径,并在每个步骤进行自我评估,从而更有效地找到解决方案。这种方法旨在模拟人类解决复杂问题时的思考过程,避免陷入局部最优解。

技术框架:整体框架包含以下几个主要阶段:1) 问题分解:将GitHub issue分解为更小的、可管理的子问题;2) 思维生成:为每个子问题生成多个可能的解决方案(即“思维”);3) 思维评估:评估每个思维的质量和可行性;4) 状态更新:根据评估结果,选择最有希望的思维路径,并更新当前状态;5) 搜索:重复上述步骤,直到找到最终解决方案或达到预设的搜索深度。

关键创新:最重要的技术创新在于将ToT框架应用于软件工程问题解决。与传统的线性推理方法相比,ToT能够探索更广阔的解空间,并利用自我评估机制来指导搜索过程。这使得模型能够更好地处理复杂、不确定的问题,并找到更优的解决方案。

关键设计:论文中,思维的生成和评估依赖于大型语言模型。具体的参数设置和损失函数没有明确给出,但可以推测,思维的生成可能使用了某种形式的条件生成模型,而思维的评估可能使用了基于奖励或置信度的评分机制。此外,搜索算法的选择(例如,深度优先搜索、广度优先搜索或A*搜索)也会影响最终的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,单独使用ToT框架并不能显著超越现有的输入-输出提示或RAG方法。这表明,ToT框架本身可能存在局限性,例如需要更深层次的思考过程和更强的代理能力。论文分析了这些局限性,并为未来的研究方向提供了有价值的见解。

🎯 应用场景

该研究的潜在应用领域包括自动化软件缺陷修复、智能代码审查、以及更广泛的复杂问题解决场景。通过提升LLM的推理能力,可以显著提高软件开发的效率和质量。未来,该技术有望应用于智能助手、自动化决策系统等领域,赋能机器更强的解决实际问题的能力。

📄 摘要(原文)

While there have been extensive studies in code generation by large language models (LLM), where benchmarks like HumanEval have been surpassed with an impressive 96.3% success rate, these benchmarks predominantly judge a model's performance on basic function-level code generation and lack the critical thinking and concept of scope required of real-world scenarios such as solving GitHub issues. This research introduces the application of the Tree of Thoughts (ToT) language model reasoning framework for enhancing the decision-making and problem-solving abilities of LLMs for this complex task. Compared to traditional input-output (IO) prompting and Retrieval Augmented Generation (RAG) techniques, ToT is designed to improve performance by facilitating a structured exploration of multiple reasoning trajectories and enabling self-assessment of potential solutions. We experimentally deploy ToT in tackling a Github issue contained within an instance of the SWE-bench. However, our results reveal that the ToT framework alone is not enough to give LLMs the critical reasoning capabilities to outperform existing methods. In this paper we analyze the potential causes of these shortcomings and identify key areas for improvement such as deepening the thought process and introducing agentic capabilities. The insights of this research are aimed at informing future directions for refining the application of ToT and better harnessing the potential of LLMs in real-world problem-solving scenarios.