PromptLink: Leveraging Large Language Models for Cross-Source Biomedical Concept Linking

作者: Yuzhang Xie, Jiaying Lu, Joyce Ho, Fadi Nahab, Xiao Hu, Carl Yang

分类: cs.IR, cs.AI, cs.CL

发布日期: 2024-05-13

期刊: Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval (Short-Paper Track), 2024

🔗 代码/项目: GITHUB

💡 一句话要点

PromptLink:利用大型语言模型进行跨源生物医学概念链接

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生物医学概念链接 大型语言模型 提示学习 零样本学习 自然语言处理 电子病历 知识图谱

📋 核心要点

- 现有生物医学概念链接方法依赖有限的先验知识,泛化能力不足,难以应对命名规范差异。

- PromptLink利用生物医学预训练语言模型生成候选概念,并通过两阶段提示引导LLM进行概念链接。

- 实验表明,PromptLink在EHR数据集和生物医学知识图谱上的概念链接任务中表现出有效性。

📝 摘要(中文)

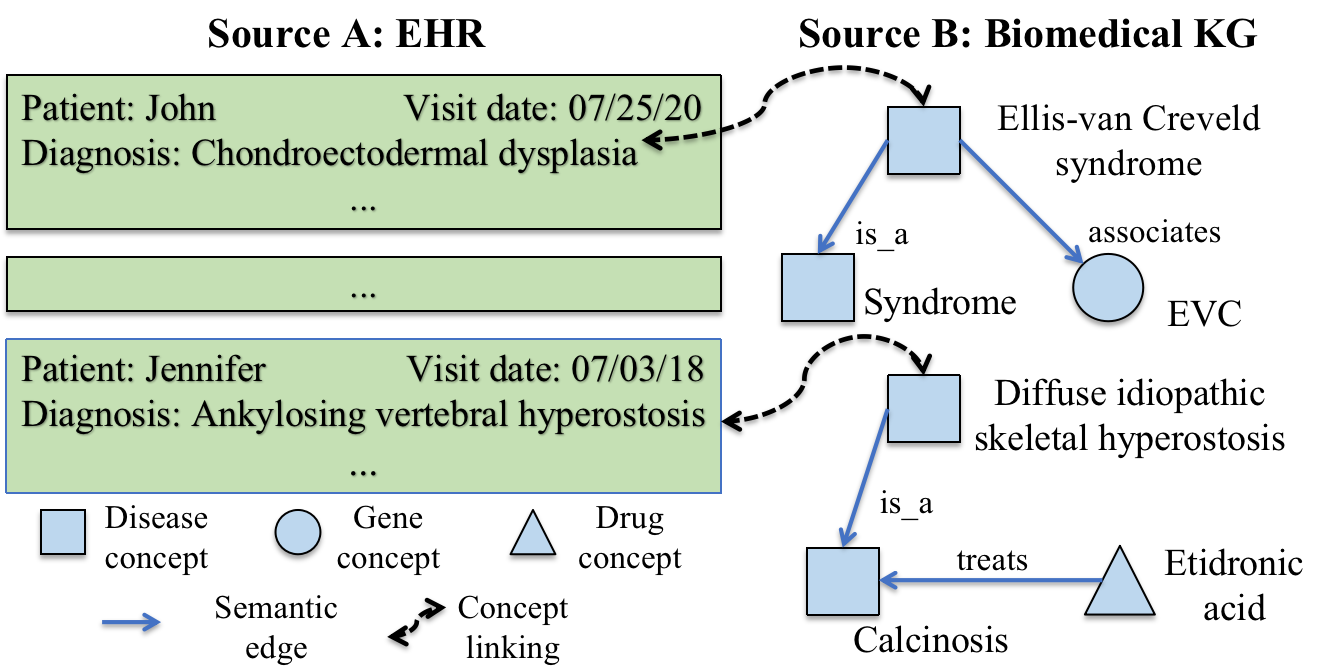

跨越不同数据源链接(对齐)生物医学概念能够实现各种整合分析,但由于概念命名规范的差异,这项任务极具挑战性。目前已开发出多种策略来克服这一挑战,例如基于字符串匹配规则、手动构建的词库和机器学习模型的方法。然而,这些方法受到有限的先验生物医学知识的约束,并且很难推广到有限的规则、词库或训练样本之外。最近,大型语言模型(LLM)凭借其前所未有的丰富先验知识和强大的零样本预测能力,在各种生物医学自然语言处理任务中表现出令人印象深刻的结果。然而,LLM也存在成本高、上下文长度有限和预测不可靠等问题。在本研究中,我们提出了一种新颖的生物医学概念链接框架PromptLink,该框架利用LLM。它首先采用生物医学专业预训练语言模型生成可以适应LLM上下文窗口的候选概念。然后,它利用LLM通过两阶段提示来链接概念,其中第一阶段提示旨在从LLM中提取用于概念链接任务的生物医学先验知识,第二阶段提示强制LLM反思其自身的预测,以进一步提高其可靠性。在两个EHR数据集和一个外部生物医学知识图谱之间的概念链接任务上的实验结果证明了PromptLink的有效性。此外,PromptLink是一个通用框架,不依赖于额外的先验知识、上下文或训练数据,使其非常适合跨各种类型的数据源进行概念链接。源代码可在https://github.com/constantjxyz/PromptLink获取。

🔬 方法详解

问题定义:论文旨在解决跨不同生物医学数据源(如EHR数据集和知识图谱)中概念链接的问题。现有方法,如基于字符串匹配、人工构建词库或传统机器学习模型,受限于领域知识的覆盖范围和泛化能力,难以有效处理命名规范的差异性。

核心思路:论文的核心思路是利用大型语言模型(LLM)蕴含的丰富生物医学知识,通过精心设计的提示(Prompt)来引导LLM进行概念链接。同时,为了解决LLM上下文长度限制和预测可靠性问题,采用了两阶段提示策略。

技术框架:PromptLink框架包含以下主要阶段:1) 候选概念生成:使用生物医学领域预训练语言模型(如BioBERT)生成候选概念,确保候选概念能够适应LLM的上下文窗口。2) 两阶段提示链接:第一阶段提示(Knowledge Elicitation Prompt)旨在从LLM中提取生物医学先验知识,用于概念链接任务;第二阶段提示(Reflection Prompt)强制LLM反思其自身的预测,以提高预测的可靠性。

关键创新:PromptLink的关键创新在于:1) 提出了一个通用的、不依赖额外知识库或训练数据的概念链接框架。2) 设计了两阶段提示策略,有效利用LLM的先验知识并提高预测可靠性。3) 结合了领域预训练语言模型和LLM的优势,克服了LLM上下文长度的限制。

关键设计:具体提示的设计是关键。第一阶段提示可能包含目标概念的定义、相关背景知识等,以引导LLM回忆相关信息。第二阶段提示则可能包含对LLM预测结果的质疑,促使其重新评估并给出更可靠的答案。论文中具体提示的模板和内容(例如使用的自然语言指令、示例等)是影响最终效果的重要因素,但具体细节在摘要中未提及。

🖼️ 关键图片

📊 实验亮点

论文在两个EHR数据集和一个外部生物医学知识图谱上进行了实验,验证了PromptLink的有效性。由于摘要中没有给出具体的性能指标和提升幅度,因此无法量化PromptLink的性能优势。但论文强调PromptLink是一个通用框架,无需额外训练数据,这使其在实际应用中具有很大的优势。

🎯 应用场景

PromptLink可应用于多种生物医学领域,例如电子病历数据整合、药物研发、基因组学研究等。通过自动链接不同数据源中的生物医学概念,可以促进数据共享和知识发现,加速科研进展,并最终改善医疗服务。

📄 摘要(原文)

Linking (aligning) biomedical concepts across diverse data sources enables various integrative analyses, but it is challenging due to the discrepancies in concept naming conventions. Various strategies have been developed to overcome this challenge, such as those based on string-matching rules, manually crafted thesauri, and machine learning models. However, these methods are constrained by limited prior biomedical knowledge and can hardly generalize beyond the limited amounts of rules, thesauri, or training samples. Recently, large language models (LLMs) have exhibited impressive results in diverse biomedical NLP tasks due to their unprecedentedly rich prior knowledge and strong zero-shot prediction abilities. However, LLMs suffer from issues including high costs, limited context length, and unreliable predictions. In this research, we propose PromptLink, a novel biomedical concept linking framework that leverages LLMs. It first employs a biomedical-specialized pre-trained language model to generate candidate concepts that can fit in the LLM context windows. Then it utilizes an LLM to link concepts through two-stage prompts, where the first-stage prompt aims to elicit the biomedical prior knowledge from the LLM for the concept linking task and the second-stage prompt enforces the LLM to reflect on its own predictions to further enhance their reliability. Empirical results on the concept linking task between two EHR datasets and an external biomedical KG demonstrate the effectiveness of PromptLink. Furthermore, PromptLink is a generic framework without reliance on additional prior knowledge, context, or training data, making it well-suited for concept linking across various types of data sources. The source code is available at https://github.com/constantjxyz/PromptLink.