Prompt-guided Precise Audio Editing with Diffusion Models

作者: Manjie Xu, Chenxing Li, Duzhen zhang, Dan Su, Wei Liang, Dong Yu

分类: cs.SD, cs.AI, cs.LG, eess.AS

发布日期: 2024-05-11

备注: Accepted by ICML 2024

💡 一句话要点

提出PPAE模块,通过扩散模型实现基于文本提示的精确音频编辑

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 音频编辑 扩散模型 文本引导 交叉注意力 局部编辑

📋 核心要点

- 现有文本引导的音频生成模型难以精确控制音频编辑,尤其是在定位和修改特定事件方面。

- PPAE模块利用扩散模型的交叉注意力图,实现基于文本提示的局部编辑,无需额外训练。

- 实验结果表明,PPAE在各种音频编辑任务中表现出色,验证了其有效性和通用性。

📝 摘要(中文)

音频编辑涉及通过精确控制对音频内容进行任意操作。尽管文本引导的扩散模型在文本到音频生成方面取得了显著进展,但在音频轨道中灵活且精确地修改目标事件仍然面临挑战。我们提出了一种名为PPAE的新方法,它作为扩散模型的通用模块,能够实现精确的音频编辑。编辑仅基于输入的文本提示,并且完全无需训练。我们利用扩散模型的交叉注意力图来实现精确的局部编辑,并采用分层局部-全局流水线来确保更平滑的编辑过程。实验结果突出了我们的方法在各种编辑任务中的有效性。

🔬 方法详解

问题定义:论文旨在解决音频编辑中,利用文本提示精确控制和修改音频内容的问题。现有方法,特别是基于扩散模型的文本到音频生成方法,在精确控制音频编辑的位置和内容方面存在局限性,难以灵活地修改音频中的特定事件。

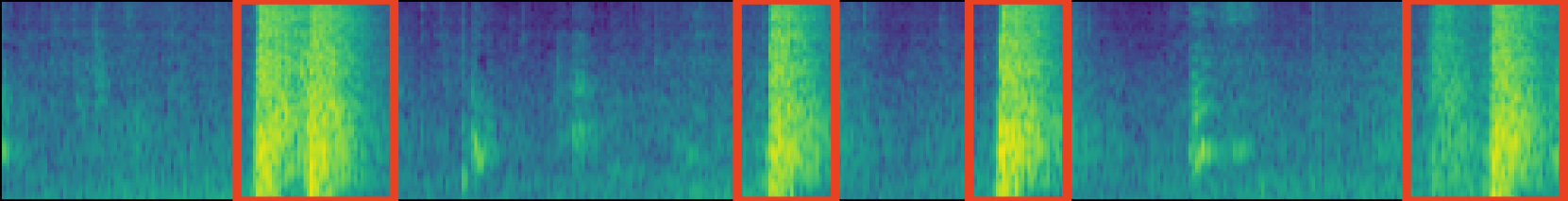

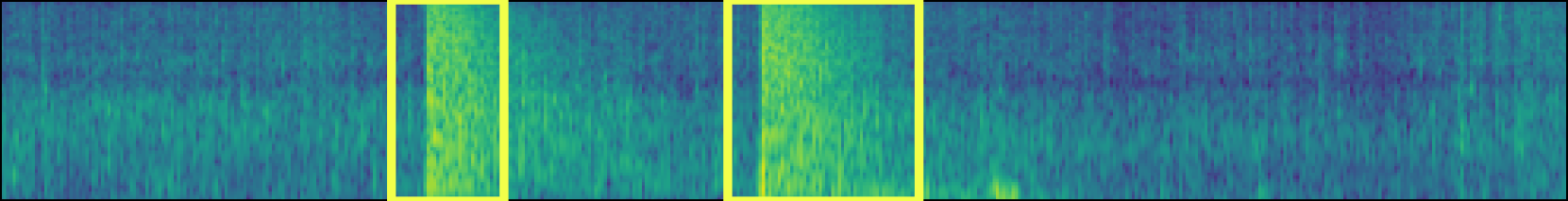

核心思路:论文的核心思路是利用扩散模型的交叉注意力机制,将文本提示与音频特征关联起来,从而实现对音频的局部编辑。通过分析交叉注意力图,可以确定文本提示所对应的音频区域,并对该区域进行精确修改。这种方法无需额外的训练,具有很强的灵活性和可控性。

技术框架:PPAE (Prompt-guided Precise Audio Editing) 模块主要包含以下几个阶段:1) 利用文本提示和音频输入,通过扩散模型生成音频;2) 分析扩散模型的交叉注意力图,确定文本提示对应的音频区域;3) 对确定的音频区域进行局部编辑;4) 采用分层局部-全局流水线,对编辑后的音频进行平滑处理,确保编辑的自然性。

关键创新:该论文的关键创新在于利用扩散模型的交叉注意力图来实现精确的局部音频编辑。与现有方法相比,PPAE无需额外的训练,可以直接应用于现有的扩散模型,具有很强的通用性和灵活性。此外,分层局部-全局流水线的设计,保证了编辑过程的平滑性,避免了局部编辑带来的不连续性。

关键设计:PPAE的关键设计包括:1) 交叉注意力图的分析方法,用于确定文本提示对应的音频区域;2) 局部编辑的具体策略,例如,可以采用替换、修改或删除等操作;3) 分层局部-全局流水线的具体实现,例如,可以采用平滑滤波器或插值方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PPAE在各种音频编辑任务中表现出色,能够精确地修改音频中的特定事件,并保持音频的整体质量。与现有方法相比,PPAE在编辑精度和效率方面均有显著提升。具体性能数据未知,但论文强调了其在各种编辑任务中的有效性。

🎯 应用场景

该研究成果可广泛应用于音频内容创作、音频修复、语音增强等领域。例如,可以用于电影配音的后期处理,广告音乐的编辑,以及语音助手的个性化定制。该技术有望提升音频编辑的效率和精度,为音频内容创作带来更大的灵活性和创造性。

📄 摘要(原文)

Audio editing involves the arbitrary manipulation of audio content through precise control. Although text-guided diffusion models have made significant advancements in text-to-audio generation, they still face challenges in finding a flexible and precise way to modify target events within an audio track. We present a novel approach, referred to as PPAE, which serves as a general module for diffusion models and enables precise audio editing. The editing is based on the input textual prompt only and is entirely training-free. We exploit the cross-attention maps of diffusion models to facilitate accurate local editing and employ a hierarchical local-global pipeline to ensure a smoother editing process. Experimental results highlight the effectiveness of our method in various editing tasks.