A First Step in Using Machine Learning Methods to Enhance Interaction Analysis for Embodied Learning Environments

作者: Joyce Fonteles, Eduardo Davalos, Ashwin T. S., Yike Zhang, Mengxi Zhou, Efrat Ayalon, Alicia Lane, Selena Steinberg, Gabriella Anton, Joshua Danish, Noel Enyedy, Gautam Biswas

分类: cs.AI

发布日期: 2024-05-10

💡 一句话要点

利用机器学习增强具身学习环境中交互分析,辅助研究者理解学生学习行为

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身学习 交互分析 机器学习 多模态学习分析 混合现实 教育 行为分析

📋 核心要点

- 现有交互分析方法依赖人工观察视频,耗时且效率低,难以快速理解学生的学习模式。

- 该研究提出利用机器学习和多模态分析,自动提取学生在具身学习环境中的行为特征,辅助交互分析。

- 通过案例研究,验证了在时间轴上可视化学生状态、动作、视线等信息的可行性,为后续研究奠定基础。

📝 摘要(中文)

本研究旨在通过机器学习和多模态学习分析,简化研究人员在混合现实环境中分析儿童具身学习的任务。该环境模拟科学过程,学生协作学习,需要分析复杂的多模态数据以理解他们的学习和协调行为。学习科学家已经开发了交互分析(IA)方法来分析这些数据,但这需要研究人员花费大量时间观看视频,提取和解释学生的学习模式。本研究结合机器学习算法和多模态分析,通过模拟场景中学生的动作、视线和情感反应,支持和简化研究人员全面理解学生科学参与度的过程。为了促进有效的人工智能合作,我们提出了一个初步的案例研究,以确定在时间轴上直观地表示学生的状态、动作、视线、情感和运动的可行性。我们的案例研究侧重于学生学习光合作用的特定科学场景。时间轴使我们能够研究多模态和交互分析识别的关键学习时刻的对齐情况,并揭示学生的时间学习进展。

🔬 方法详解

问题定义:现有交互分析(IA)方法在分析具身学习环境中学生的多模态数据时,主要依赖研究人员手动观看和标注视频,耗时且主观性强。难以高效地从学生的动作、视线、情感等信息中提取有意义的学习模式,阻碍了对学生学习过程的深入理解。

核心思路:该研究的核心思路是利用机器学习技术自动化地分析学生在具身学习环境中的多模态数据,从而辅助研究人员进行交互分析。通过机器学习模型提取学生的行为特征,并将其可视化,帮助研究人员更快速、更客观地理解学生的学习状态和学习过程。

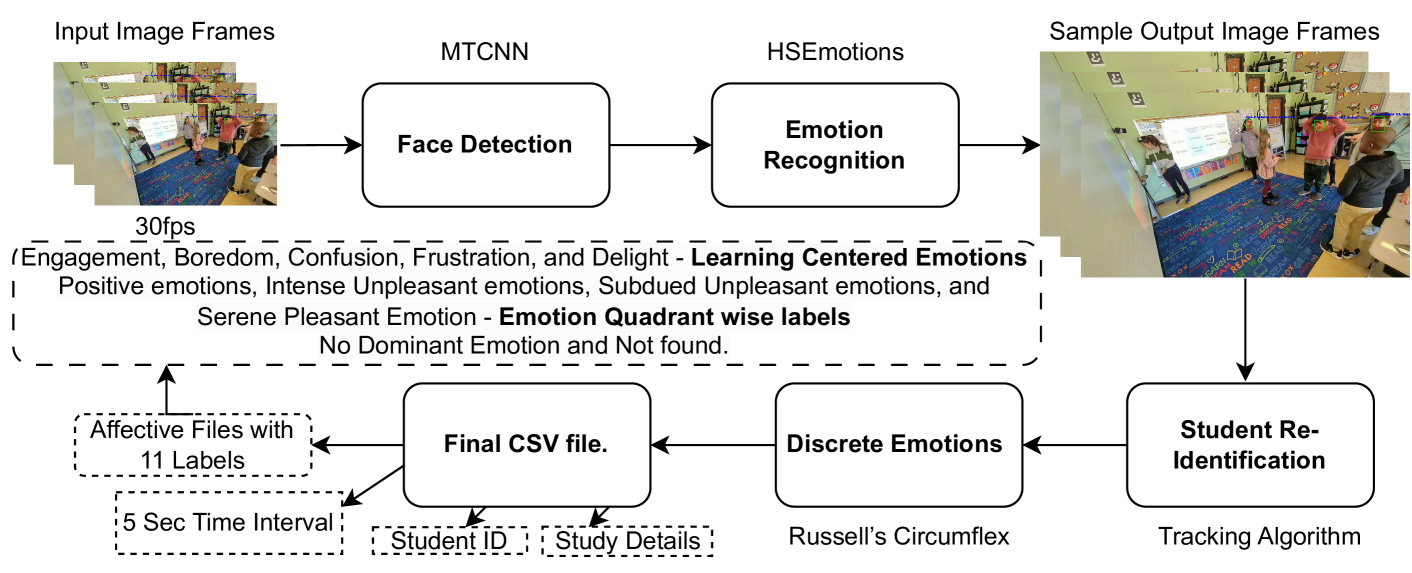

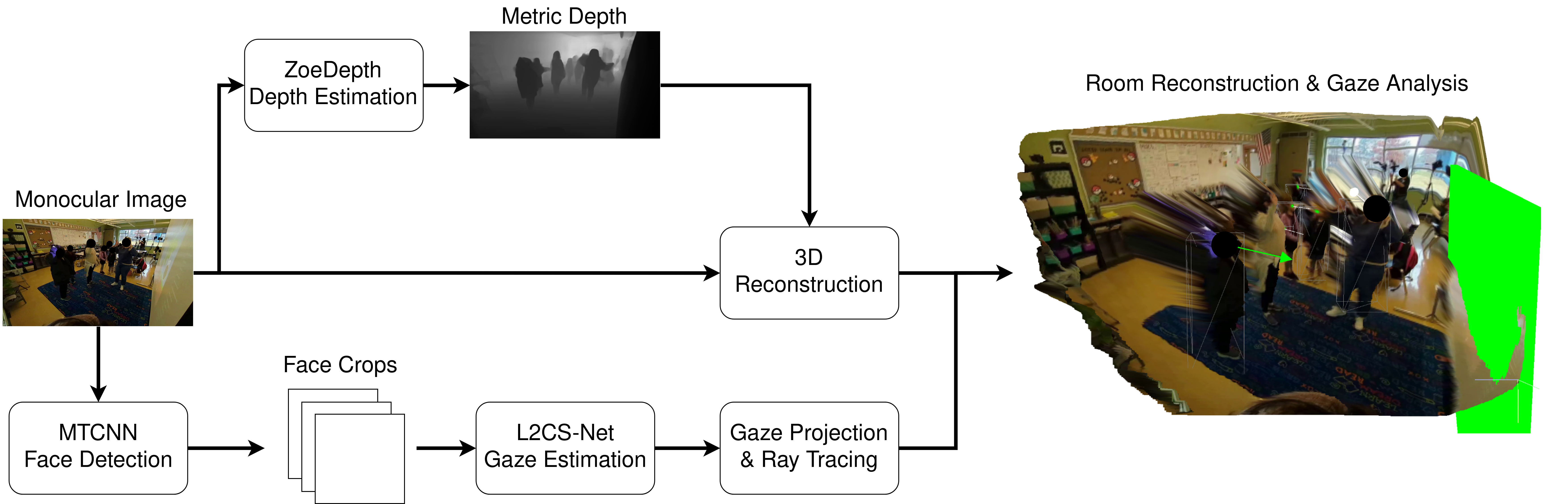

技术框架:该研究的技术框架主要包括数据采集、特征提取、机器学习模型训练和结果可视化四个阶段。首先,采集学生在具身学习环境中的多模态数据,包括动作、视线、情感等。然后,利用机器学习算法从这些数据中提取特征。接着,训练机器学习模型,用于识别学生的学习状态和行为模式。最后,将模型预测结果以时间轴的形式可视化,方便研究人员进行分析。

关键创新:该研究的关键创新在于将机器学习技术应用于具身学习环境中的交互分析,实现了对学生学习行为的自动化分析。与传统的人工分析方法相比,该方法能够更快速、更客观地提取学生的学习特征,并为研究人员提供更全面的学习过程信息。

关键设计:该研究的关键设计包括:1) 选择合适的机器学习算法,例如分类、聚类等,用于识别学生的学习状态和行为模式;2) 设计有效的数据可视化方法,例如时间轴,用于展示学生的学习过程;3) 针对特定的学习场景,例如光合作用,设计相应的特征提取方法。

🖼️ 关键图片

📊 实验亮点

该研究通过案例研究,验证了利用机器学习和多模态分析辅助交互分析的可行性。通过时间轴可视化,研究人员可以更直观地观察学生在学习过程中的状态变化和行为模式。虽然论文没有给出具体的性能数据,但展示了机器学习在简化交互分析流程、提高分析效率方面的潜力,为后续研究奠定了基础。

🎯 应用场景

该研究成果可应用于各类具身学习环境,例如虚拟现实、增强现实等,辅助教育研究者和教师更深入地了解学生的学习过程和学习效果。通过自动化分析学生的行为数据,可以为个性化学习提供支持,并改进教学设计,提升学生的学习体验和学习成果。未来,该方法还可扩展到其他领域,例如人机交互、行为分析等。

📄 摘要(原文)

Investigating children's embodied learning in mixed-reality environments, where they collaboratively simulate scientific processes, requires analyzing complex multimodal data to interpret their learning and coordination behaviors. Learning scientists have developed Interaction Analysis (IA) methodologies for analyzing such data, but this requires researchers to watch hours of videos to extract and interpret students' learning patterns. Our study aims to simplify researchers' tasks, using Machine Learning and Multimodal Learning Analytics to support the IA processes. Our study combines machine learning algorithms and multimodal analyses to support and streamline researcher efforts in developing a comprehensive understanding of students' scientific engagement through their movements, gaze, and affective responses in a simulated scenario. To facilitate an effective researcher-AI partnership, we present an initial case study to determine the feasibility of visually representing students' states, actions, gaze, affect, and movement on a timeline. Our case study focuses on a specific science scenario where students learn about photosynthesis. The timeline allows us to investigate the alignment of critical learning moments identified by multimodal and interaction analysis, and uncover insights into students' temporal learning progressions.