ERATTA: Extreme RAG for Table To Answers with Large Language Models

作者: Sohini Roychowdhury, Marko Krema, Anvar Mahammad, Brian Moore, Arijit Mukherjee, Punit Prakashchandra

分类: cs.AI, cs.LG

发布日期: 2024-05-07 (更新: 2024-11-17)

备注: 5 pages, 4 tables, IEEE Big Data, 2024

💡 一句话要点

提出ERATTA,一种基于多LLM的极端RAG框架,用于企业级数据表问答,提升效率和准确性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: RAG 大型语言模型 企业数据 问答系统 多LLM 幻觉检测 数据认证

📋 核心要点

- 现有的RAG方法在企业级数据实践中面临成本不稳定和性能不可靠的问题,且通用性与领域特定性之间存在矛盾。

- ERATTA通过调用多个LLM,实现数据认证、查询路由、数据检索和定制提示,从而提升问答能力。

- 该系统在多个领域的数据表问答中表现出高置信度,并能有效检测LLM的幻觉问题。

📝 摘要(中文)

本文提出了一种基于大型语言模型(LLM)的独特系统ERATTA,该系统利用多个LLM来实现数据认证、用户查询路由、数据检索和自定义提示,从而实现企业数据表的问答功能。针对高度波动且大型的源数据表,该框架能够在10秒内提供结构化响应。此外,还提出了一个包含五个指标的评分模块,用于检测和报告LLM响应中的幻觉。在可持续性、财务健康和社交媒体领域,该系统和评分指标在数百个用户查询中实现了超过90%的置信度。该极端RAG架构的扩展可以实现使用LLM进行异构源查询。

🔬 方法详解

问题定义:论文旨在解决企业级数据表中,利用LLM进行问答时,RAG方法面临的成本高、性能不稳定、领域泛化性差等问题。现有方法难以同时保证效率、准确性和可扩展性,并且容易产生幻觉。

核心思路:论文的核心思路是构建一个多LLM协同工作的RAG框架,通过不同的LLM分别负责数据认证、查询路由、数据检索和提示工程,从而实现更高效、更准确的问答。这种设计旨在利用不同LLM的优势,降低单个LLM的压力,并提高系统的鲁棒性。

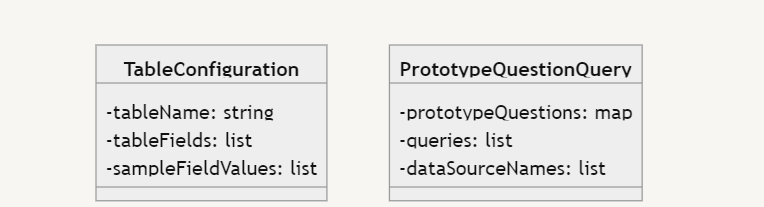

技术框架:ERATTA框架包含以下主要模块:1) 数据认证模块:验证数据来源和完整性;2) 查询路由模块:根据用户查询的意图,选择合适的LLM进行处理;3) 数据检索模块:从企业数据表中检索相关信息;4) 提示工程模块:为LLM生成定制化的提示,引导其生成准确的答案;5) 评分模块:评估LLM响应的质量,检测幻觉。整个流程旨在实现端到端的自动化问答。

关键创新:该论文的关键创新在于多LLM协同的RAG架构,以及用于检测LLM幻觉的五指标评分模块。与传统的单LLM RAG方法相比,ERATTA能够更好地利用不同LLM的优势,提高问答的准确性和效率。幻觉检测模块则有助于提高系统的可靠性。

关键设计:论文中提到,系统在10秒内返回结构化响应,暗示了对各个模块的性能进行了优化。五指标评分模块的具体指标未知,但其目的是量化LLM响应的质量,并识别潜在的幻觉。论文中没有明确给出具体的参数设置、损失函数或网络结构等技术细节,这些可能是实现细节或未公开的信息。

🖼️ 关键图片

📊 实验亮点

ERATTA系统在可持续性、财务健康和社交媒体等领域的数据集上进行了测试,结果表明,该系统在数百个用户查询中实现了超过90%的置信度。此外,提出的五指标评分模块能够有效检测LLM响应中的幻觉,提高了系统的可靠性。这些实验结果表明,ERATTA在企业级数据表问答方面具有显著优势。

🎯 应用场景

ERATTA可应用于企业内部知识库问答、客户服务、数据分析等场景。该系统能够帮助企业员工快速获取所需信息,提高工作效率。通过扩展,该架构还可用于异构数据源的查询,具有广泛的应用前景。该研究对于提升企业级AI应用的效率和可靠性具有重要价值。

📄 摘要(原文)

Large language models (LLMs) with retrieval augmented-generation (RAG) have been the optimal choice for scalable generative AI solutions in the recent past. Although RAG implemented with AI agents (agentic-RAG) has been recently popularized, its suffers from unstable cost and unreliable performances for Enterprise-level data-practices. Most existing use-cases that incorporate RAG with LLMs have been either generic or extremely domain specific, thereby questioning the scalability and generalizability of RAG-LLM approaches. In this work, we propose a unique LLM-based system where multiple LLMs can be invoked to enable data authentication, user-query routing, data-retrieval and custom prompting for question-answering capabilities from Enterprise-data tables. The source tables here are highly fluctuating and large in size and the proposed framework enables structured responses in under 10 seconds per query. Additionally, we propose a five metric scoring module that detects and reports hallucinations in the LLM responses. Our proposed system and scoring metrics achieve >90% confidence scores across hundreds of user queries in the sustainability, financial health and social media domains. Extensions to the proposed extreme RAG architectures can enable heterogeneous source querying using LLMs.