A Controlled Experiment on the Energy Efficiency of the Source Code Generated by Code Llama

作者: Vlad-Andrei Cursaru, Laura Duits, Joel Milligan, Damla Ural, Berta Rodriguez Sanchez, Vincenzo Stoico, Ivano Malavolta

分类: cs.SE, cs.AI

发布日期: 2024-05-06

💡 一句话要点

评估Code Llama生成代码的能效:与人工编写代码的对比研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 能源效率 大型语言模型 Code Llama 性能评估

📋 核心要点

- 大型语言模型(LLMs)被广泛用于代码生成,但其生成代码的能源效率缺乏客观评估。

- 该研究通过实验对比Code Llama生成代码与人工编写代码的能源效率,考察不同编程语言和提示的影响。

- 实验结果表明,Code Llama生成代码的能效受编程语言影响大,且通常不如人工代码节能,需开发者评估。

📝 摘要(中文)

本文旨在评估Code Llama生成的代码在能源效率方面的表现,并与人工编写的代码进行比较。研究设计了一个实验,使用了C++、JavaScript和Python三种语言实现的基准测试。通过不同的提示和温度参数,要求Code Llama生成代码,并对生成的代码和人工编写的代码进行能源效率分析。结果表明,Code Llama生成的代码的能源效率高度依赖于编程语言和具体的代码问题。总体而言,人工编写的代码通常更节能,但生成的JavaScript代码优于人工编写的版本。此外,明确要求Code Llama生成节能代码并不能提高能源效率,并且温度参数似乎对生成代码的能源效率没有影响。结论是,使用Code Llama生成的代码不能保证能源效率,因此软件开发人员在将生成的代码集成到软件系统中之前,应评估其能源效率。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)生成的代码的能源效率评估问题。现有方法缺乏对LLM生成代码能源效率的客观评估,开发者无法确定集成LLM生成代码是否会引入能源消耗问题。特别是Code Llama,作为最新的LLM代码生成工具,其能源效率特性尚不明确。

核心思路:论文的核心思路是通过设计一个可控实验,对比Code Llama生成的代码与人工编写代码在能源效率上的差异。通过控制提示词和温度参数,观察这些因素对生成代码能源效率的影响。同时,针对不同的编程语言(C++、JavaScript、Python)进行评估,以考察语言特性对结果的影响。

技术框架:实验框架包括以下几个主要步骤:1) 选择三个基准测试问题,并用C++、JavaScript和Python三种语言人工实现;2) 使用不同的提示词(包括要求生成节能代码的提示)和温度参数,让Code Llama生成对应于基准测试问题的代码;3) 分别执行人工编写的代码和Code Llama生成的代码;4) 使用性能分析工具(profiler)测量并比较两种代码的能源效率。

关键创新:该研究的关键创新在于首次对Code Llama生成代码的能源效率进行了系统的实验评估。之前的研究主要关注LLM生成代码的正确性、可读性等方面,而忽略了能源效率这一重要指标。该研究填补了这一空白,为开发者在使用LLM生成代码时提供了重要的参考信息。

关键设计:实验的关键设计包括:1) 选择具有代表性的基准测试问题,覆盖不同的算法和数据结构;2) 使用不同的提示词,包括明确要求生成节能代码的提示,以考察LLM是否能够理解并执行节能指令;3) 使用不同的温度参数,以考察生成代码的多样性对能源效率的影响;4) 使用标准的性能分析工具,精确测量代码的能源消耗。

🖼️ 关键图片

📊 实验亮点

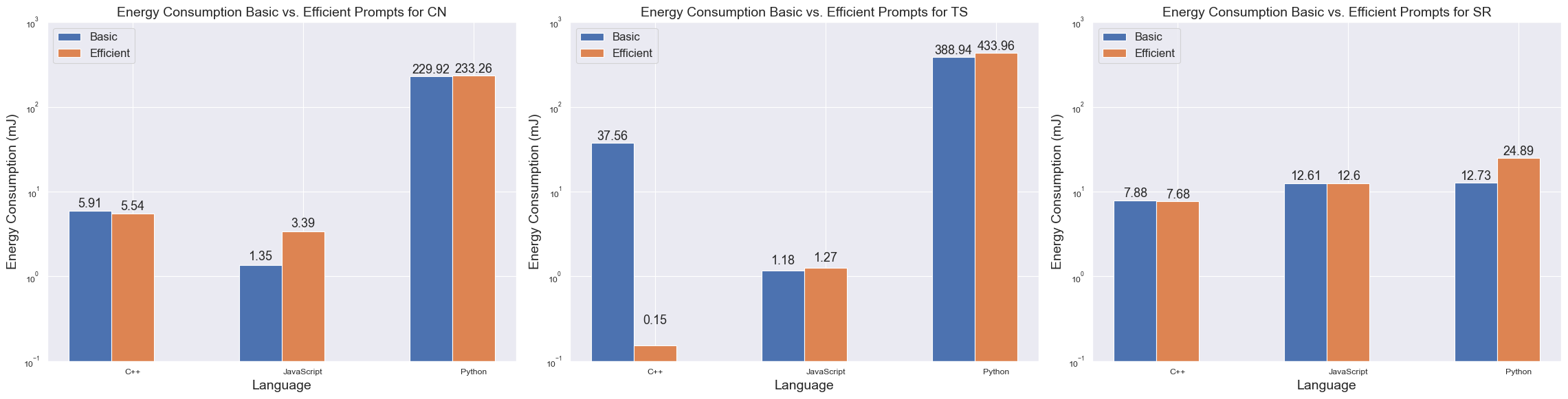

实验结果表明,Code Llama生成代码的能源效率高度依赖于编程语言和具体问题。总体上,人工编写的代码更节能,但Code Llama生成的JavaScript代码优于人工编写的版本。明确提示Code Llama生成节能代码并不能有效提高能源效率,温度参数对能效影响不大。这些发现强调了开发者在采用LLM生成代码时,必须进行能效评估的重要性。

🎯 应用场景

该研究结果可应用于软件开发领域,帮助开发者评估和选择更节能的代码生成方案。通过了解Code Llama等LLM工具在能源效率方面的局限性,开发者可以在代码集成前进行必要的优化,从而降低软件系统的总体能耗,符合绿色计算和可持续发展的趋势。未来的研究可以进一步探索如何优化LLM的训练和推理过程,以提高生成代码的能源效率。

📄 摘要(原文)

Context. Nowadays, 83% of software developers use Large Language Models (LLMs) to generate code. LLMs recently became essential to increase the productivity of software developers and decrease the time and cost of software development. Developers ranging from novices to experts use LLM tools not only to detect and patch bugs, but also to integrate generated code into their software. However, as of today there is no objective assessment of the energy efficiency of the source code generated by LLM tools. Released in August 2023, Code Llama is one of the most recent LLM tools. Goal. In this paper, we present an empirical study that assesses the energy efficiency of Code Llama with respect to human-written source code. Method. We design an experiment involving three human-written benchmarks implemented in C++, JavaScript, and Python. We ask Code Llama to generate the code of the benchmarks using different prompts and temperatures. Therefore, we execute both implementations and profile their energy efficiency. Results. Our study shows that the energy efficiency of code generated by Code Llama is heavily-dependent on the chosen programming language and the specific code problem at hand. Also, human implementations tend to be more energy efficient overall, with generated JavaScript code outperforming its human counterpart. Moreover, explicitly asking Code Llama to generate energy-efficient code results in an equal or worse energy efficiency, as well as using different temperatures seems not to affect the energy efficiency of generated code. Conclusions. According to our results, code generated using Code Llama does not guarantee energy efficiency, even when prompted to do so. Therefore, software developers should evaluate the energy efficiency of generated code before integrating it into the software system under development.